Im Jahr 2026 hat sich KI in einige der sensibelsten Bereiche der täglichen Arbeit eingeschlichen. Meetings, die früher in Notizbüchern oder verblassten Erinnerungen festgehalten wurden, werden heute aufgezeichnet, transkribiert, zusammengefasst und gespeichert – oft automatisch, oft standardmäßig und oft ohne dass Teams sich Gedanken darüber machen, was das für den Datenschutz bedeutet. Aus diesem Grund sind Diskussionen über KI und Datenschutz so brisant geworden, insbesondere wenn es um KI-Notizsysteme geht, die genau an der Schnittstelle zwischen Komfort und Risiko liegen.

Ich verbringe viel Zeit damit, über diesen Bereich zu schreiben, und das Muster ist immer dasselbe. Die Teams sind nicht gegen KI. Sie sind beschäftigt, überlastet und wirklich dankbar für Tools, die ihnen Verwaltungsaufgaben abnehmen. Gleichzeitig sind sie beunruhigt. Sie möchten wissen, wohin ihre Gespräche gehen, wer darauf zugreifen kann, wie lange sie aufbewahrt werden und ob diese Aufzeichnungen stillschweigend auf eine Weise wiederverwendet werden, der sie nicht zugestimmt haben. Diese Bedenken sind berechtigt.

Hier werden wir uns KI und Datenschutz aus einer ganz bestimmten Perspektive ansehen, nämlich anhand von KI-Notizern im Jahr 2026. Keine abstrakte Ethik und keine schwierige Verkaufssituation. Nur die tatsächlichen Risiken, die diese Tools mit sich bringen, wie sich diese Risiken in der Praxis zeigen und was Teams verstehen sollten, bevor sie auf „Aufnahme“ drücken und einem KI-System ihre Gespräche anvertrauen.

Unabhängig davon, ob Sie derzeit einen KI-Notizblock verwenden oder noch darüber nachdenken, wie dieser in Ihren Arbeitsalltag integriert werden kann, erhalten Sie hier einige wichtige Informationen, die Sie bei der Auswahl eines KI-Notizblocks oder beim Wechsel zu einem anderen Anbieter berücksichtigen sollten.

TL;DR

KI-Notizsysteme sparen Zeit, verwandeln jedoch auch spontane, informelle Gespräche in dauerhafte, durchsuchbare Aufzeichnungen, die echte Datenschutzrisiken in Bezug auf Einwilligung, Zuordnung, Aufbewahrung, Modelltraining und Sekundärnutzung mit sich bringen.

Teams haben Recht, wenn sie hinterfragen, wie Aufzeichnungen gespeichert werden, wer darauf zugreifen kann, wie lange sie aufbewahrt werden und ob Daten über die Erstellung von Notizen hinaus wiederverwendet werden.

Verantwortungsbewusste Einführung bedeutet, die Rechtsgrundlage, die Minimierung, die Löschrechte, die Schulungsrichtlinien und die Standardeinstellungen zu überprüfen und dann Anbieter auszuwählen, die die Aufzeichnung sichtbar machen, den Zugriff einschränken, die Verarbeitung klar dokumentieren und den Teams echte Kontrolle über die Aufbewahrung und Löschung geben.

Was macht KI-Notiznehmer zu einem einzigartigen Datenschutzrisiko?

Nicht alle KI-Tools bergen das gleiche Risiko für die Privatsphäre. Ein Design-Assistent oder ein Datenanalysemodell arbeitet in der Regel mit Informationen, die Nutzer bewusst und oft nach einer gewissen Überprüfung eingeben. KI-Notizprogramme unterscheiden sich davon. Sie arbeiten mit Live-Gesprächen, die in Echtzeit gesprochen werden und oft ungefilterte Gedanken, sensible Kontexte und Informationen enthalten, die niemals wörtlich festgehalten werden sollten.

Dieser Unterschied ist wichtig, da er sowohl die Art der verarbeiteten Daten als auch die Erwartungen der Menschen hinsichtlich Kontrolle, Einwilligung und nachgelagerter Nutzung verändert.

Aufzeichnung von Live-Gesprächen

Die erste und offensichtlichste Veränderung tritt in dem Moment ein, in dem ein Meeting aufgezeichnet wird. Live-Gespräche sind keine statischen Dokumente. Sie sind fließend, kontextabhängig und oft explorativ. Menschen sprechen anders, wenn sie glauben, dass ein Gespräch nur vorübergehend ist. Sie spekulieren, korrigieren sich selbst, testen Ideen und tauschen Informationen aus, die sie niemals schriftlich festhalten würden.

Wenn ein KI-Notizbuch eine Besprechung aufzeichnet, verwandelt es diesen flüchtigen Austausch in ein dauerhaftes Artefakt. Dies schafft ein Datenschutzrisiko, noch bevor die KI-Verarbeitung überhaupt beginnt. Die Aufzeichnung erfasst den Tonfall, die Absicht, Nebenbemerkungen und Momente, die niemals außerhalb des Raums festgehalten werden sollten. In vielen Organisationen beginnt hier das Unbehagen, insbesondere wenn die Aufzeichnungen automatisch erfolgen oder wenn die Teilnehmer sich nicht vollständig darüber im Klaren sind, was aufgezeichnet wird.

Es gibt auch eine Einwilligungslücke, die Teams oft unterschätzen. Bei verteilten oder unternehmensübergreifenden Besprechungen gehören möglicherweise nicht alle Anwesenden derselben Organisation an oder arbeiten nach denselben Richtlinien. Die Aufzeichnung einer Live-Konversation wirft Fragen darüber auf, wer der Aufzeichnung zugestimmt hat, wie diese Zustimmung eingeholt wurde und ob sie einer späteren Überprüfung standhalten würde.

Transkription und Sprecherzuordnung

Die Transkription fügt eine zweite Risikostufe hinzu, indem sie Sprache in Text umwandelt. Gesprochene Sprache ist chaotisch. Sie enthält Unterbrechungen, Überschneidungen, Fehlstarts und informelle Formulierungen, die beim Aufschreiben ganz anders wirken können. Eine Transkription hält diese Momente auf eine Weise fest, die als bloßstellend empfunden werden kann, insbesondere wenn sie namentlich genannten Sprechern zugeordnet wird.

Die Zuordnung von Sprechern erhöht die Sensibilität noch weiter. Durch die Identifizierung, wer was gesagt hat, entsteht eine durchsuchbare Aufzeichnung individueller Beiträge, Meinungen und Aussagen. In internen Besprechungen kann dies das Vertrauen beeinflussen, insbesondere wenn Machtverhältnisse im Spiel sind. In externen Besprechungen wirft dies die Frage auf, ob Kunden, Partner oder Kandidaten erwarten, dass ihre Äußerungen dauerhaft zugeordnet und gespeichert werden.

Genauigkeit ist hier wichtig, aber ebenso wichtig ist die Interpretation. Falsche Zuordnung, unvollständige Transkription oder Verlust des Kontexts können zu Aufzeichnungen führen, die nicht das widerspiegeln, was tatsächlich gemeint war, aber dennoch als maßgebliche Dokumente existieren. Aus Sicht des Datenschutzes geht es hier um Reputationsrisiken und Fairness.

Speicherung, Aufbewahrung und Durchsuchbarkeit

Sobald eine Besprechung aufgezeichnet und transkribiert wurde, muss sie irgendwo gespeichert werden. Bei der Speicherung werden viele abstrakte Datenschutzbedenken konkret. Teams sind sich oft nicht bewusst, wie lange Aufzeichnungen aufbewahrt werden, wo sie gespeichert sind oder wer standardmäßig darauf zugreifen kann.

Die Suchbarkeit verstärkt dieses Risiko. Die Möglichkeit, über Monate oder Jahre hinweg nach Besprechungsdaten zu suchen, ist zwar sehr nützlich, bedeutet aber auch, dass sensible Informationen lange nach dem ursprünglichen Kontext wieder auftauchen können. Eine beiläufige Bemerkung, die während einer Brainstorming-Sitzung gemacht wurde, kann bei Audits, Streitigkeiten oder internen Überprüfungen wieder auftauchen, losgelöst von den Umständen, unter denen sie gemacht wurde.

Aufbewahrungsrichtlinien sind daher von entscheidender Bedeutung, werden jedoch häufig übersehen. Eine unbegrenzte Aufbewahrung erscheint bequem, erhöht jedoch mit der Zeit das Risiko. Je länger Daten vorhanden sind, desto größer ist die Wahrscheinlichkeit, dass sie abgerufen, missbraucht oder verletzt werden. Datenschutzbewusste Teams fragen zunehmend nicht nur, wo Daten gespeichert sind, sondern auch, wie lange sie dort verbleiben und wie einfach sie entfernt werden können.

KI-Verarbeitung, Zusammenfassungen, Highlights und Aktionspunkte

KI-Notizsysteme bieten weit mehr als nur Transkription. Sie fassen Diskussionen zusammen, extrahieren wichtige Punkte, generieren Aktionspunkte und leiten manchmal Absichten oder Prioritäten ab. Diese Verarbeitungsebene bringt zusätzliche Datenschutzaspekte mit sich.

Zusammenfassungen sind Interpretationen. Sie verdichten komplexe Gespräche zu vereinfachten Erzählungen, wodurch Schwerpunkte verschoben oder Nuancen ausgelassen werden können. Highlights und Aktionspunkte bringen oft Entscheidungen oder Verantwortlichkeiten zum Vorschein, die von den Teilnehmern nicht ausdrücklich so formuliert wurden. Diese Ergebnisse sind zwar nützlich, können jedoch zu Aufzeichnungen führen, die definitiver wirken, als das zugrunde liegende Gespräch tatsächlich war.

Aus Sicht des Datenschutzes geht es nicht nur darum, dass KI die Daten verarbeitet, sondern auch darum, wie diese Ergebnisse genutzt und weitergegeben werden. Zusammenfassungen werden eher weitergeleitet, in Projekt-Tools gespeichert oder später herangezogen, wodurch die Reichweite der ursprünglichen Konversation über die beabsichtigte Zielgruppe hinaus erweitert wird.

Es stellt sich auch die Frage nach dem Modellzugriff. Teams möchten wissen, ob Besprechungsdaten in isolierten Umgebungen verarbeitet werden, ob sie nach der Verarbeitung aufbewahrt werden und ob sie jemals Systemen zugänglich gemacht werden, die über die unmittelbare Aufgabe der Notizenerstellung hinausgehen.

Risiko der sekundären Nutzung und Befürchtungen hinsichtlich des Modelltrainings

Eine der größten Sorgen im Zusammenhang mit KI-Notizsystemen ist die sekundäre Nutzung. Teams befürchten, dass ihre Gespräche für Zwecke wiederverwendet werden könnten, die sie nicht beabsichtigt haben, wie beispielsweise die Verbesserung von Modellen, das Training zukünftiger Systeme oder die Generierung von Erkenntnissen, die über den Rahmen der ursprünglichen Besprechung hinausgehen.

Diese Befürchtungen sind nicht unbegründet. Im weiteren Umfeld der KI ist die Wiederverwendung von Daten gang und gäbe, und die Aussagen der Anbieter sind oft vage. Aussagen wie „Wir trainieren nicht mit Ihren Daten“ können wichtige Details über temporäre Verarbeitung, Anonymisierung oder aggregiertes Lernen verschleiern.

Für datenschutzbewusste Organisationen ist Kontrolle das zentrale Thema. Sie wollen klare, überprüfbare Antworten darauf, ob Meeting-Daten in irgendeiner Form zum Modelltraining beitragen, ob Opt-out-Mechanismen existieren und wie diese Verpflichtungen nicht nur vertraglich, sondern auch technisch durchgesetzt werden.

Das Risiko der sekundären Nutzung erstreckt sich auch intern. Selbst wenn ein Anbieter verantwortungsbewusst mit Daten umgeht, müssen Unternehmen berücksichtigen, wie aufgezeichnete und verarbeitete Besprechungsdaten von ihren eigenen Teams auf eine Weise wiederverwendet werden könnten, die die Teilnehmer nicht erwartet haben.

Deshalb fühlen sich KI-Notiznehmer anders an

Zusammengenommen erklären diese Faktoren, warum KI-Notizsysteme im Vergleich zu anderen KI-Tools besonders sensibel sind. Sie arbeiten mit ungeschützter menschlicher Kommunikation, erstellen dauerhafte Aufzeichnungen aus vorübergehenden Austauschvorgängen und legen Interpretationen über die Rohdaten.

Das Datenschutzrisiko besteht nicht in einem eigentlichen Fehlverhalten, sondern in der Offenlegung. Das Verständnis dieses Unterschieds ist der erste Schritt, um diese Tools verantwortungsbewusst zu bewerten, anstatt sie pauschal zu akzeptieren oder rundweg abzulehnen.

Die tatsächlichen Bedenken der Teams und warum diese nicht irrational sind

Wenn Teams gegenüber KI-Notizern zögern, ist es verlockend, diesen Widerstand als Angst vor Veränderungen darzustellen. In der Praxis sind die Bedenken, die die Menschen äußern, jedoch spezifisch, situationsbedingt und oft auf direkten Erfahrungen begründet. Verbringt man Zeit in Fachkreisen, tauchen immer wieder dieselben Themen auf, unabhängig von der Rolle oder Branche.

Interne Besprechungen und psychologische Sicherheit

Einer der ersten Konfliktpunkte im Zusammenhang mit KI-Notizern zeigt sich in internen Besprechungen, in denen Gespräche explorativ und oft unvollendet sind. Teams beschreiben immer wieder eine Veränderung, sobald die Aufzeichnung beginnt. Die Leute werden langsamer. Die Sprache wird präziser. Ideen werden sicherer, bevor sie besser werden.

Diese Veränderung kommt deutlich in einer langjährigen Reddit-Diskussion über die Ethik von KI-Notiztools am Arbeitsplatz. In diesem Thread beschreibt der ursprüngliche Verfasser, wie er seinem Team ein KI-Notiztool vorgestellt hat und dabei eher auf Unbehagen als auf Interesse gestoßen ist. Ein Kollege bat darum, vor jeder Besprechung darüber informiert zu werden, ob eine Aufzeichnung stattfindet, da er es überhaupt nicht möge, aufgezeichnet zu werden, auch wenn er dies nicht aktiv verhindern würde.

Die Antworten machen deutlich, dass diese Reaktion weit verbreitet ist. Ein Kommentator schrieb: „Wir fragen die Teilnehmer IMMER vor jedem Meeting, ob wir sie aufzeichnen dürfen. Das ist grundlegende Professionalität.“ Ein anderer sagte: „Wenn ich herausfinden würde, dass Sie mich ohne meine Zustimmung aufgezeichnet haben, würde ich Sie bei der Personalabteilung melden. Das ist eine schwerwiegende Verletzung der Privatsphäre.“

Was in der Diskussion auffällt, ist, dass nur sehr wenige Menschen Einwände gegen das Notieren an sich haben. Die Bedenken konzentrieren sich auf die Dauerhaftigkeit und den Kontrollverlust, sobald gesprochene Sprache erfasst und verarbeitet wird. Ein Nutzer erklärte: „Ich möchte nicht, dass meine Worte in eine KI eingespeist werden, um eine ‚Zusammenfassung‘ zu erstellen, weil ich nicht darauf vertraue, dass diese eine genaue Zusammenfassung liefert.“ Dieses Unbehagen hängt mit dem Risiko zusammen, dass der Kontext verflacht und die Absicht falsch interpretiert wird.

Mehrere Kommentatoren beschrieben auch, wie Aufzeichnungen das Gruppenverhalten im Laufe der Zeit verändern. Die Leute sagten, dass sie sich wohlfühlten, sobald die Aufzeichnung angekündigt wurde, lehnten jedoch überraschende Aufzeichnungen entschieden ab, die viele als unehrlich bezeichneten. Andere äußerten Bedenken darüber, dass Tools von Drittanbietern interne Gespräche außerhalb der genehmigten Systeme führen könnten. Ein Kommentator fragte, ob es wirklich jemandem recht sei, dass „alle internen Unternehmensdiskussionen” an einen anderen Ort gesendet würden.

Insgesamt weisen diese Antworten auf dasselbe grundlegende Problem hin. Psychologische Sicherheit hängt davon ab, dass Menschen sich in der Lage fühlen, laut zu denken, ihre Meinung zu ändern und sich unvollkommen auszudrücken. Wenn Besprechungen routinemäßig aufgezeichnet, transkribiert, zugeordnet und gespeichert werden, schränkt dies diese Freiheit ein. Gespräche werden vorsichtiger und weniger offen, was Einfluss darauf hat, was gesagt wird und was nicht.

Teams in diesen Diskussionen beschreiben weniger vorläufige Ideen und eine zurückhaltendere Beteiligung, sobald die Aufzeichnung zur Routine wird. Diese Veränderung wirkt sich darauf aus, wie Probleme untersucht und Entscheidungen getroffen werden. Deshalb kann das Unbehagen gegenüber internen Aufzeichnungen nicht einfach als Widerwillen gegenüber neuen Tools abgetan werden.

Kundenanrufe und externes Vertrauen

Kunden- und Klientenanrufe bergen ein anderes Risiko, da die Personen am anderen Ende der Leitung außerhalb der Kontrolle des Unternehmens stehen. Sie kennen die internen Richtlinien nicht, haben den internen Tool-Entscheidungen nicht zugestimmt und bringen oft sensible Informationen in das Gespräch ein, ohne zu wissen, wie diese behandelt werden könnten.

Diese Erwartungslücke zeigt sich deutlich in einer anderen Reddit-Diskussion darüber, warum viele Fachleute Notiztools meiden. Ein leitender Assistent beschrieb ein juristisches Szenario, in dem ein Kunde zwar akzeptieren würde, dass ein junger Kollege an einem Telefonat teilnimmt, aber sofort Einwände gegen die Anwesenheit eines KI-Notizers hätte. Die Schlussfolgerung war einfach: Wenn es um persönliche Angelegenheiten geht, vertrauen Menschen eher einer anderen Person als einem automatisierten System.

An anderer Stelle in diesem Thread beschrieben Kommentatoren Organisationen, die KI-Notiznehmer aktiv aus Besprechungen entfernen oder ganz blockieren, mit der Begründung, dass vertrauliche Gespräche oft ohne Vorwarnung in sensible Bereiche abdriften.

Das Problem hierbei ist nicht die Aufzeichnung selbst, sondern der Kontrollverlust, sobald ein Gespräch das Telefonat verlässt. Kunden erwarten möglicherweise Notizen. Sie erwarten jedoch selten, dass ihre Worte gespeichert, durchsuchbar gemacht und von einem KI-System verarbeitet werden, auf das andere später zugreifen können.

Mehrere Teilnehmer merkten an, dass Kundengespräche nicht immer strikt innerhalb der Tagesordnung bleiben. Routinemäßige Anrufe können schnell in persönliche, finanzielle oder rechtliche Bereiche übergehen, was eine pauschale Aufzeichnung riskant erscheinen lässt.

Aus diesem Grund verfolgen viele Unternehmen einen vorsichtigen Ansatz. Einige beschränken den Einsatz von KI-Notizern auf den internen Gebrauch. Andere verlangen eine ausdrückliche Genehmigung für externe Anrufe. Einige vermeiden sie ganz in Kundengesprächen und stellen Vertrauen über Bequemlichkeit.

Aus diesem Grund sind externe Anrufe nach wie vor einer der sensibelsten Kontexte für KI-Notizsysteme. Das Problem ist nicht die Erlaubnis auf dem Papier. Es geht darum, ob das Tool den Erwartungen der Menschen am anderen Ende der Leitung entspricht.

Gespräche zu Personalwesen, Recht und Finanzen

Dieses Gefühl kommt immer wieder zum Vorschein, wenn Menschen, die mit vertraulichen Informationen arbeiten, über KI-Transkriptionstools sprechen. Es spiegelt eher eine praktische Grenze wider als eine philosophische Haltung. In den Bereichen Personalwesen, Recht und Finanzen werden Besprechungen standardmäßig bereits als sensibel behandelt, und kleine Unsicherheiten bergen ein überproportionales Risiko.

In diesen Zusammenhängen sind sich die Menschen sehr bewusst, dass Worte nicht isoliert existieren. Die Bedeutung hängt vom Tonfall, dem Zeitpunkt und der Absicht ab, und all das kann verloren gehen, wenn Sprache in eine dauerhafte Aufzeichnung umgewandelt wird. Ein Leistungsgespräch, eine Redundanzdiskussion oder eine Sitzung zur Rechtsstrategie verändert seinen Charakter, wenn es später von jemandem, der nicht anwesend war, durchsuchbar und überprüfbar wird.

Bedenken hinsichtlich der Wiederverwendung verstärken dieses Unbehagen noch. Fachleute weisen häufig darauf hin, dass Datenschutzrichtlinien die Verwendung von Audioaufzeichnungen oder Transkripten für andere Zwecke als die Erstellung von Notizen erlauben können, darunter das Training von Modellen oder die Weitergabe innerhalb größerer Systeme. Selbst wenn diese Praktiken offengelegt werden, erscheint die Möglichkeit einer sekundären Verwendung unvereinbar mit Gesprächen, die strikte Vertraulichkeit voraussetzen.

Bei diesen Funktionen besteht auch eine starke Präferenz dafür, die Kontrolle in eigener Hand zu behalten. Die Verarbeitung auf dem Gerät wird häufig als akzeptabler angesehen als cloudbasierte Uploads, da sie die Unsicherheit darüber verringert, wohin die Daten übertragen werden und wer später darauf zugreifen könnte. Dieser Unterschied ist vor allem dann von Bedeutung, wenn die Art und Weise, wie mit Informationen umgegangen wird, rechtliche, finanzielle oder berufliche Konsequenzen hat.

Infolgedessen neigen Personal-, Rechts- und Finanzabteilungen dazu, konservativ zu handeln. Sie verlassen sich auf manuelle Notizen. Sie beschränken die Aufzeichnung. Sie vermeiden Tools, die sensible Diskussionen in langlebige Artefakte verwandeln. Bei diesen Entscheidungen geht es nicht darum, sich gegen Veränderungen zu wehren. Sie spiegeln vielmehr die Erkenntnis wider, dass bestimmte Gespräche, sobald sie aufgezeichnet und verarbeitet wurden, nicht mehr rückgängig gemacht werden können.

In solchen Umgebungen ist Zurückhaltung eine rationale Reaktion auf die Bedeutung, die diese Gespräche haben.

Zustimmung und Vertrauen der Mitarbeiter

Eine der größten Bedenken im Zusammenhang mit KI-Notizsystemen ist die Frage, ob Mitarbeiter wirklich die Wahl haben, ob sie aufgezeichnet und transkribiert werden möchten. Auf dem Papier regeln Unternehmen dies oft mit Richtlinien oder In-App-Benachrichtigungen. In der Praxis haben viele Menschen jedoch das Gefühl, dass sie kaum Einfluss darauf haben, wie ihre Äußerungen erfasst und verwendet werden.

Datenschutzexperten und Kommentatoren haben deutlich auf dieses Problem hingewiesen. Einige Experten argumentieren, dass KI-Notizsysteme die Grenze zwischen passiver Benachrichtigung und aktiver, informierter Einwilligung verwischen, da die Teilnehmer oft erst nachträglich erfahren, dass ein Tool sie aufgezeichnet hat, wenn die Aufzeichnung oder das Transkript in ihren Akten erscheint oder Diskussionen über die Aufbewahrung und Wiederverwendung stattfinden. Das wirft Fragen darüber auf, wie frei die Einwilligung erteilt wird und was die Teilnehmer tatsächlich darüber wissen, was mit ihren Besprechungsdaten geschehen ist.

Ein kürzlich erschienener Artikel über Bedenken hinsichtlich KI-Notizern erklärte, dass allein die Anwesenheit eines automatisierten Zuhörers in einer Besprechung das Gefühl hervorrufen kann, beobachtet oder überwacht zu werden, was die Art und Weise verändert, wie Menschen sprechen und sich beteiligen. Mitarbeiter könnten dazu neigen, ihre Sprache zu filtern, Unsicherheiten zu vermeiden oder sich mit Beiträgen zurückzuhalten, weil sie wissen, dass ihre Worte aufgezeichnet und gespeichert werden, und zwar weit über den Moment hinaus, in dem das Gespräch endet.

Dieses Problem tritt in Leitfäden von Datenschutzfachleuten , die betonen, dass die Einwilligung im Rahmen von Vorschriften wie der DSGVO informiert, spezifisch und sinnvoll sein muss. Beispielsweise müssen Organisationen den Teilnehmern nicht nur mitteilen, dass Audioaufnahmen gemacht werden, sondern auch, welche Daten erfasst werden, wo sie gespeichert werden, wie lange sie aufbewahrt werden und wer Zugriff darauf hat. Diese Details gehen oft in Einladungen zu Besprechungen oder den Nutzungsbedingungen der Plattform unter, anstatt vor Beginn der Aufzeichnung ausdrücklich genannt zu werden.

Schattenaufzeichnung und nicht genehmigte Tools

Eines der unangenehmsten Muster, das sich im Zusammenhang mit KI-Notizern abzeichnet, ist, dass unklare Regeln und pauschale Beschränkungen die Aufzeichnung nicht verhindern. Sie verändern lediglich den Ort, an dem sie stattfindet.

Wenn offizielle Tools als einschränkend empfunden werden oder schlecht erklärt sind, suchen die Menschen oft nach Alternativen. Es tauchen persönliche Konten, Browser-Erweiterungen, lokale Apps und Tools auf, die entwickelt wurden, um einer Erkennung zu entgehen. Eine Diskussion zum Thema Cybersicherheit überdiesogenannte„Schatten-KI”beschrieb eine Organisation, die Hunderte von nicht genehmigten KI-Notizkonten entdeckte, die ohne Genehmigung, Sichtbarkeit oder Aufsicht betrieben wurden. Dieses Verhalten ist nicht überraschend. Mitarbeiter laden oft kurz vor einem wichtigen Anruf einen Notiz-Dienst herunter oder aktivieren Funktionen, die bereits in den Tools vorhanden sind, die sie täglich verwenden, wie Google Gemini Microsoft 365. Die Aufzeichnung fühlt sich nicht wie eine separate Entscheidung an, wenn sie in vertraute Software eingebettet ist und eher als Standardfunktion denn als politische Entscheidung dargestellt wird.

Das Ergebnis ist ein fragmentiertes Risiko. Aufzeichnungen werden über persönliche Konten, unverwaltete Speicherorte und Systeme verteilt, die weder für die IT- noch für die Sicherheitsabteilung einsehbar sind. Die Aufbewahrungsregeln sind uneinheitlich. Der Zugriff ist unklar. Die Wiederverwendung von Daten lässt sich nicht mehr nachverfolgen.

Aus diesem Grund haben pauschale Verbote oft den gegenteiligen Effekt. Wenn Aufzeichnungen als etwas behandelt werden, das unterdrückt statt reguliert werden muss, verschwinden sie nicht. Sie werden nur schwerer sichtbar. Die inoffizielle Nutzung sorgt für mehr Aufmerksamkeit als Tools, die offen eingesetzt, klar erklärt und von den Nutzern verstanden werden.

Die verdeckte Aufzeichnung ist kein Versagen des Urteilsvermögens der Mitarbeiter. Sie ist ein Signal dafür, dass die Kluft zwischen Richtlinien und der täglichen Realität zu groß geworden ist.

Warum diese Bedenken Beachtung verdienen

Insgesamt betrachtet sind diese Bedenken weder irrational noch feindselig gegenüber KI. Sie spiegeln eine klare Sichtweise wider, wie KI-Notizsysteme den Lebenszyklus der Kommunikation am Arbeitsplatz auf eine Weise verändern, die für die Menschen unmittelbar spürbar ist.

Die Menschen reagieren auf Dauerhaftigkeit, Zuordnung, Durchsuchbarkeit und Wiederverwendbarkeit sowie auf eine Veränderung hinsichtlich der Frage, wer nach Ende einer Besprechung die Kontrolle über das Gesagte hat. Diese Reaktionen liegen an der Schnittstelle zwischen Emotion und Konsequenz. Gespräche, die früher verblassten, bleiben nun bestehen. Der Kontext geht verloren. Die Eigentumsverhältnisse erscheinen unklar.

Die Bedeutung der Realität erkennen. Ohne zu verstehen, wie diese Tools das Verhalten und die Erwartungen verändern, kann man Unbehagen leicht als Widerstand abtun oder sich zu sehr auf Zusicherungen verlassen, die auf dem Papier ausreichend erscheinen, in der Praxis jedoch zu kurz greifen.

Dieser Kontext ist der Ausgangspunkt für jede sinnvolle Bewertung, wie KI-Notizprogramme mit dem Datenschutz umgehen.

Datenschutzbestimmungen für KI-Notizsysteme werden oft auf das Wesentliche reduziert. Einige Teams betrachten sie als etwas, das mit einem Häkchen abgehandelt werden kann. Andere sehen sie als ein Gebiet, das man besser meidet, es sei denn, die Rechtsabteilung wird eingeschaltet. Keiner dieser Ansätze spiegelt wider, wie sich diese Regeln auswirken, sobald Aufzeichnungen Teil der täglichen Arbeit werden.

Rahmenwerke wie die DSGVO sind hier von Bedeutung, da KI-Notizsysteme mit gesprochenen Gesprächen arbeiten. Menschen sprechen anders als sie schreiben. Sie korrigieren sich mitten im Satz. Sie teilen Kontextinformationen, die sie niemals in ein Dokument schreiben würden. Regulierung wird gerade deshalb relevant, weil diese Momente erfasst und gespeichert werden.

Fragen, die bei der Betrachtung von KI-Notizern zu berücksichtigen sind

Es gibt viele Gründe, warum Menschen eine sorgfältige Prüfung vornehmen müssen, bevor sie sich für den richtigen KI-Notizbuchhalter für ihre Geschäftsabläufe entscheiden. Hier sind nur einige Punkte, die bei dieser Entscheidung zu berücksichtigen sind.

1) Rechtsgrundlage, Einwilligung und berechtigtes Interesse

Eine der ersten Fragen, die Teams stellen, ist, ob alle Teilnehmer einer Besprechung der Aufzeichnung zustimmen müssen. Die Antwort ist selten einfach, was oft zu Unbehagen führt.

Gemäß der DSGVO benötigen Organisationen eine rechtmäßige Grundlage für die Verarbeitung personenbezogener Daten. Die Einwilligung ist eine Möglichkeit. Ein berechtigtes Interesse ist eine weitere. Viele Tools am Arbeitsplatz stützen sich auf ein berechtigtes Interesse, wobei davon ausgegangen wird, dass die Verarbeitung einem angemessenen geschäftlichen Zweck dient und die Rechte des Einzelnen nicht außer Kraft setzt.

KI-Notiznehmer bewegen sich nahe an der Grenze dieser Annahme. Die meisten Menschen erwarten, dass Notizen gemacht werden. Weniger erwarten, dass ihre genauen Worte von einem automatisierten System erfasst und verarbeitet werden. Diese Kluft zwischen Erwartung und Realität ist von Bedeutung, selbst wenn die rechtliche Grundlage technisch einwandfrei ist.

Aus diesem Grund hat die Offenlegung so großes Gewicht. Wenn keine Einwilligung vorliegt, müssen die Menschen dennoch verstehen, was mit ihren Daten geschieht, bevor es geschieht, und nicht erst, nachdem eine Abschrift erscheint.

Wenn jemand an Ihrem Meeting teilgenommen hat und eher Notizen als eine dauerhafte Aufzeichnung erwartet hat, hätte er dann das Gefühl, dass er eine echte Wahl hatte?

2) Datenminimierung in einer Welt vollständiger Transkripte

Datenminimierung klingt theoretisch, bis sie mit einer aufgezeichneten Besprechung kollidiert.

Die Idee an sich ist einfach. Organisationen sollten nur das sammeln und aufbewahren, was sie benötigen. KI-Notizsysteme tun standardmäßig oft das Gegenteil, indem sie alles erfassen, weil dies einfach ist und später bei der Suche nützlich sein kann.

Das bedeutet nicht, dass diese Tools mit den Vorschriften unvereinbar sind. Es bedeutet jedoch, dass die Teams entscheiden müssen, was sie tatsächlich benötigen. Vollständige Aufzeichnungen können hilfreich sein. Sie können aber auch unnötig sein. Transkripte können für eine gewisse Zeit wertvoll sein. Sie müssen jedoch nicht für immer aufbewahrt werden.

Bei der Minimierung geht es hier um die Absicht. Welches Problem wird gelöst und wie viele Daten werden dazu gespeichert?

Wenn eine Zusammenfassung den Anforderungen genügen würde, warum sollte man dann die gesamte Unterhaltung aufbewahren?

3) Rechte auf Zugang, Löschung und Kontrolle

Die Regulierung erscheint nicht mehr abstrakt, wenn jemand Einsicht in seine Daten verlangt.

Gemäß der DSGVO haben Personen das Recht, auf personenbezogene Daten zuzugreifen und in vielen Fällen deren Löschung zu verlangen. Wenn Besprechungen aufgezeichnet und transkribiert werden, gelten diese Rechte sowohl für mündliche als auch für schriftliche Beiträge.

Das bringt echte operative Anforderungen mit sich. Teams müssen wissen, wo sich Aufzeichnungen befinden (vorzugsweise an einem einzigen einheitlichen Ort) und wie sie auf Anfragen reagieren können, ohne raten zu müssen. Hier kommt es auf die richtigen Tools an. Einstellungen zur Aufbewahrung und Löschprozesse sind nicht mehr nur eine nette Ergänzung, sondern eine Notwendigkeit.

Ohne diese Kontrollen können selbst gut gemeinte Teams in eine Sackgasse geraten.

Wenn dich jemand bitten würde, seine Beiträge aus früheren Besprechungen zu entfernen, könntest du das sauber erledigen?

4) Zweckbindung und sekundäre Nutzung

Bei der Zweckbindung geht es um Grenzen.

Gemäß der DSGVO müssen personenbezogene Daten aus einem bestimmten, eindeutigen Grund erhoben werden. Sie dürfen später nicht ohne klare Begründung und Transparenz stillschweigend für neue Zwecke verwendet werden.

Bei KI-Notizern ist der erklärte Zweck in der Regel klar. Das Meeting erfassen. Notizen erstellen. Informationen leichter abrufbar machen.

Die schwierigere Frage ist, was als Nächstes passiert.

Bleibt die Aufzeichnung auf diesen Zweck beschränkt oder dient sie auch anderen Zwecken? Wird sie für Leistungsanalysen ausgewertet? In Analysesysteme eingespeist? Zum Trainieren von Modellen verwendet? Über weitere interne Tools hinweg geteilt?

Diese Erweiterungen sind nicht automatisch rechtswidrig. Sie erfordern jedoch Klarheit. Wenn der ursprüngliche Zweck das Anfertigen von Notizen war, muss jede weitergehende Nutzung von vornherein definiert und kommuniziert werden.

Hier kann das Vertrauen schwinden. Die Menschen akzeptieren möglicherweise Aufzeichnungen zu Dokumentationszwecken. Sie könnten jedoch anders darüber denken, wenn dieselben Daten für eine nicht damit in Zusammenhang stehende Analyse oder Modellentwicklung verwendet werden.

Die Zweckbindung erzwingt eine einfache Disziplin. Warum wurde dies gesammelt, und wird es noch immer für diesen Zweck verwendet?

Wenn sich der Umfang erweitert hat, wurde dies deutlich gemacht?

Wenn die Daten mehr leisten würden, als die Teilnehmer erwartet haben, wäre diese Überraschung dann akzeptabel?

Warum EU-zentrierte Teams von Natur aus vorsichtig sind

Die europäischen Regulierungsbehörden vertreten eine strenge Haltung in Bezug auf die Überwachung am Arbeitsplatz und Machtungleichgewichte. KI-Notizsysteme berühren beide Bereiche gleichzeitig, was erklärt, warum EU-zentrierte Teams oft vorsichtig vorgehen.

Diese Vorsicht zeigt sich in der Regel schon frühzeitig. Teams denken vor der Einführung über die Aufbewahrung nach. Sie erkundigen sich nach dem Zugriff, bevor sie die Aufzeichnung aktivieren. Sie suchen nach einer Rechtfertigung, anstatt später Regeln nachträglich anzupassen.

Dies ist ein Versuch, Probleme zu vermeiden, die schwer zu lösen sind, wenn das Vertrauen einmal verloren gegangen ist.

Wie man einen KI-Notiznehmer verantwortungsbewusst bewertet

Sobald Teams akzeptieren, dass KI-Notizprogramme echte Datenschutz- und Sicherheitsfragen aufwerfen, besteht die nächste Herausforderung darin, eines sorgfältig auszuwählen. An dieser Stelle kommen viele Bewertungen zum Stillstand, nicht weil die Menschen uninteressiert sind, sondern weil es schwierig wird, zu beurteilen, wie sich ein Tool verhält, wenn es über die Demo-Phase hinaus in den täglichen Gebrauch übergeht.

Eine verantwortungsvolle Bewertung konzentriert sich eher auf Ergebnisse als auf Zusicherungen. Das Ziel besteht darin, zu verstehen, was mit den Daten im Laufe der Zeit, in verschiedenen Situationen und bei Auftreten von Randfällen geschieht.

1) Beginnen Sie mit Fragen, die das Verhalten beschreiben.

Frühe Bewertungen konzentrieren sich oft darauf, ob ein Tool die gesetzlichen Anforderungen erfüllt. Das ist zwar wichtig, gibt aber selten ein vollständiges Bild wieder. Nützlichere Erkenntnisse lassen sich gewinnen, wenn man versteht, wie das System standardmäßig funktioniert.

- Wo die Besprechungsdaten gespeichert werden, einschließlich der beteiligten Regionen

- Wie lange Aufzeichnungen und Transkripte vor der Löschung gespeichert werden

- Wer kann Aufzeichnungen, Transkripte oder Zusammenfassungen nach einer Besprechung einsehen?

- Ob sich der Zugriff je nach Rolle, Arbeitsbereich oder Eigentumsverhältnissen ändert

- Was passiert mit Daten, wenn jemand das Unternehmen verlässt?

Tools, die diese Bereiche gut abdecken, erleichtern es Teams, die Nutzung intern zu erklären und einheitliche Regeln ohne Reibungsverluste anzuwenden.

2) Einwilligung, Offenlegung und Erwartungen

Die Aufzeichnung funktioniert am besten, wenn die Teilnehmer bereits vor Beginn wissen, was auf sie zukommt. Bei der Bewertung sollte genau geprüft werden, wie die Tools den Aufzeichnungsstatus in realen Besprechungen kommunizieren.

- Deutliche Benachrichtigung bei Beginn der Aufzeichnung

- Möglichkeit, die Aufzeichnung pro Besprechung ein- oder auszuschalten

- Vorhersehbare Behandlung von Spätanmeldern

- Sichtbare Signale für externe Teilnehmer, wie z. B. einen Bot

Wenn die Aufzeichnung explizit und bewusst erfolgt, fühlen sich Teams wohler bei der Verwendung und neigen weniger dazu, Umgehungslösungen zu entwickeln.

3) KI-Verarbeitung und Modellnutzung

Die Art und Weise, wie KI-Systeme mit Besprechungsdaten interagieren, ist ein wichtiger Schwerpunkt bei der Bewertung.

- Ob Meeting-Daten zum Modelltraining beitragen

- Ob die Verarbeitung pro Kunde isoliert erfolgt

- Welche Daten bleiben nach der Erstellung von Zusammenfassungen erhalten?

- Ob Modelle von Drittanbietern beteiligt sind

Tools, die diese Abläufe klar erläutern und auf Isolierung ausgelegt sind, geben Teams Sicherheit darüber, wie ihre Daten über die unmittelbare Besprechung hinaus behandelt werden.

4) KI-Verarbeitung und Modellnutzung

Die Art und Weise, wie KI-Systeme mit Besprechungsdaten interagieren, ist ein wichtiger Schwerpunkt bei der Bewertung.

- Ob Meeting-Daten zum Modelltraining beitragen

- Ob die Verarbeitung pro Kunde isoliert erfolgt

- Welche Daten bleiben nach der Erstellung von Zusammenfassungen erhalten?

- Ob Modelle von Drittanbietern beteiligt sind

Tools, die diese Abläufe klar erläutern und auf Isolierung ausgelegt sind, geben Teams Sicherheit darüber, wie ihre Daten über die unmittelbare Besprechung hinaus behandelt werden.

5) Unvollständige Antworten erkennen

Bei den Bewertungen deuten einige Antworten darauf hin, dass eine eingehendere Diskussion erforderlich ist.

- Pauschale Konformitätserklärungen ohne Erläuterung

- Verweise auf Zertifizierungen, die nicht mit Aufzeichnungsworkflows verbunden sind

- Aussagen zur Sicherheit ohne Details zu Zugriff oder Aufbewahrung

- Starke Abhängigkeit von Richtlinien ohne unterstützende Systemkontrollen

Strengere Bewertungen betrachten diese eher als Aufforderung zur Klarstellung denn als Warnsignale.

6) Bewertung der Auswirkungen innerhalb der Organisation

Eine verantwortungsvolle Bewertung umfasst auch Überlegungen zur internen Verwendung.

- Wie sich Aufzeichnungen in die bestehende Besprechungskultur einfügen

- Wer entscheidet, wann eine Aufzeichnung angemessen ist?

- Welche Anleitung erhalten die Nutzer vor der Verwendung des Tools?

- Wie Bedenken oder Ablehnungen behandelt werden

Wenn diese Entscheidungen frühzeitig getroffen werden, ist es wahrscheinlicher, dass Teams das Tool offen nutzen, anstatt es stillschweigend zu meiden.

Was stärkere Antworten in der Regel beinhalten

Hilfreichere Antworten konzentrieren sich eher darauf, wie sich das Produkt bei normalem Gebrauch verhält, als auf Extremfälle.

- Klare Erläuterung der Standardeinstellungen

- Einfache Beschreibung des Zugangs in alltäglichen Situationen

- Ehrliche Anerkennung von Grenzen oder Einschränkungen

- Dokumentation, die widerspiegelt, wie das Tool tatsächlich verwendet wird

Diese Art von Details erleichtert es Teams, Tools verantwortungsbewusst einzuführen und langfristig zu unterstützen.

Auf der Suche nach Beweisen jenseits von Gesprächen

Die Bewertung ist aussagekräftiger, wenn sie über Verkaufsgespräche hinausgeht und sich auf unabhängig davon vorhandene Belege stützt.

Öffentlich zugängliche Sicherheits- oder Vertrauenszentren, die auf dem neuesten Stand gehalten werden, Dokumentationen, die klar erklären, wie Aufzeichnung und Transkription in der Praxis funktionieren, und transparente Beschreibungen darüber, wie Daten zwischen Systemen übertragen werden, machen einen Unterschied. Unabhängige Audits, die die tatsächliche Nutzung und nicht nur abstrakte Compliance widerspiegeln, verleihen dem Ganzen zusätzliches Gewicht. Die Verfügbarkeit dieser Materialien erleichtert es den Sicherheits-, Rechts- und Betriebsteams, sich frühzeitig abzustimmen und eine verantwortungsvolle Einführung im Laufe der Zeit zu unterstützen.

Wie verantwortungsbewusste Anbieter Datenschutzrisiken in der Praxis mindern

Verantwortungsbewusste Anbieter mindern Datenschutzrisiken durch konkrete Produktentscheidungen statt durch allgemeine Zusicherungen. Diese Entscheidungen zeigen sich darin, wie die Aufzeichnung funktioniert, wer auf Inhalte zugreifen kann, wie lange Daten gespeichert werden und wie die KI-Verarbeitung hinter den Kulissen gehandhabt wird.

Einer der sichtbarsten Bereiche ist die Aufzeichnung selbst. Verantwortungsbewusste Tools machen die Aufzeichnung explizit und nicht versteckt. Im Fall tl;dvwerden Besprechungen durch einen sichtbaren Bot aufgezeichnet, der an dem Anruf teilnimmt, sodass die Aufzeichnung für alle Teilnehmer sichtbar ist. Gastgeber können die Aufzeichnung starten oder stoppen, und die Aufzeichnung ist nicht dafür ausgelegt, still im Hintergrund zu laufen. Dies verringert das Risiko von Überraschungen und unterstützt eine informierte Teilnahme von Anfang an.

Der Zugriff auf aufgezeichnete Inhalte ist ein weiterer Bereich, in dem die Umsetzung eine wichtige Rolle spielt. tl;dv den Zugriff auf Aufzeichnungen und Transkripte auf Arbeitsbereichsebene, anstatt Inhalte standardmäßig für alle sichtbar zu machen. Das bedeutet, dass Aufzeichnungen nur für Personen innerhalb des entsprechenden Arbeitsbereichs verfügbar sind und die Weitergabe außerhalb dieses Kontexts kontrolliert wird. Dieser Ansatz begrenzt die unbeabsichtigte Verbreitung und passt den Zugriff an den ursprünglichen Kontext der Besprechung an.

Die Aufbewahrung und Löschung werden als operative Kontrollen und nicht als Ausnahmefälle behandelt. tl;dv Teams festlegen, wie lange Aufzeichnungen und Transkripte verfügbar bleiben sollen, und durch die Löschung werden die zugrunde liegenden Besprechungsdaten nicht nur ausgeblendet, sondern vollständig entfernt. Zusammenfassungen und KI-generierte Ergebnisse unterliegen dem gleichen Lebenszyklus wie das Ausgangsmaterial, was eine vorhersehbare Handhabung im Laufe der Zeit ermöglicht.

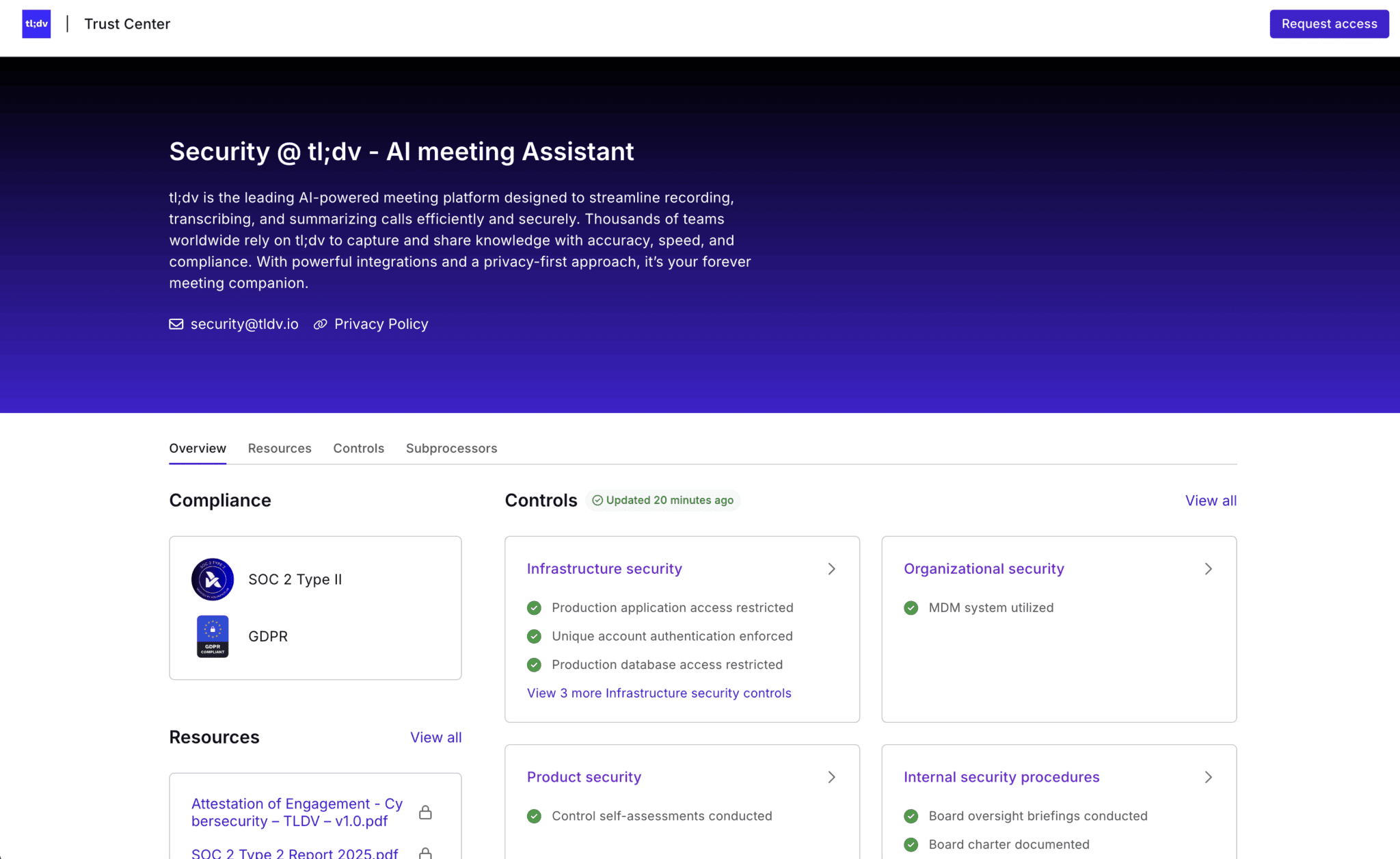

Die Grenzen der KI-Verarbeitung sind im Trust Center tl;dvausdrücklich dokumentiert.

Laut veröffentlichten Unterlagen werden Kundengesprächsdaten ausschließlich zur Bereitstellung von Funktionen wie Transkriptionen, Zusammenfassungen und Einblicken verarbeitet und nicht zum Trainieren umfassenderer KI-Modelle verwendet. Diese Unterscheidung hilft Teams bei der Bewertung des Risikos einer sekundären Nutzung, da sie eine klare Grenze hinsichtlich der Verwendung der Daten über das unmittelbare Gespräch hinaus zieht. Das Trust Center enthält auch unabhängige Artefakte wie eine SOC 2 Typ II-Bescheinigung und einen Penetrationstestbericht sowie Details zu Infrastruktur- und Organisationskontrollen, die zeigen, wie der Zugriff und die Verarbeitung im täglichen Betrieb geregelt sind.

Der Ort, an dem diese Informationen gespeichert sind, ist genauso wichtig wie der Inhalt selbst. tl;dv Verpflichtungen auf Systemebene vom täglichen Verhalten. Das Trust Center dokumentiert Sicherheit, Datenhandhabung und Verarbeitungsverfahren auf hoher Ebene, während das Hilfe-Center erklärt, wie die Aufzeichnung funktioniert, wie der Zugriff verwaltet wird und wie die Aufbewahrungseinstellungen in der Praxis angewendet werden können. Dies erleichtert es Teams, die Plattform während der Beschaffung zu bewerten und ihr Verhalten nach der Inbetriebnahme zu verstehen.

Keine dieser Maßnahmen beseitigt das Risiko vollständig. Sie reduzieren Unklarheiten. Sie begrenzen unbeabsichtigte Exposition. Sie unterstützen eine informierte Nutzung, ohne auf informelle Workarounds zurückzugreifen.

Wenn Anbieter dokumentieren, was ihre Systeme leisten, auf Transparenz achten und Teams die Kontrolle über Zugriff und Speicherung geben, wird Datenschutz zu einem integralen Bestandteil der Produktfunktionalität und nicht zu einer nachträglich hinzugefügten Funktion. So sieht verantwortungsbewusste Risikominderung in der Praxis aus.

Auswahl eines KI-Notizbuchs ohne Glücksspielvertrauen

KI-Notiznehmer befinden sich in einer unangenehmen Lage. Sie versprechen Entlastung von Verwaltungsaufgaben, bessere Erinnerung und weniger übersehene Details, berühren aber gleichzeitig den menschlichsten Teil der Arbeit, nämlich die Konversation. Es ist verständlich, dass Menschen zögern, bevor sie Tools zuhören, sich merken und zusammenfassen lassen, was sie bei der Arbeit sagen.

Dieses Zögern spiegelt ein instinktives Verständnis wider, dass sich die Lage verändert, sobald Gespräche aufgezeichnet und verarbeitet werden. Worte bleiben länger bestehen. Der Kontext verbreitet sich weiter als beabsichtigt. Was sich informell anfühlte, kann plötzlich dauerhaft erscheinen. Kontrolle gewinnt auf eine Weise an Bedeutung, wie es zuvor nicht der Fall war.

Verantwortungsbewusst zu wählen bedeutet nicht, diese Tools abzuschreiben. Es bedeutet, darauf zu achten, wie sie sich standardmäßig verhalten, wie klar sie sich erklären und ob sie eher zur chaotischen Realität echter Meetings passen als zu idealisierten. Sichtbarkeit ist immer besser als Unsichtbarkeit. Standardwerte sind wichtiger als Randfälle. Eine klare Dokumentation ist wichtiger als die Beruhigung in einem Verkaufsgespräch.

Es hilft auch, das Ausprobieren von etwas von der endgültigen Entscheidung dafür zu trennen. Viele Teams profitieren davon, diese Tools zunächst in risikoarmen Umgebungen einzusetzen, um zu sehen, wie die Aufzeichnung, der Zugriff und die Speicherung tatsächlich funktionieren, und um zu entscheiden, was akzeptabel ist, bevor sie etwas in größerem Umfang einführen. Diese Vorgehensweise berücksichtigt sowohl die Effizienz als auch die Personen, deren Gespräche aufgezeichnet werden.

Wenn Teams tiefer in die Materie einsteigen möchten, ist das stärkste Signal selten eine Demo oder ein Gespräch mit einem gewandten Vertriebsmitarbeiter. Es ist vielmehr die schriftliche Dokumentation, die ein Anbieter hinterlässt. Vertrauenszentren, Sicherheitsseiten und Hilfeartikel zeigen, wie mit Datenschutz umgegangen wird, wenn niemand versucht, Sie zu überzeugen. Sie machen es einfacher zu verstehen, was aufgezeichnet wird, wer es sehen kann, wie lange es gespeichert bleibt und wo die KI-Verarbeitung endet.

Anbieter wie tl;dv veröffentlichen dieses Material offen und ziehen dabei eine klare Grenze zwischen hochrangigen Verpflichtungen und den praktischen Details des täglichen Gebrauchs. Das gibt Teams die Möglichkeit, Behauptungen selbst zu überprüfen, anstatt sie einfach zu glauben.

Die Einführung von KI-Notizern sollte kein Sprung ins Ungewisse sein. Mit den richtigen Fragen, einer klaren Dokumentation und der Bereitschaft, bewusst vorzugehen, können Teams diese Tools nutzen, ohne das Vertrauen zu untergraben, das Meetings überhaupt erst funktionieren lässt.

Häufig gestellte Fragen zu KI und Datenschutz

Sind KI-Notizsysteme ab 2026 gemäß DSGVO legal?

Das ist möglich, jedoch nur, wenn eine eindeutige rechtliche Grundlage für die Verarbeitung vorliegt, vor der Aufzeichnung eine ordnungsgemäße Offenlegung erfolgt ist und Kontrollen für den Zugriff, die Speicherung und die Löschung vorhanden sind. Eine einfache Benachrichtigung der Teilnehmer nachträglich reicht nicht aus.

Verwenden KI-Notiznehmer Besprechungsdaten, um ihre Modelle zu trainieren?

Das hängt vom Anbieter ab. Einige Tools geben an, dass Kundendaten nicht für das Modelltraining verwendet werden, während andere sich möglicherweise auf umfassendere Verarbeitungsvereinbarungen stützen. Überprüfen Sie die Dokumentation immer sorgfältig, anstatt sich auf Marketingaussagen zu verlassen.

Sollten KI-Notizsysteme in Personal-, Rechts- oder Finanzbesprechungen eingesetzt werden?

Diese Kontexte sind besonders sensibel, da Gespräche oft vertrauliche oder wichtige Informationen enthalten. Viele Teams beschränken oder vermeiden Aufzeichnungen in diesen Situationen, es sei denn, es besteht ein klarer, dokumentierter Bedarf und es sind strenge Datenkontrollen vorhanden.

Was sollten wir vor der Auswahl eines KI-Notizprogramms überprüfen?

Überprüfen Sie, wo Daten gespeichert werden, wie lange sie aufbewahrt werden, wer standardmäßig darauf zugreifen kann, ob Aufzeichnungen und Transkripte durch Löschen vollständig entfernt werden, wie die KI-Verarbeitung funktioniert und ob der Anbieter transparente Sicherheits- und Vertrauensdokumente bereitstellt, die die tatsächliche Nutzung widerspiegeln.