A IA conquistou espaço em algumas das áreas mais sensíveis do trabalho cotidiano em 2026. Reuniões que antes ficavam registradas em cadernos ou memórias distantes agora são gravadas, transcritas, resumidas e armazenadas, muitas vezes automaticamente, por padrão e sem que as equipes parem para pensar no que isso significa para a privacidade. É por isso que as conversas sobre IA e privacidade se tornaram tão delicadas, especialmente quando se trata de anotadores de IA, que se encontram na interseção entre conveniência e risco.

Passo muito tempo escrevendo sobre esse assunto, e o padrão é sempre o mesmo. As equipes não são contra a IA. Elas estão ocupadas, sobrecarregadas e genuinamente gratas por ferramentas que eliminam tarefas administrativas do seu dia a dia. Ao mesmo tempo, elas se sentem desconfortáveis. Querem saber para onde vão suas conversas, quem pode acessá-las, por quanto tempo são mantidas e se essas gravações estão sendo reutilizadas de maneiras que elas não concordaram. Essas preocupações são razoáveis.

Aqui, vamos analisar a IA e a privacidade através de uma lente muito específica: os gravadores de IA em 2026. Não se trata de ética abstrata e argumentos de venda difíceis. Apenas os riscos reais que essas ferramentas apresentam, como esses riscos se manifestam na prática e o que as equipes devem entender antes de gravar e confiar suas conversas a um sistema de IA.

Quer você já utilize um Anotador de Reuniões com IA ou ainda esteja pensando em como isso pode influenciar seu dia a dia profissional, este artigo lhe dará algumas dicas importantes a serem consideradas ao escolher um Anotador de Reuniões com IA ou ao mudar para outro fornecedor.

TL;DR

Os anotadores de IA economizam tempo, mas também transformam conversas informais ao vivo em registros permanentes e pesquisáveis que aumentam os riscos reais à privacidade em relação ao consentimento, atribuição, retenção, treinamento de modelos e uso secundário.

As equipes têm razão em questionar como as gravações são armazenadas, quem pode acessá-las, por quanto tempo são mantidas e se os dados são reutilizados além da criação de notas.

A adoção responsável significa verificar a base legal, a minimização, os direitos de exclusão, as políticas de treinamento e as configurações padrão e, em seguida, escolher fornecedores que tornem a gravação visível, limitem o acesso, documentem o processamento de forma clara e deem às equipes controle real sobre a retenção e a remoção.

O que torna os aplicativos de anotações com IA um risco único à privacidade

Nem todas as ferramentas de IA criam o mesmo tipo de exposição de privacidade. Um assistente de design ou um modelo de análise de dados normalmente trabalha com informações que os usuários optam por inserir deliberadamente e, muitas vezes, após algum nível de revisão. Os anotadores de IA são diferentes disso. Eles operam em conversas ao vivo, faladas em tempo real, muitas vezes contendo pensamentos não filtrados, contextos sensíveis e informações que nunca deveriam ser capturadas literalmente.

Essa diferença é importante porque altera tanto a natureza dos dados que estão sendo processados quanto as expectativas das pessoas em relação ao controle, consentimento e uso posterior.

Gravação de conversas ao vivo

A primeira e mais óbvia mudança ocorre no momento em que uma reunião é gravada. Conversas ao vivo não são documentos estáticos. Elas são fluidas, contextuais e, muitas vezes, exploratórias. As pessoas falam de maneira diferente quando acreditam que uma conversa é temporária. Elas especulam, se corrigem, testam ideias e compartilham informações que talvez nunca colocariam por escrito.

Quando um Anotador de Reuniões com IA uma reunião, ele transforma essa troca transitória em um artefato permanente. Isso cria um risco à privacidade antes mesmo de qualquer processamento de IA começar. A gravação captura o tom, a intenção, os comentários paralelos e os momentos que nunca deveriam ser preservados fora da sala. Em muitas organizações, é aí que começa o desconforto, especialmente quando as gravações acontecem automaticamente ou quando os participantes não estão totalmente cientes do que está sendo capturado.

Há também uma lacuna de consentimento que as equipes muitas vezes subestimam. Em reuniões distribuídas ou entre empresas, nem todos os presentes podem pertencer à mesma organização ou operar sob as mesmas políticas. Gravar uma conversa ao vivo levanta questões sobre quem concordou em ser gravado, como esse consentimento foi obtido e se ele resistiria a um escrutínio posterior.

Transcrição e atribuição do locutor

A transcrição acrescenta uma segunda camada de risco ao transformar a fala em texto. A linguagem falada é confusa. Ela inclui interrupções, sobreposições, falsos começos e frases informais que podem ser interpretadas de maneira muito diferente quando escritas. Uma transcrição congela esses momentos de uma forma que pode parecer expositiva, especialmente quando atribuída a falantes identificados.

A atribuição do locutor aumenta ainda mais a sensibilidade. Identificar quem disse o quê cria um registro pesquisável de contribuições, opiniões e declarações individuais. Em reuniões internas, isso pode afetar a confiança, especialmente quando há dinâmicas de poder envolvidas. Em reuniões externas, levanta questões sobre se clientes, parceiros ou candidatos esperam que suas palavras sejam permanentemente atribuídas e armazenadas.

A precisão é importante aqui, mas a interpretação também. Atribuições incorretas, transcrições parciais ou perda de contexto podem criar registros que não refletem o que realmente se pretendia, mas que ainda assim existem como documentos com aparência oficial. Do ponto de vista da privacidade, isso diz respeito ao risco à reputação e à justiça.

Armazenamento, retenção e pesquisabilidade

Depois que uma reunião é gravada e transcrita, ela precisa ser armazenada em algum lugar. É no armazenamento que muitas preocupações abstratas com a privacidade se tornam concretas. As equipes muitas vezes não sabem por quanto tempo as gravações são mantidas, onde estão hospedadas ou quem pode acessá-las por padrão.

A capacidade de pesquisa amplifica esse risco. A capacidade de pesquisar meses ou anos de dados de reuniões é poderosa, mas também significa que informações confidenciais podem vir à tona muito tempo depois que o contexto original já tiver desaparecido. Um comentário casual feito em uma sessão de brainstorming pode ressurgir durante auditorias, disputas ou revisões internas, separado das condições em que foi feito.

As políticas de retenção são, portanto, fundamentais, mas frequentemente negligenciadas. A retenção ilimitada parece conveniente, mas aumenta a exposição ao longo do tempo. Quanto mais tempo os dados existirem, maior será a chance de serem acessados, usados indevidamente ou violados. Equipes preocupadas com a privacidade perguntam cada vez mais não apenas onde os dados são armazenados, mas por quanto tempo eles permanecem lá e com que facilidade podem ser removidos.

Processamento de IA, resumos, destaques e itens de ação

Os anotadores de IA oferecem muito mais do que transcrição. Eles resumem discussões, extraem destaques, geram itens de ação e, às vezes, inferem intenções ou prioridades. Essa camada de processamento introduz considerações adicionais de privacidade.

Os resumos são interpretações. Eles condensam conversas complexas em narrativas simplificadas, que podem alterar a ênfase ou omitir nuances. Os destaques e os itens de ação muitas vezes revelam decisões ou responsabilidades que os participantes não definiram explicitamente dessa forma. Embora úteis, esses resultados podem criar registros que parecem mais definitivos do que a conversa subjacente realmente foi.

Do ponto de vista da privacidade, a preocupação não é apenas que a IA processe os dados, mas como esses resultados são usados e compartilhados. Os resumos são mais propensos a serem encaminhados, armazenados em ferramentas de projeto ou referenciados posteriormente, ampliando o alcance da conversa original além do público-alvo pretendido.

Há também a questão do acesso ao modelo. As equipes querem entender se os dados das reuniões são processados em ambientes isolados, se são retidos após o processamento e se são expostos a sistemas além da tarefa imediata de gerar notas.

Risco de uso secundário e receios relativos à formação de modelos

Uma das preocupações mais persistentes em relação aos anotadores de IA é o uso secundário. As equipes temem que suas conversas possam ser reutilizadas para fins não pretendidos, como melhorar modelos, treinar sistemas futuros ou gerar insights além do escopo da reunião original.

Esses receios não são infundados. No ecossistema mais amplo da IA, a reutilização de dados é comum e as mensagens dos fornecedores são frequentemente vagas. Declarações como “não treinamos com seus dados” podem ocultar detalhes importantes sobre processamento temporário, anonimização ou aprendizagem agregada.

Para organizações preocupadas com a privacidade, a questão principal é o controle. Elas querem respostas claras e verificáveis sobre se os dados das reuniões contribuem para o treinamento de modelos de alguma forma, se existem mecanismos de exclusão e como esses compromissos são cumpridos tecnicamente, e não apenas contratualmente.

O risco de uso secundário também se estende internamente. Mesmo que um fornecedor lide com os dados de forma responsável, as organizações devem considerar como os dados registrados e processados das reuniões podem ser reutilizados por suas próprias equipes de maneiras que os participantes não previram.

É por isso que os anotadores de IA parecem diferentes

Em conjunto, esses fatores explicam por que os anotadores de IA parecem ser mais sensíveis do que outras ferramentas de IA. Eles operam com base em comunicações humanas espontâneas, criam registros duradouros a partir de trocas temporárias e sobrepõem interpretações aos dados brutos.

O risco à privacidade não é uma irregularidade inerente. É a exposição. Compreender essa distinção é o primeiro passo para avaliar essas ferramentas de forma responsável, em vez de reagir com aceitação total ou rejeição absoluta.

As verdadeiras preocupações das equipes e por que elas não são irracionais

Quando as equipes hesitam em relação aos anotadores de IA, é tentador interpretar essa resistência como medo da mudança. Na prática, as preocupações levantadas pelas pessoas são específicas, situacionais e, muitas vezes, baseadas em experiências diretas. Basta passar algum tempo em comunidades de profissionais para perceber que os mesmos temas surgem repetidamente, independentemente da função ou do setor.

Reuniões internas e segurança psicológica

Um dos primeiros pontos de tensão em torno dos anotadores de IA surge em reuniões internas, onde a conversa é exploratória e muitas vezes inconclusiva. As equipes descrevem repetidamente uma mudança quando a gravação entra na sala. As pessoas diminuem o ritmo. A linguagem se torna mais restrita. As ideias se tornam mais seguras antes de se tornarem melhores.

Essa mudança fica clara em uma longa discussão no Reddit sobre a ética das ferramentas de anotações com IA no trabalho. Na discussão, o autor da publicação original descreve a introdução de um Anotador de Reuniões com IA sua equipe e como isso foi recebido com desconforto, em vez de interesse. Um colega pediu para ser informado antes de cada reunião se a gravação estava ocorrendo, dizendo que não gostava de ser gravado, mesmo que não impedisse ativamente.

As respostas deixam claro que essa reação é comum. Um comentarista escreveu: “Sempre perguntamos aos participantes se podemos gravá-los antes de qualquer reunião. Isso é profissionalismo básico.” Outro disse: “Se eu descobrisse que você me gravou sem consentimento, eu o denunciaria ao RH. É uma violação grave de privacidade.”

O que se destaca na discussão é que poucas pessoas se opõem à tomada de notas em si. A preocupação centra-se na permanência e na perda de controle uma vez que a linguagem falada é capturada e processada. Um usuário explicou: “Não quero que minhas palavras sejam inseridas em uma IA para produzir um ‘resumo’, porque não confio que ela produza um resumo preciso”. Esse desconforto está relacionado ao risco de o contexto ser simplificado e a intenção ser mal interpretada.

Vários comentadores também descreveram como a gravação altera o comportamento do grupo ao longo do tempo. As pessoas afirmaram sentir-se confortáveis quando a gravação era anunciada, mas opunham-se veementemente à gravação surpresa, que muitos descreveram como desonesta. Outros manifestaram preocupação com o facto de ferramentas de terceiros transferirem conversas internas para fora dos sistemas aprovados, com um comentador a questionar se alguém se sentiria realmente confortável com “todas as discussões internas da empresa” a serem enviadas para outro local.

Em conjunto, essas respostas apontam para a mesma questão subjacente. A segurança psicológica depende de as pessoas se sentirem capazes de pensar em voz alta, mudar de posição e falar de forma imperfeita. Quando as reuniões são rotineiramente gravadas, transcritas, atribuídas e armazenadas, essa liberdade diminui. As conversas tornam-se mais cautelosas e menos abertas, o que molda o que é dito e o que nunca é dito.

As equipes envolvidas nessas discussões descrevem menos ideias provisórias e uma participação mais cautelosa quando a gravação se torna rotina. Essa mudança afeta a forma como os problemas são explorados e como as decisões são tomadas, e é por isso que o desconforto em relação à gravação interna não pode ser descartado como uma simples relutância em adotar novas ferramentas.

Chamadas de clientes e confiança externa

As chamadas de clientes e consumidores apresentam um tipo diferente de risco, pois as pessoas do outro lado da linha estão fora do controle da organização. Elas não compartilham políticas internas, não concordaram com as escolhas de ferramentas internas e, muitas vezes, trazem informações confidenciais para a conversa sem saber como elas podem ser tratadas.

Essa diferença nas expectativas fica clara em outra discussão no Reddit sobre por que muitos profissionais evitam ferramentas para anotações. Um assistente executivo descreveu um cenário jurídico em que um cliente aceitaria que um colega júnior participasse de uma chamada, mas se oporia imediatamente à Anotador de Reuniões com IA um Anotador de Reuniões com IA . A conclusão foi simples. As pessoas se sentem mais à vontade para confiar em outra pessoa do que em um sistema automatizado quando o que está em jogo é algo pessoal.

Em outras partes do tópico, os comentaristas descreveram organizações que removem ou bloqueiam ativamente os anotadores de IA das reuniões, argumentando que conversas confidenciais muitas vezes entram em território sensível sem aviso prévio.

A preocupação aqui não é a gravação em si, mas a perda de controle quando a conversa sai da chamada. Os clientes podem esperar anotações. Eles raramente esperam que suas palavras sejam armazenadas, pesquisáveis e processadas por um sistema de IA que outras pessoas possam revisitar posteriormente.

Vários participantes observaram que as conversas com os clientes não se limitam estritamente aos limites da agenda. As chamadas de rotina podem rapidamente passar para o âmbito pessoal, financeiro ou jurídico, o que torna a gravação generalizada algo arriscado.

Por isso, muitas organizações adotam uma abordagem cautelosa. Algumas limitam o uso de assistentes de IA para uso interno. Outras exigem aprovação explícita para chamadas externas. Algumas evitam-nas completamente em ambientes de atendimento ao cliente, priorizando a confiança em detrimento da conveniência.

É por isso que as chamadas externas continuam sendo um dos contextos mais delicados para os assistentes de IA. A questão não é a permissão no papel. É se a ferramenta atende às expectativas das pessoas do outro lado da linha.

Conversas sobre RH, questões jurídicas e finanças

Esse sentimento surge repetidamente quando pessoas que trabalham com informações confidenciais falam sobre ferramentas de transcrição de IA. Ele reflete uma limitação prática, e não uma postura filosófica. Em ambientes de RH, jurídico e financeiro, as reuniões já são tratadas como confidenciais por padrão, e pequenas incertezas acarretam riscos desproporcionais.

Nesses contextos, as pessoas estão plenamente conscientes de que as palavras não existem isoladamente. O significado depende do tom, do momento e da intenção, e tudo isso pode se perder quando a conversa é transformada em um registro duradouro. Uma conversa sobre desempenho, uma discussão sobre demissão ou uma sessão de estratégia jurídica mudam de caráter quando se tornam pesquisáveis e passíveis de revisão posterior por alguém que não estava presente.

As preocupações em torno da reutilização aumentam essa inquietação. Os profissionais frequentemente apontam que as políticas de privacidade podem permitir que áudios ou transcrições sejam usados para fins além da criação de notas, incluindo treinamento de modelos ou compartilhamento em sistemas mais amplos. Mesmo quando essas práticas são divulgadas, a possibilidade de uso secundário parece incompatível com conversas que pressupõem confidencialidade estrita.

Há também uma forte preferência nessas funções por manter o controle próximo. O processamento no dispositivo é frequentemente mencionado como mais aceitável do que uploads baseados em nuvem, pois reduz a incerteza sobre para onde os dados são enviados e quem poderá acessá-los posteriormente. Essa distinção é mais importante quando há consequências legais, financeiras ou trabalhistas associadas ao modo como as informações são tratadas.

Como resultado, as equipes de RH, jurídica e financeira tendem a agir de forma conservadora. Elas dependem de anotações manuais. Limitam os registros. Evitam ferramentas que transformam discussões delicadas em artefatos duradouros. Essas decisões não têm a ver com resistência à mudança. Elas refletem o entendimento de que, uma vez que certas conversas são capturadas e processadas, a exposição não pode ser revertida.

Nesses ambientes, a contenção é uma resposta racional ao peso que essas conversas carregam.

Consentimento e confiança dos funcionários

Uma das preocupações mais intensas em relação aos anotadores de IA é se os funcionários realmente têm a opção de ser gravados e transcritos. No papel, as empresas costumam lidar com isso por meio de políticas ou notificações no aplicativo. Na prática, isso faz com que muitas pessoas sintam que têm pouco controle real sobre como suas palavras são capturadas e utilizadas.

Profissionais e comentaristas especializados em privacidade chamaram a atenção para essa questão de forma clara. Alguns especialistas argumentam que os anotadores de IA confundem os limites entre notificação passiva e consentimento ativo e informado, pois os participantes muitas vezes só descobrem que uma ferramenta os gravou após o fato, quando a gravação ou transcrição aparece em seus arquivos ou quando ocorrem discussões sobre retenção e reutilização. Isso levanta questões sobre a liberdade com que o consentimento é dado e o que os participantes realmente entendem sobre o que aconteceu com os dados de suas reuniões.

Um artigo recente sobre as preocupações com os anotadores de IA explicou que a mera presença de um ouvinte automatizado em uma reunião pode criar uma sensação de estar sendo observado ou vigiado, o que altera a forma como as pessoas falam e participam. Os funcionários podem acabar filtrando a linguagem, evitando incertezas ou reprimindo contribuições porque sabem que suas palavras estão sendo capturadas e armazenadas de maneiras que vão muito além do momento em que a conversa termina.

Esta questão surge na orientações de profissionais de privacidade e proteção de dados que enfatizam que o consentimento em estruturas como o GDPR deve ser informado, específico e significativo. Por exemplo, as organizações devem informar aos participantes não apenas que o áudio será gravado, mas também quais dados serão capturados, onde serão armazenados, por quanto tempo permanecerão armazenados e quem terá acesso a eles. Detalhes que muitas vezes ficam ocultos nos convites para reuniões ou nos termos de serviço da plataforma, em vez de serem explicitados antes do início da gravação.

Gravação oculta e ferramentas não autorizadas

Um dos padrões mais incômodos que surgem em torno dos aplicativos de anotações com IA é que regras pouco claras e restrições generalizadas não impedem a gravação. Elas apenas mudam o local onde isso ocorre.

Muitas vezes, quando as ferramentas oficiais parecem restritivas ou mal explicadas, as pessoas procuram alternativas. Contas pessoais, extensões de navegador, aplicativos locais e ferramentas projetadas para evitar a detecção começam a aparecer. Uma Discussão sobre segurança cibernética sobreachamada“IA paralela”descreveu uma organização que descobriu centenas de Anotador de Reuniões com IA não autorizadas Anotador de Reuniões com IA operando sem aprovação, visibilidade ou supervisão. Esse comportamento não é surpreendente. Os funcionários costumam baixar um aplicativo para anotações minutos antes de uma chamada importante ou ativar funcionalidades que já existem nas ferramentas que usam todos os dias, como o Google Gemini o Microsoft 365. A gravação não parece uma decisão separada quando está incorporada a um software familiar e é apresentada como uma conveniência padrão, em vez de uma escolha de política.

O resultado é um risco fragmentado. As gravações acabam espalhadas por contas pessoais, locais de armazenamento não gerenciados e sistemas que ninguém da área de TI ou segurança tem visibilidade. As regras de retenção são inconsistentes. O acesso não é claro. A reutilização dos dados torna-se impossível de rastrear.

É por isso que as proibições generalizadas tendem a ter o efeito contrário ao desejado. Quando a gravação é tratada como algo a ser suprimido, em vez de regulamentado, ela não desaparece. Torna-se apenas mais difícil de ver. O uso não oficial gera mais exposição do que as ferramentas que são abertamente adotadas, claramente explicadas e compreendidas pelas pessoas que as utilizam.

A gravação oculta não é uma falha de julgamento do funcionário. É um sinal de que a distância entre a política e a realidade cotidiana se tornou muito grande.

Por que essas preocupações merecem atenção

Em conjunto, essas preocupações não são irracionais nem hostis em relação à IA. Elas refletem uma visão clara de como os anotadores de IA alteram o ciclo de vida da comunicação no local de trabalho de maneiras que as pessoas podem sentir imediatamente.

As pessoas estão reagindo à permanência, atribuição, pesquisabilidade e reutilização, além de uma mudança em quem controla o que acontece com suas palavras após o término de uma reunião. Essas reações estão na interseção entre emoção e consequência. Conversas que antes desapareciam agora persistem. O contexto não é transmitido adequadamente. A propriedade parece confusa.

Reconhecer que a realidade é importante. Sem compreender como essas ferramentas mudam o comportamento e as expectativas, é fácil descartar o desconforto como resistência ou confiar excessivamente em garantias que parecem suficientes no papel, mas que na prática se revelam insuficientes.

Esse contexto é o ponto de partida para qualquer avaliação significativa de como os aplicativos de anotações com IA lidam com a privacidade.

A regulamentação de privacidade em torno dos assistentes de IA é frequentemente reduzida a uma simples formalidade. Algumas equipes tratam isso como algo que pode ser resolvido com um simples clique. Outras veem isso como um assunto que deve ser evitado, a menos que envolva questões legais. Nenhuma das duas abordagens reflete como essas regras se aplicam quando a gravação se torna parte do trabalho diário.

Estruturas como o GDPR são importantes aqui porque os anotadores de IA lidam com conversas faladas. As pessoas falam de maneira diferente do que escrevem. Elas se corrigem no meio da frase. Elas compartilham contextos que talvez nunca colocariam em um documento. A regulamentação se torna relevante justamente porque esses momentos estão sendo capturados e mantidos.

Questões a considerar ao analisar os aplicativos de anotações com IA

Existem muitas razões pelas quais as pessoas precisam fazer uma análise cuidadosa antes de mergulhar no Anotador de Reuniões com IA certo Anotador de Reuniões com IA suas operações comerciais. Aqui estão apenas alguns pontos a serem considerados ao fazer essa escolha.

1) Base jurídica, consentimento e interesse legítimo

Uma das primeiras perguntas que as equipes fazem é se todos os participantes da reunião precisam concordar com a gravação. A resposta raramente é simples, e é aí que muitas vezes começa o desconforto.

De acordo com o GDPR, as organizações precisam de uma base legal para processar dados pessoais. O consentimento é uma opção. O interesse legítimo é outra. Muitas ferramentas de trabalho dependem do interesse legítimo, partindo do princípio de que o processamento apoia um objetivo comercial razoável e não se sobrepõe aos direitos individuais.

Os anotadores de IA estão próximos dessa suposição. A maioria das pessoas espera que sejam feitas anotações. Poucos esperam que suas palavras exatas sejam capturadas e processadas por um sistema automatizado. Essa diferença entre expectativa e realidade é importante, mesmo quando a base legal é tecnicamente sólida.

É por isso que a divulgação tem tanto peso. Quando o consentimento não é a base, as pessoas ainda precisam entender o que está acontecendo com seus dados antes que isso ocorra, e não depois que uma transcrição aparece.

Se alguém participasse da sua reunião esperando anotações em vez de um registro permanente, essa pessoa sentiria que teve uma escolha real?

2) Minimização de dados em um mundo de transcrições completas

A minimização de dados parece teórica até entrar em conflito com uma reunião gravada.

A ideia em si é simples. As organizações devem coletar e manter apenas o que precisam. Os anotadores de IA geralmente fazem o contrário por padrão, capturando tudo porque é fácil de fazer e útil para pesquisar posteriormente.

Isso não torna essas ferramentas incompatíveis com a regulamentação. Significa apenas que as equipes precisam decidir o que realmente precisam. Gravações completas podem ser úteis. Também podem ser desnecessárias. Transcrições podem ser valiosas por um tempo. Talvez não precisem existir para sempre.

A minimização aqui diz respeito à intenção. Que problema está sendo resolvido e quantos dados estão sendo mantidos para resolvê-lo?

Se um resumo satisfaria a necessidade, por que manter a conversa inteira?

3) Direitos de acesso, exclusão e controle

A regulamentação deixa de parecer abstrata quando alguém solicita acesso aos seus dados.

De acordo com o RGPD, as pessoas têm o direito de acessar seus dados pessoais e, em muitos casos, solicitar que eles sejam removidos. Quando as reuniões são gravadas e transcritas, esses direitos se estendem tanto às contribuições faladas quanto às escritas.

Isso introduz exigências operacionais reais. As equipes precisam saber onde as gravações estão armazenadas (de preferência em um único espaço unificado) e como agir em relação às solicitações sem precisar adivinhar. É aqui que as ferramentas são importantes. As configurações de retenção e os processos de exclusão deixam de ser um diferencial e passam a ser necessários.

Sem esses controles, mesmo equipes bem-intencionadas podem se ver em uma situação complicada.

Se alguém lhe pedisse para remover suas contribuições de reuniões anteriores, você conseguiria fazer isso de forma limpa?

4) Limitação da finalidade e uso secundário

A limitação da finalidade diz respeito aos limites.

De acordo com o RGPD, os dados pessoais devem ser coletados por um motivo específico e explícito. Não podem ser discretamente expandidos para novos usos posteriormente sem uma justificativa clara e transparência.

Com os anotadores de IA, o objetivo declarado é geralmente direto. Capturar a reunião. Gerar notas. Facilitar a recuperação de informações.

A questão mais difícil é o que acontecerá a seguir.

A gravação permanece restrita a esse propósito ou começa a servir para outros fins? Ela é analisada para obter insights de desempenho? É inserida em sistemas de análise? É usada para treinar modelos? É compartilhada em ferramentas internas mais amplas?

Essas extensões não são automaticamente ilegais. No entanto, exigem clareza. Se o objetivo original era tomar notas, qualquer uso mais amplo precisa ser definido e comunicado desde o início.

É aqui que a confiança pode ser abalada. As pessoas podem aceitar a gravação para fins de documentação. Elas podem se sentir de maneira diferente se os mesmos dados forem usados para análises não relacionadas ou desenvolvimento de modelos.

A limitação da finalidade impõe uma disciplina simples. Por que isso foi coletado e ainda está sendo usado para esse fim?

Se o escopo foi ampliado, isso ficou claro?

Se os dados superassem as expectativas dos participantes, essa surpresa seria aceitável?

Por que as equipes centradas na UE são cautelosas por natureza

Os reguladores europeus têm uma posição firme em relação à monitorização no local de trabalho e ao desequilíbrio de poder. Os assistentes de IA afetam ambas as áreas ao mesmo tempo, o que explica por que razão as equipas centradas na UE costumam agir com cautela.

Essa cautela geralmente aparece logo no início. As equipes pensam na retenção antes da implementação. Elas perguntam sobre o acesso antes de habilitar a gravação. Elas buscam justificativas em vez de adaptar regras posteriormente.

Esta é uma tentativa de evitar problemas difíceis de resolver uma vez que a confiança seja perdida.

Como avaliar um Anotador de Reuniões com IA

Depois que as equipes aceitam que os aplicativos de anotações com IA levantam questões reais de privacidade e segurança, o próximo desafio é escolher um com cuidado. É aí que muitas avaliações ficam paralisadas, não porque as pessoas estejam desmotivadas, mas porque fica difícil saber como uma ferramenta se comportará quando passar da fase de demonstração para o uso diário.

A avaliação responsável concentra-se nos resultados, e não nas garantias. O objetivo é compreender o que acontece aos dados das reuniões ao longo do tempo, em diferentes situações e quando surgem casos extremos.

1) Comece com perguntas que descrevam comportamentos

As avaliações iniciais geralmente se concentram em determinar se uma ferramenta atende aos requisitos regulatórios. Isso é importante, mas raramente conta toda a história. Informações mais úteis vêm da compreensão de como o sistema opera por padrão.

- Onde os dados da reunião são armazenados, incluindo as regiões envolvidas

- Por quanto tempo as gravações e transcrições ficam disponíveis antes de serem removidas?

- Quem pode visualizar gravações, transcrições ou resumos após uma reunião

- Se o acesso muda com base na função, no espaço de trabalho ou na propriedade

- O que acontece com os dados quando alguém sai da organização?

Ferramentas que lidam bem com essas áreas facilitam para as equipes explicarem o uso internamente e aplicarem regras consistentes sem atritos.

2) Consentimento, divulgação e expectativas

A gravação funciona melhor quando as pessoas entendem o que está acontecendo antes de ela começar. A avaliação deve examinar atentamente como as ferramentas comunicam o status da gravação em reuniões reais.

- Notificação clara quando a gravação começa

- Capacidade de ativar ou desativar a gravação por reunião

- Tratamento previsível dos participantes que se inscrevem tardiamente

- Sinais visíveis para participantes externos, como um bot

Quando a gravação é explícita e deliberada, as equipes se sentem mais à vontade para usá-la e menos propensas a criar soluções alternativas.

3) Processamento de IA e uso de modelos

A forma como os sistemas de IA interagem com os dados das reuniões é uma área de foco fundamental durante a avaliação.

- Se os dados das reuniões contribuem para o treinamento do modelo

- Se o processamento é isolado por cliente

- Quais dados permanecem após a geração dos resumos?

- Se há modelos de terceiros envolvidos

Ferramentas que explicam esses fluxos de forma clara e são projetadas para isolamento dão às equipes confiança sobre como seus dados são tratados além da reunião imediata.

4) Processamento de IA e uso de modelos

A forma como os sistemas de IA interagem com os dados das reuniões é uma área de foco fundamental durante a avaliação.

- Se os dados das reuniões contribuem para o treinamento do modelo

- Se o processamento é isolado por cliente

- Quais dados permanecem após a geração dos resumos

- Se há modelos de terceiros envolvidos

Ferramentas que explicam esses fluxos de forma clara e são projetadas para isolamento dão às equipes confiança sobre como seus dados são tratados além da reunião imediata.

5) Reconhecer respostas incompletas

Durante as avaliações, algumas respostas indicam a necessidade de uma discussão mais aprofundada.

- Reivindicações amplas de conformidade sem explicação

- Referências a certificações que não estão vinculadas a fluxos de trabalho de gravação

- Declarações sobre segurança sem detalhes sobre acesso ou retenção

- Grande dependência de políticas sem controles de sistema de apoio

Avaliações mais rigorosas tratam esses casos como motivos para esclarecimentos, e não como sinais de alerta.

6) Avaliação do impacto dentro da organização

Uma avaliação responsável também inclui pensar no uso interno.

- Como a gravação se encaixa na cultura de reuniões existente

- Quem decide quando a gravação é apropriada

- Que orientações as pessoas recebem antes de usar a ferramenta

- Como as preocupações ou recusas são tratadas

Quando essas decisões são tomadas antecipadamente, é mais provável que as equipes utilizem a ferramenta abertamente, em vez de evitá-la discretamente.

O que respostas mais fortes tendem a incluir

Respostas mais úteis concentram-se em como o produto se comporta em condições normais de uso, em vez de casos extremos.

- Explicação clara das configurações padrão

- Descrição direta do acesso em cenários do dia a dia

- Reconhecimento honesto de limites ou restrições

- Documentação que reflete como a ferramenta é realmente utilizada

Esse tipo de detalhe facilita para as equipes implementarem ferramentas de forma responsável e oferecerem suporte a elas ao longo do tempo.

Procurando evidências além da conversa

A avaliação é mais forte quando vai além das conversas de vendas e analisa evidências que existem independentemente delas.

Centros de segurança ou confiança disponíveis ao público e mantidos atualizados, documentação que explique claramente como a gravação e a transcrição funcionam na prática e descrições transparentes de como os dados se movem entre os sistemas fazem toda a diferença. Auditorias independentes que refletem o uso real, em vez de conformidade abstrata, adicionam ainda mais peso. Ter esse material disponível facilita o alinhamento antecipado das equipes de segurança, jurídica e de operações e apoia a implementação responsável ao longo do tempo.

Como fornecedores responsáveis mitigam os riscos à privacidade na prática

Os fornecedores responsáveis mitigam os riscos à privacidade por meio de decisões concretas sobre os produtos, em vez de garantias genéricas. Essas decisões se refletem na forma como a gravação funciona, quem pode acessar o conteúdo, por quanto tempo os dados permanecem armazenados e como o processamento de IA é feito nos bastidores.

Uma das áreas mais visíveis é a própria gravação. Ferramentas responsáveis tornam a gravação explícita, em vez de oculta. No caso tl;dv, as reuniões são gravadas por meio de um bot visível que participa da chamada, tornando a gravação aparente para todos os participantes. Os anfitriões podem iniciar ou interromper a gravação, e ela não foi projetada para ser executada silenciosamente em segundo plano. Isso reduz o risco de surpresas e apoia a participação informada desde o início.

O acesso ao conteúdo gravado é outra área em que a implementação é importante. tl;dv o acesso às gravações e transcrições no nível do espaço de trabalho, em vez de tornar o conteúdo universalmente visível por padrão. Isso significa que as gravações estão disponíveis apenas para pessoas dentro do espaço de trabalho relevante, e o compartilhamento fora desse contexto é controlado. Essa abordagem limita a disseminação não intencional e alinha o acesso com o contexto original da reunião.

A retenção e a exclusão são tratadas como controles operacionais, e não como casos extremos. tl;dv as equipes gerenciem por quanto tempo as gravações e transcrições permanecem disponíveis, e a exclusão remove os dados da reunião subjacentes, em vez de simplesmente ocultá-los da visualização. Os resumos e os resultados gerados por IA seguem o mesmo ciclo de vida do material de origem, o que permite um manuseio previsível ao longo do tempo.

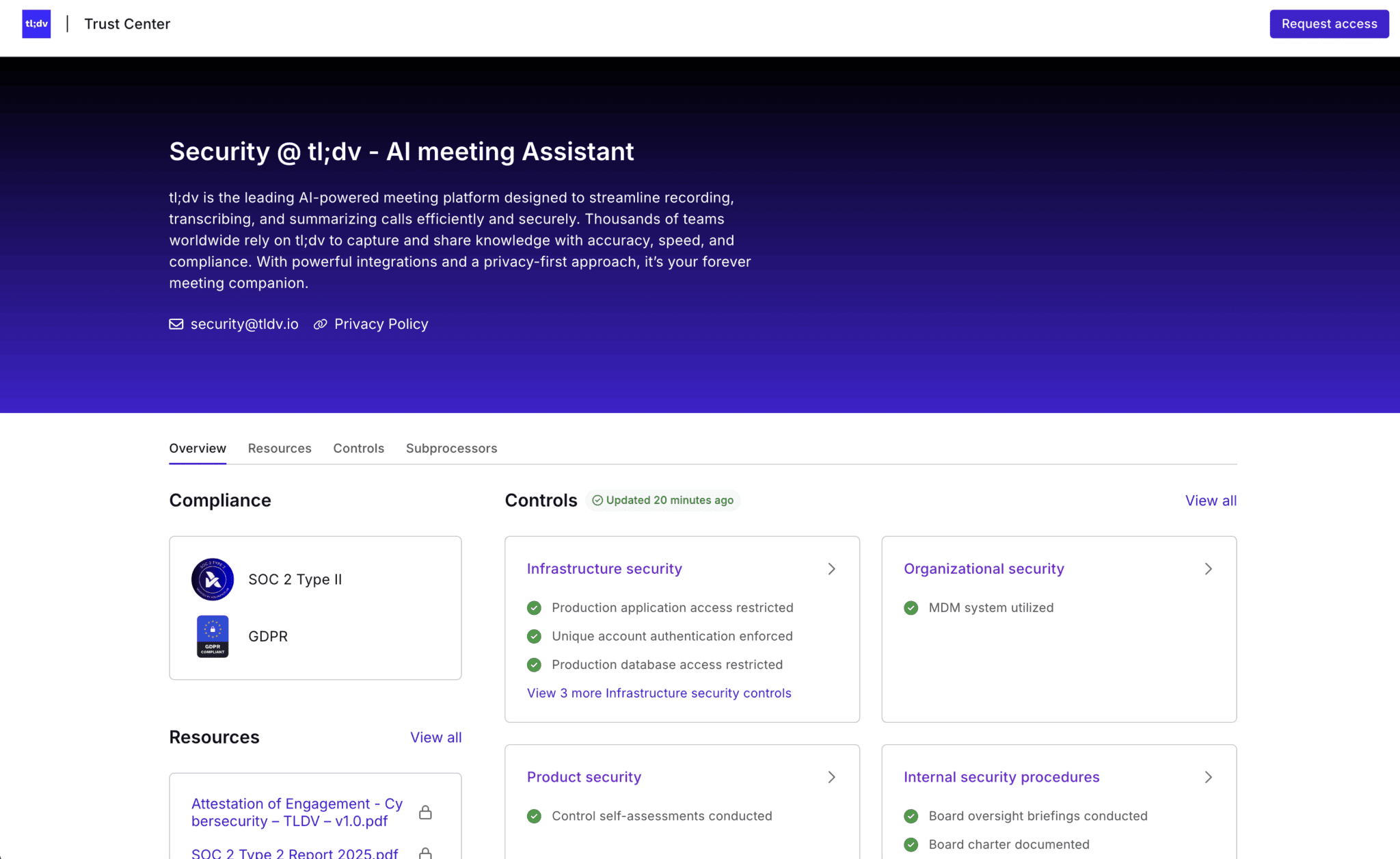

Os limites do processamento de IA estão explicitamente documentados no Centro de Confiança tl;dv.

De acordo com os materiais publicados, os dados das reuniões com os clientes são processados exclusivamente para fornecer recursos como transcrição, resumos e insights, e não são usados para treinar modelos de IA mais amplos, uma distinção que ajuda as equipes a avaliar o risco de uso secundário, pois estabelece uma linha clara sobre como os dados são tratados além da reunião imediata. O Centro de Confiança também inclui artefatos independentes, como uma certificação SOC 2 Tipo II e um relatório de teste de penetração, juntamente com detalhes sobre a infraestrutura e os controles organizacionais, mostrando como o acesso e o processamento são governados nas operações diárias.

O local onde essas informações estão armazenadas é tão importante quanto o próprio conteúdo. tl;dv os compromissos em nível de sistema do comportamento diário. Seu Centro de Confiança documenta as práticas de segurança, tratamento e processamento de dados em alto nível, enquanto sua Central de Ajuda explica como funciona a gravação, como o acesso é gerenciado e como as configurações de retenção podem ser aplicadas na prática. Isso facilita para as equipes avaliarem a plataforma durante a aquisição e compreenderem seu comportamento uma vez que ela esteja em uso.

Nenhuma dessas medidas elimina totalmente o risco. Elas reduzem a ambiguidade. Elas limitam a exposição acidental. Elas apoiam o uso informado sem depender de soluções alternativas informais.

Quando os fornecedores documentam o que seus sistemas fazem, projetam com visibilidade e dão às equipes controle sobre o acesso e a retenção, a privacidade se torna parte do funcionamento do produto, em vez de algo acrescentado posteriormente. É assim que a mitigação responsável se parece na prática.

Escolhendo um Anotador de Reuniões com IA arriscar a confiança

Os assistentes de IA que tomam notas encontram-se numa posição delicada. Prometem aliviar as tarefas administrativas, melhorar a memória e reduzir o número de detalhes perdidos, ao mesmo tempo que tocam na parte mais humana do trabalho: a conversa. É compreensível que as pessoas hesitem antes de permitir que as ferramentas ouçam, memorizem e resumam o que dizem no trabalho.

Essa hesitação reflete uma compreensão instintiva de que, uma vez que as conversas são gravadas e processadas, o terreno muda. As palavras duram mais tempo. O contexto vai além do pretendido. O que parecia informal pode, de repente, parecer permanente. O controle começa a ter importância de uma forma que não tinha antes.

Escolher com responsabilidade não significa descartar essas ferramentas. Significa prestar atenção em como elas se comportam por padrão, como se explicam com clareza e se se encaixam na realidade confusa das reuniões reais, em vez das idealizadas. A visibilidade sempre supera a invisibilidade. Os padrões são mais importantes do que os casos extremos. Uma documentação clara é mais importante do que a segurança em uma ligação de vendas.

Também ajuda a separar a experimentação de algo do compromisso com isso. Muitas equipes obtêm valor ao usar essas ferramentas primeiro em ambientes de baixo risco, observando como a gravação, o acesso e a retenção realmente funcionam e decidindo o que é aceitável antes de implementar algo de forma mais ampla. Esse tipo de ritmo respeita tanto a eficiência quanto as pessoas cujas conversas estão sendo capturadas.

Quando as equipes querem se aprofundar, o sinal mais forte raramente é uma demonstração ou uma conversa com um representante de vendas habilidoso. É o registro escrito que um fornecedor deixa para trás. Centros de confiança, páginas de segurança e artigos de ajuda mostram como a privacidade é tratada quando ninguém está tentando convencê-lo. Eles facilitam a compreensão do que é registrado, quem pode ver, por quanto tempo fica armazenado e onde o processamento de IA termina.

Fornecedores como tl;dv publicam esse material abertamente, estabelecendo uma linha clara entre compromissos de alto nível e os detalhes práticos do uso diário. Isso dá às equipes espaço para verificar as afirmações por conta própria, em vez de simplesmente acreditar nelas.

A adoção de ferramentas de IA para anotações não deve ser vista como um ato de fé. Com as perguntas certas, documentação clara e disposição para agir de forma deliberada, as equipes podem usar essas ferramentas sem comprometer a confiança que faz com que as reuniões funcionem.

Perguntas frequentes sobre IA e privacidade

A partir de 2026, os anotadores de IA serão legais de acordo com o RGPD?

Podem ser, mas apenas quando houver uma base legal clara para o processamento, divulgação adequada antes da gravação e controles em vigor para acesso, retenção e exclusão. Simplesmente notificar os participantes após o fato não é suficiente.

Os anotadores de IA utilizam dados de reuniões para treinar seus modelos?

Isso depende do fornecedor. Algumas ferramentas afirmam que os dados dos clientes não são usados para o treinamento de modelos, enquanto outras podem se basear em acordos de processamento mais amplos. Sempre verifique a documentação cuidadosamente, em vez de confiar nas alegações de marketing.

Os anotadores de IA devem ser usados em reuniões de RH, jurídicas ou financeiras?

Esses contextos exigem maior sensibilidade, pois as conversas geralmente envolvem informações confidenciais ou de alto impacto. Muitas equipes limitam ou evitam gravar nessas situações, a menos que haja uma necessidade clara e documentada e controles de dados rigorosos em vigor.

O que devemos verificar antes de escolher um Anotador de Reuniões com IA?

Observe onde os dados são armazenados, por quanto tempo são retidos, quem pode acessá-los por padrão, se a exclusão remove totalmente as gravações e transcrições, como funciona o processamento de IA e se o fornecedor oferece documentação transparente sobre segurança e confiança que reflita o uso no mundo real.