En 2026, l'IA s'est immiscée dans certains des aspects les plus sensibles du travail quotidien. Les réunions qui étaient autrefois consignées dans des carnets ou restaient gravées dans des souvenirs flous sont désormais enregistrées, transcrites, résumées et stockées, souvent automatiquement, souvent par défaut, et souvent sans que les équipes ne prennent le temps de réfléchir à ce que cela signifie pour la vie privée. C'est pourquoi les discussions sur l'IA et la vie privée sont devenues si tendues, en particulier lorsqu'il s'agit des preneurs de notes IA, qui se situent à la croisée de la commodité et du risque.

Je passe beaucoup de temps à écrire sur ce sujet, et le schéma est toujours le même. Les équipes ne sont pas contre l'IA. Elles sont occupées, débordées et sincèrement reconnaissantes de disposer d'outils qui les libèrent des tâches administratives quotidiennes. Mais en même temps, elles sont inquiètes. Elles veulent savoir où vont leurs conversations, qui peut y accéder, combien de temps elles sont conservées et si ces enregistrements sont réutilisés à leur insu d'une manière qu'elles n'ont pas approuvée. Ces préoccupations sont légitimes.

Nous allons ici examiner l'IA et la confidentialité sous un angle très spécifique, celui des preneurs de notes IA en 2026. Pas d'éthique abstraite ni de discours commercial. Juste les risques réels que ces outils présentent, la manière dont ces risques se manifestent dans la pratique et ce que les équipes doivent comprendre avant d'appuyer sur « enregistrer » et de confier leurs conversations à un système d'IA.

Que vous utilisiez déjà un outil de prise de notes basé sur l'IA ou que vous réfléchissiez encore à la manière dont celui-ci pourrait s'intégrer dans votre quotidien professionnel, cet article vous fournira des informations utiles à prendre en compte lorsque vous choisirez un outil de prise de notes basé sur l'IA ou que vous changerez de fournisseur.

TL;DR

Les preneurs de notes IA permettent de gagner du temps, mais ils transforment également les conversations informelles en direct en enregistrements permanents et consultables, ce qui soulève de réels risques en matière de confidentialité concernant le consentement, l'attribution, la conservation, la formation des modèles et l'utilisation secondaire.

Les équipes ont raison de s'interroger sur la manière dont les enregistrements sont stockés, qui peut y accéder, combien de temps ils sont conservés et si les données sont réutilisées au-delà de la création de notes.

Une adoption responsable implique de vérifier la base légale, la minimisation, les droits de suppression, les politiques de formation et les paramètres par défaut, puis de choisir des fournisseurs qui rendent l'enregistrement visible, limitent l'accès, documentent clairement le traitement et donnent aux équipes un contrôle réel sur la conservation et la suppression.

Ce qui rend les preneurs de notes IA particulièrement risqués en matière de confidentialité

Tous les outils d'IA ne présentent pas le même niveau d'exposition en matière de confidentialité. Un assistant de conception ou un modèle d'analyse de données traite généralement des informations que les utilisateurs choisissent d'entrer délibérément et souvent après un certain niveau de vérification. Les outils d'IA pour la prise de notes sont différents. Ils fonctionnent à partir de conversations en direct, prononcées en temps réel, contenant souvent des pensées non filtrées, des contextes sensibles et des informations qui n'étaient pas destinées à être retranscrites mot pour mot.

Cette différence est importante car elle modifie à la fois la nature des données traitées et les attentes des personnes en matière de contrôle, de consentement et d'utilisation en aval.

Enregistrement des conversations en direct

Le premier changement, et le plus évident, se produit au moment où une réunion est enregistrée. Les conversations en direct ne sont pas des documents statiques. Elles sont fluides, contextuelles et souvent exploratoires. Les gens parlent différemment lorsqu'ils pensent qu'une conversation est temporaire. Ils spéculent, se corrigent, testent des idées et partagent des informations qu'ils ne mettraient peut-être jamais par écrit.

Lorsqu'un assistant personnel intelligent enregistre une réunion, il transforme cet échange éphémère en un artefact permanent. Cela crée un risque pour la confidentialité avant même que le traitement par l'IA ne commence. L'enregistrement capture le ton, l'intention, les commentaires parallèles et les moments qui n'étaient pas destinés à être conservés en dehors de la salle. Dans de nombreuses organisations, c'est là que commence le malaise, en particulier lorsque les enregistrements sont automatiques ou lorsque les participants ne sont pas pleinement conscients de ce qui est capturé.

Il existe également un fossé en matière de consentement que les équipes sous-estiment souvent. Lors de réunions distribuées ou interentreprises, tous les participants n'appartiennent pas nécessairement à la même organisation ou ne sont pas soumis aux mêmes politiques. L'enregistrement d'une conversation en direct soulève des questions quant à savoir qui a accepté d'être enregistré, comment cet accord a été obtenu et s'il résisterait à un examen minutieux ultérieur.

Transcription et attribution des intervenants

La transcription ajoute un deuxième niveau de risque en transformant la parole en texte. Le langage parlé est désordonné. Il comprend des interruptions, des chevauchements, des faux départs et des expressions informelles qui peuvent être interprétées très différemment une fois écrites. Une transcription fige ces moments d'une manière qui peut sembler révélatrice, en particulier lorsqu'elle est attribuée à des locuteurs nommés.

L'attribution des propos augmente encore davantage la sensibilité. Identifier qui a dit quoi permet de créer un registre consultable des contributions, opinions et déclarations individuelles. Lors de réunions internes, cela peut avoir une incidence sur la confiance, en particulier lorsque des rapports de force sont en jeu. Lors de réunions externes, cela soulève la question de savoir si les clients, partenaires ou candidats s'attendent à ce que leurs propos soient attribués et stockés de manière permanente.

La précision est importante ici, mais l'interprétation l'est tout autant. Une attribution erronée, une transcription partielle ou une perte de contexte peuvent créer des enregistrements qui ne reflètent pas ce qui était réellement voulu, mais qui existent néanmoins comme des documents faisant autorité. Du point de vue de la confidentialité, il s'agit d'un risque pour la réputation et d'une question d'équité.

Stockage, conservation et consultabilité

Une fois qu'une réunion est enregistrée et transcrite, elle doit être stockée quelque part. C'est au niveau du stockage que de nombreuses préoccupations abstraites en matière de confidentialité deviennent concrètes. Les équipes ne réalisent souvent pas combien de temps les enregistrements sont conservés, où ils sont hébergés ou qui peut y accéder par défaut.

La possibilité d'effectuer des recherches amplifie ce risque. La possibilité d'effectuer des recherches dans des mois ou des années de données de réunion est très utile, mais cela signifie également que des informations sensibles peuvent refaire surface longtemps après que le contexte d'origine ait disparu. Une remarque faite de manière informelle lors d'une séance de brainstorming peut refaire surface lors d'audits, de litiges ou d'examens internes, sans tenir compte du contexte dans lequel elle a été faite.

Les politiques de conservation sont donc essentielles, mais souvent négligées. La conservation illimitée semble pratique, mais elle augmente l'exposition au fil du temps. Plus les données existent longtemps, plus elles risquent d'être consultées, utilisées à mauvais escient ou compromises. Les équipes soucieuses de la confidentialité demandent de plus en plus souvent non seulement où les données sont stockées, mais aussi combien de temps elles y restent et avec quelle facilité elles peuvent être supprimées.

Traitement par IA, résumés, points forts et mesures à prendre

Les preneurs de notes IA offrent bien plus que la simple transcription. Ils résument les discussions, extraient les points importants, génèrent des actions à entreprendre et, parfois, déduisent les intentions ou les priorités. Ce niveau de traitement soulève des questions supplémentaires en matière de confidentialité.

Les résumés sont des interprétations. Ils condensent des conversations complexes en récits simplifiés, qui peuvent modifier l'accent mis sur certains points ou omettre certaines nuances. Les points saillants et les mesures à prendre font souvent ressortir des décisions ou des responsabilités que les participants n'ont pas explicitement formulées de cette manière. Bien qu'utiles, ces résultats peuvent créer des comptes rendus qui semblent plus définitifs que ne l'était réellement la conversation sous-jacente.

Du point de vue de la confidentialité, le problème ne réside pas seulement dans le fait que l'IA traite les données, mais aussi dans la manière dont ces résultats sont utilisés et partagés. Les résumés sont plus susceptibles d'être transférés, stockés dans des outils de projet ou consultés ultérieurement, ce qui étend la portée de la conversation initiale au-delà du public visé.

Se pose également la question de l'accès au modèle. Les équipes veulent savoir si les données des réunions sont traitées dans des environnements isolés, si elles sont conservées après traitement et si elles sont jamais exposées à des systèmes autres que ceux qui servent directement à générer des notes.

Risques liés à l'utilisation secondaire et craintes liées à la formation des modèles

L'une des préoccupations les plus persistantes concernant les assistants de prise de notes IA est leur utilisation secondaire. Les équipes craignent que leurs conversations soient réutilisées à des fins autres que celles prévues, telles que l'amélioration des modèles, la formation de futurs systèmes ou la génération d'informations dépassant le cadre de la réunion initiale.

Ces craintes ne sont pas infondées. Dans l'écosystème plus large de l'IA, la réutilisation des données est courante et les messages des fournisseurs sont souvent vagues. Des déclarations telles que « nous n'utilisons pas vos données pour l'entraînement » peuvent masquer des détails importants concernant le traitement temporaire, l'anonymisation ou l'apprentissage agrégé.

Pour les organisations soucieuses de la confidentialité, la question clé est celle du contrôle. Elles veulent des réponses claires et vérifiables quant à savoir si les données issues des réunions contribuent à la formation des modèles sous quelque forme que ce soit, s'il existe des mécanismes de désinscription et comment ces engagements sont mis en œuvre sur le plan technique, et pas seulement contractuel.

Le risque lié à l'utilisation secondaire s'étend également en interne. Même si un fournisseur traite les données de manière responsable, les organisations doivent réfléchir à la manière dont les données enregistrées et traitées lors des réunions pourraient être réutilisées par leurs propres équipes d'une manière que les participants n'avaient pas prévue.

C'est pourquoi les preneurs de notes IA sont différents.

Ensemble, ces facteurs expliquent pourquoi les outils de prise de notes basés sur l'IA semblent particulièrement sensibles par rapport aux autres outils d'IA. Ils fonctionnent à partir de communications humaines non protégées, créent des enregistrements durables à partir d'échanges temporaires et superposent une interprétation aux données brutes.

Le risque pour la vie privée n'est pas inhérent à un acte répréhensible. Il s'agit plutôt d'une exposition. Comprendre cette distinction est la première étape pour évaluer ces outils de manière responsable, plutôt que de réagir par une acceptation ou un rejet catégorique.

Les véritables préoccupations des équipes, et pourquoi elles ne sont pas irrationnelles

Lorsque les équipes hésitent à utiliser des assistants de prise de notes basés sur l'IA, il est tentant d'interpréter cette résistance comme une peur du changement. Dans la pratique, les préoccupations soulevées par les gens sont spécifiques, contextuelles et souvent fondées sur leur expérience directe. Passez un peu de temps au sein de communautés de praticiens et vous verrez que les mêmes thèmes reviennent sans cesse, quels que soient les rôles ou les secteurs d'activité.

Réunions internes et sécurité psychologique

L'un des premiers points de tension autour des assistants de prise de notes IA apparaît lors des réunions internes, où les conversations sont exploratoires et souvent inachevées. Les équipes décrivent à plusieurs reprises un changement dès que l'enregistrement commence. Les gens ralentissent. Le langage se resserre. Les idées deviennent plus sûres avant de devenir meilleures.

Ce changement apparaît clairement dans une longue discussion sur Reddit concernant l'éthique des outils de prise de notes basés sur l'IA au travail. Dans ce fil de discussion, l'auteur du message initial décrit comment il a présenté un outil de prise de notes basé sur l'IA à son équipe et comment celui-ci a suscité plus de malaise que d'intérêt. Un collègue a demandé à être informé avant chaque réunion si un enregistrement était effectué, affirmant qu'il n'aimait pas du tout être enregistré, même s'il ne s'y opposait pas activement.

Les réponses montrent clairement que cette réaction est courante. Un commentateur a écrit : « Nous demandons TOUJOURS aux participants si nous pouvons les enregistrer avant toute réunion. C'est une question de professionnalisme élémentaire. » Un autre a déclaré : «Si je découvrais que vous m'aviez enregistré sans mon consentement, je vous signalerais aux ressources humaines. C'est une grave violation de la vie privée. »

Ce qui ressort de la discussion, c'est que très peu de personnes s'opposent à la prise de notes en soi. Les préoccupations portent principalement sur le caractère permanent et la perte de contrôle une fois que la parole a été enregistrée et traitée. Un utilisateur a expliqué : « Je ne veux pas que mes propos soient intégrés à une IA pour produire un « résumé », car je ne suis pas sûr qu'il soit exact. » Ce malaise s'explique par le risque que le contexte soit aplati et que l'intention soit mal interprétée.

Plusieurs commentateurs ont également décrit comment l'enregistrement modifie le comportement du groupe au fil du temps. Les gens ont déclaré se sentir à l'aise une fois l'enregistrement annoncé, mais se sont fermement opposés à l'enregistrement surprise, que beaucoup ont qualifié de malhonnête. D'autres ont exprimé leur inquiétude quant au fait que des outils tiers transfèrent les conversations internes en dehors des systèmes approuvés, un commentateur demandant si quelqu'un était vraiment à l'aise avec le fait que « toutes les discussions internes de l'entreprise » soient envoyées ailleurs.

Dans l'ensemble, ces réponses soulèvent la même question fondamentale. La sécurité psychologique dépend de la capacité des individus à s'exprimer librement, à changer d'avis et à s'exprimer de manière imparfaite. Lorsque les réunions sont systématiquement enregistrées, transcrites, attribuées et stockées, cette liberté s'amenuise. Les conversations deviennent plus prudentes et moins ouvertes, ce qui influence ce qui est dit et ce qui ne l'est jamais.

Les équipes participant à ces discussions décrivent moins d'idées provisoires et une participation plus prudente une fois que l'enregistrement devient une routine. Ce changement affecte la manière dont les problèmes sont explorés et dont les décisions sont prises, c'est pourquoi le malaise lié à l'enregistrement interne ne peut être considéré comme une simple réticence à adopter de nouveaux outils.

Appels clients et confiance externe

Les appels des clients et des consommateurs présentent un risque différent, car les personnes à l'autre bout du fil échappent au contrôle de l'organisation. Elles ne partagent pas les politiques internes, n'ont pas donné leur accord sur les choix d'outils internes et mentionnent souvent des informations sensibles dans la conversation sans savoir comment celles-ci pourraient être traitées.

Cet écart dans les attentes apparaît clairement dans une autre discussion sur Reddit sur les raisons pour lesquelles de nombreux professionnels évitent les outils de prise de notes. Un assistant de direction a décrit un scénario juridique dans lequel un client accepterait qu'un collègue junior participe à un appel, mais s'opposerait immédiatement à la présence d'un assistant de prise de notes IA. La conclusion était simple. Les gens sont plus à l'aise de faire confiance à une autre personne qu'à un système automatisé lorsque les enjeux sont personnels.

Ailleurs dans le fil de discussion, des commentateurs ont décrit des organisations qui suppriment ou bloquent activement les preneurs de notes IA lors des réunions, arguant que les conversations confidentielles dérivent souvent vers des sujets sensibles sans avertissement.

Le problème ici n'est pas l'enregistrement en soi, mais la perte de contrôle une fois que la conversation a pris fin. Les clients peuvent s'attendre à ce que des notes soient prises. Ils s'attendent rarement à ce que leurs propos soient stockés, consultables et traités par un système d'intelligence artificielle que d'autres personnes peuvent consulter ultérieurement.

Plusieurs participants ont fait remarquer que les conversations avec les clients ne se limitent pas strictement aux points inscrits à l'ordre du jour. Les appels courants peuvent rapidement dériver vers des sujets personnels, financiers ou juridiques, ce qui rend l'enregistrement systématique risqué.

C'est pourquoi de nombreuses organisations adoptent une approche prudente. Certaines limitent l'utilisation des assistants de prise de notes IA à un usage interne. D'autres exigent une autorisation explicite pour les appels externes. Quelques-unes les évitent complètement dans les situations en contact avec la clientèle, privilégiant la confiance à la commodité.

C'est pourquoi les appels externes restent l'un des contextes les plus sensibles pour les preneurs de notes IA. La question n'est pas celle de l'autorisation sur le papier. Il s'agit plutôt de savoir si l'outil répond aux attentes des personnes à l'autre bout du fil.

Conversations sur les ressources humaines, les questions juridiques et financières

Ce sentiment revient régulièrement lorsque des personnes travaillant avec des informations confidentielles évoquent les outils de transcription basés sur l'IA. Il reflète une limite pratique plutôt qu'une position philosophique. Dans les domaines des ressources humaines, du droit et de la finance, les réunions sont déjà considérées comme sensibles par défaut, et les petites incertitudes comportent des risques disproportionnés.

Dans ces contextes, les gens sont parfaitement conscients que les mots n'existent pas isolément. Le sens dépend du ton, du moment et de l'intention, et tout cela peut être perdu une fois que la parole est transformée en un enregistrement durable. Une conversation sur les performances, une discussion sur les licenciements ou une session sur la stratégie juridique changent de nature lorsqu'elles peuvent être recherchées et consultées ultérieurement par une personne qui n'était pas présente.

Les préoccupations liées à la réutilisation ajoutent à ce malaise. Les praticiens soulignent souvent que les politiques de confidentialité peuvent autoriser l'utilisation d'enregistrements audio ou de transcriptions à des fins autres que la création de notes, notamment pour la formation de modèles ou le partage au sein de systèmes plus larges. Même lorsque ces pratiques sont divulguées, la possibilité d'une utilisation secondaire semble incompatible avec des conversations qui supposent une confidentialité stricte.

Ces fonctions privilégient également fortement le maintien d'un contrôle étroit. Le traitement sur appareil est souvent considéré comme plus acceptable que les téléchargements vers le cloud, car il réduit l'incertitude quant à la destination des données et aux personnes susceptibles d'y accéder ultérieurement. Cette distinction est particulièrement importante lorsque le traitement des informations a des conséquences juridiques, financières ou professionnelles.

En conséquence, les équipes RH, juridiques et financières ont tendance à agir avec prudence. Elles s'appuient sur des notes manuscrites. Elles limitent les enregistrements. Elles évitent les outils qui transforment les discussions sensibles en artefacts durables. Ces décisions ne visent pas à résister au changement. Elles reflètent la compréhension du fait qu'une fois que certaines conversations sont enregistrées et traitées, leur divulgation ne peut plus être annulée.

Dans ces environnements, la retenue est une réponse rationnelle au poids que ces conversations revêtent.

Consentement et confiance des employés

L'une des préoccupations les plus vives concernant les assistants de prise de notes basés sur l'IA est de savoir si les employés ont réellement le choix d'être enregistrés et transcrits. Sur le papier, les entreprises traitent souvent cette question par le biais de politiques ou de notifications dans l'application. Dans la pratique, cela donne à beaucoup de gens le sentiment qu'ils n'ont que peu de contrôle réel sur la manière dont leurs propos sont enregistrés et utilisés.

Les professionnels de la protection de la vie privée et les commentateurs ont clairement souligné ce problème. Certains experts affirment que les outils d'enregistrement basés sur l'IA brouillent la frontière entre la notification passive et le consentement actif et éclairé, car les participants ne découvrent souvent qu'un outil les a enregistrés qu'après coup, lorsque l'enregistrement ou la transcription apparaît dans leurs dossiers ou que des discussions sur la conservation et la réutilisation ont lieu. Cela soulève des questions sur la liberté avec laquelle le consentement est donné et sur ce que les participants comprennent réellement de ce qu'il est advenu des données de leur réunion.

Un article récent sur les préoccupations relatives aux preneurs de notes IA expliquait que la simple présence d'un auditeur automatisé lors d'une réunion peut créer un sentiment d'être observé ou surveillé, ce qui modifie la façon dont les gens s'expriment et participent. Les employés peuvent se retrouver à filtrer leur langage, à éviter l'incertitude ou à retenir leurs contributions, car ils savent que leurs paroles sont enregistrées et stockées bien au-delà du moment où la conversation prend fin.

Ce problème apparaît dans les les conseils des professionnels de la confidentialité et de la protection des données qui soulignent que le consentement dans le cadre de réglementations telles que le RGPD doit être éclairé, spécifique et significatif. Par exemple, les organisations doivent informer les participants non seulement que l'audio sera enregistré, mais aussi quelles données seront capturées, où elles seront stockées, combien de temps elles seront conservées et qui y aura accès. Ces détails sont souvent noyés dans les invitations aux réunions ou les conditions d'utilisation des plateformes, plutôt que d'être clairement énoncés avant le début de l'enregistrement.

Enregistrement fantôme et outils non autorisés

L'un des aspects les plus gênants concernant les preneurs de notes utilisant l'IA est que les règles floues et les restrictions générales n'empêchent pas l'enregistrement. Elles changent simplement le lieu où cela se produit.

Souvent, lorsque les outils officiels semblent restrictifs ou mal expliqués, les gens cherchent des alternatives. Des comptes personnels, des extensions de navigateur, des applications locales et des outils conçus pour éviter la détection commencent à apparaître. Une débat sur la cybersécurité sur ce qu'on appellel'« IA fantôme »a décrit une organisation qui a découvert des centaines de comptes de prise de notes IA non autorisés fonctionnant sans approbation, visibilité ou surveillance. Ce comportement n'est pas surprenant. Les employés téléchargent souvent un outil de prise de notes quelques minutes avant un appel important, ou activent une fonctionnalité qui existe déjà dans les outils qu'ils utilisent quotidiennement, tels que Google Gemini Microsoft 365. L'enregistrement ne semble pas être une décision distincte lorsqu'il est intégré à un logiciel familier et présenté comme une commodité par défaut plutôt que comme un choix stratégique.

Il en résulte une fragmentation des risques. Les enregistrements se retrouvent dispersés dans des comptes personnels, des emplacements de stockage non gérés et des systèmes dont personne, au sein des services informatiques ou de sécurité, n'a la visibilité. Les règles de conservation sont incohérentes. L'accès n'est pas clair. Il devient impossible de suivre la réutilisation des données.

C'est pourquoi les interdictions générales ont tendance à se retourner contre leurs auteurs. Lorsque l'enregistrement est considéré comme quelque chose à réprimer plutôt qu'à réglementer, il ne disparaît pas. Il devient simplement plus difficile à détecter. Son utilisation non officielle génère davantage de visibilité que les outils qui sont ouvertement adoptés, clairement expliqués et compris par les personnes qui les utilisent.

L'enregistrement clandestin n'est pas un échec du jugement des employés. C'est un signe que l'écart entre la politique et la réalité quotidienne est devenu trop important.

Pourquoi ces préoccupations méritent d'être prises au sérieux

Dans l'ensemble, ces préoccupations ne sont ni irrationnelles ni hostiles à l'IA. Elles reflètent une vision lucide de la manière dont les assistants de prise de notes basés sur l'IA modifient le cycle de vie de la communication au travail d'une manière que les gens peuvent ressentir immédiatement.

Ce à quoi les gens réagissent, c'est la permanence, l'attribution, la possibilité de recherche et la réutilisation, ainsi que le changement dans le contrôle de ce qu'il advient de leurs propos une fois la réunion terminée. Ces réactions se situent à la croisée des émotions et des conséquences. Les conversations qui autrefois s'estompaient persistent désormais. Le contexte est mal transmis. La propriété semble floue.

Reconnaître que la réalité compte. Sans comprendre comment ces outils modifient les comportements et les attentes, il est facile de considérer le malaise comme de la résistance ou de se fier excessivement à des assurances qui semblent suffisantes sur le papier, mais qui s'avèrent insuffisantes dans la pratique.

Ce contexte est le point de départ de toute évaluation pertinente de la manière dont les preneurs de notes IA traitent la confidentialité.

La réglementation en matière de confidentialité concernant les assistants de prise de notes IA est souvent réduite à une simple formalité. Certaines équipes la considèrent comme une simple case à cocher. D'autres préfèrent l'éviter, sauf si le service juridique intervient. Aucune de ces deux approches ne reflète la manière dont ces règles s'appliquent une fois que l'enregistrement fait partie du travail quotidien.

Les cadres réglementaires tels que le RGPD sont importants ici, car les assistants IA traitent des conversations orales. Les gens parlent différemment de la façon dont ils écrivent. Ils se corrigent au milieu d'une phrase. Ils partagent des informations contextuelles qu'ils n'auraient peut-être jamais incluses dans un document. La réglementation devient pertinente précisément parce que ces moments sont capturés et conservés.

Questions à se poser lorsqu'on s'intéresse aux assistants de prise de notes basés sur l'IA

Il existe de nombreuses raisons pour lesquelles les gens doivent faire preuve de diligence raisonnable avant de se lancer dans le choix du bon outil de prise de notes IA pour leurs opérations commerciales. Voici quelques points à prendre en considération lors de ce choix.

1) Base légale, consentement et intérêt légitime

L'une des premières questions que se posent les équipes est de savoir si tous les participants à une réunion doivent donner leur accord pour être enregistrés. La réponse est rarement simple, ce qui est souvent à l'origine d'un certain malaise.

En vertu du RGPD, les organisations doivent disposer d'une base légale pour traiter les données à caractère personnel. Le consentement est une option. L'intérêt légitime en est une autre. De nombreux outils professionnels s'appuient sur l'intérêt légitime, en partant du principe que le traitement sert un objectif commercial raisonnable et ne prime pas sur les droits individuels.

Les preneurs de notes IA se situent à la limite de cette hypothèse. La plupart des gens s'attendent à ce que des notes soient prises. Peu d'entre eux s'attendent à ce que leurs mots exacts soient capturés et traités par un système automatisé. Cet écart entre les attentes et la réalité est important, même lorsque la base juridique est techniquement solide.

C'est pourquoi la divulgation revêt une telle importance. Lorsque le consentement n'est pas la base, les gens doivent tout de même comprendre ce qu'il advient de leurs données avant que cela ne se produise, et non après la publication d'une transcription.

Si quelqu'un participait à votre réunion en s'attendant à ce qu'il y ait des notes plutôt qu'un enregistrement permanent, aurait-il le sentiment d'avoir eu le choix ?

2) Minimisation des données dans un monde où tout est transcrit

La minimisation des données semble théorique jusqu'à ce qu'elle se heurte à un enregistrement de réunion.

L'idée en soi est simple. Les organisations devraient collecter et conserver uniquement ce dont elles ont besoin. Les preneurs de notes IA font souvent le contraire par défaut, capturant tout parce que c'est facile à faire et utile pour effectuer des recherches ultérieurement.

Cela ne rend pas ces outils incompatibles avec la réglementation. Cela signifie simplement que les équipes doivent décider de ce dont elles ont réellement besoin. Les enregistrements complets peuvent être utiles. Ils peuvent aussi être inutiles. Les transcriptions peuvent être précieuses pendant un certain temps. Elles n'ont peut-être pas besoin d'exister éternellement.

La minimisation concerne ici l'intention. Quel problème est résolu et quelle quantité de données est conservée pour le résoudre ?

Si un résumé suffit, pourquoi conserver l'intégralité de la conversation ?

3) Droits d'accès, de suppression et de contrôle

La réglementation cesse d'être abstraite lorsque quelqu'un demande à consulter ses données.

En vertu du RGPD, les personnes ont le droit d'accéder à leurs données personnelles et, dans de nombreux cas, de demander leur suppression. Lorsque les réunions sont enregistrées et transcrites, ces droits s'étendent aussi bien aux contributions orales qu'aux contributions écrites.

Cela entraîne de réelles exigences opérationnelles. Les équipes doivent savoir où se trouvent les enregistrements (de préférence dans un espace unique et unifié) et comment répondre aux demandes sans avoir à deviner. C'est là que les outils prennent toute leur importance. Les paramètres de conservation et les processus de suppression ne sont plus un simple plus, mais deviennent une nécessité.

Sans ces contrôles, même les équipes bien intentionnées peuvent se retrouver bloquées.

Si quelqu'un vous demandait de supprimer ses contributions lors des réunions précédentes, pourriez-vous le faire sans problème ?

4) Limitation des finalités et utilisation secondaire

La limitation des finalités concerne les limites.

En vertu du RGPD, les données à caractère personnel doivent être collectées pour une raison spécifique et explicite. Elles ne peuvent pas être utilisées ultérieurement à d'autres fins sans justification claire et sans transparence.

Avec les preneurs de notes IA, l'objectif déclaré est généralement simple. Capturer la réunion. Générer des notes. Faciliter la récupération des informations.

La question la plus difficile est de savoir ce qui va se passer ensuite.

L'enregistrement reste-t-il limité à cet objectif ou commence-t-il à servir d'autres fins ? Est-il analysé pour obtenir des informations sur les performances ? Est-il intégré à des systèmes d'analyse ? Est-il utilisé pour former des modèles ? Est-il partagé entre différents outils internes ?

Ces extensions ne sont pas automatiquement illégales. Elles doivent toutefois être clairement définies. Si l'objectif initial était la prise de notes, toute utilisation plus large doit être définie et communiquée dès le départ.

C'est là que la confiance peut s'éroder. Les gens peuvent accepter l'enregistrement à des fins de documentation. Ils peuvent toutefois avoir un avis différent si ces mêmes données servent à soutenir des analyses ou le développement de modèles sans rapport avec leur situation.

La limitation des finalités impose une discipline simple. Pourquoi ces données ont-elles été collectées, et sont-elles toujours utilisées à cette fin ?

Si le champ d'application a été élargi, cela a-t-il été clairement indiqué ?

Si les données dépassaient les attentes des participants, cette surprise serait-elle acceptable ?

Pourquoi les équipes centrées sur l'UE sont prudentes par nature

Les régulateurs européens ont adopté une position ferme sur la surveillance au travail et le déséquilibre des pouvoirs. Les assistants IA touchent à ces deux domaines à la fois, ce qui explique pourquoi les équipes centrées sur l'UE agissent souvent avec prudence.

Cette prudence se manifeste généralement très tôt. Les équipes réfléchissent à la conservation avant le déploiement. Elles s'informent sur l'accès avant d'activer l'enregistrement. Elles cherchent à se justifier plutôt que d'adapter les règles a posteriori.

Il s'agit d'une tentative visant à éviter les problèmes difficiles à résoudre une fois la confiance perdue.

Comment évaluer de manière responsable un assistant de prise de notes basé sur l'IA

Une fois que les équipes ont accepté que les outils de prise de notes basés sur l'IA soulèvent de réelles questions en matière de confidentialité et de sécurité, le défi suivant consiste à choisir celui qui convient avec soin. C'est là que de nombreuses évaluations achoppent, non pas parce que les gens se désengagent, mais parce qu'il devient difficile de savoir comment un outil se comporte une fois qu'il dépasse le stade de la démonstration et entre dans l'usage quotidien.

Une évaluation responsable se concentre sur les résultats plutôt que sur les garanties. L'objectif est de comprendre ce qu'il advient des données de réunion au fil du temps, dans différentes situations et lorsque des cas limites apparaissent.

1) Commencez par des questions qui décrivent un comportement.

Les premières évaluations se concentrent souvent sur la conformité d'un outil aux exigences réglementaires. C'est important, mais cela ne donne généralement qu'une vision partielle. Il est plus utile de comprendre comment le système fonctionne par défaut.

- Lieu de stockage des données relatives aux réunions, y compris les régions concernées

- Combien de temps les enregistrements et les transcriptions sont-ils conservés avant d'être supprimés ?

- Qui peut consulter les enregistrements, les transcriptions ou les résumés après une réunion ?

- Si l'accès change en fonction du rôle, de l'espace de travail ou de la propriété

- Que deviennent les données lorsqu'une personne quitte l'organisation ?

Les outils qui gèrent bien ces domaines permettent aux équipes d'expliquer plus facilement leur utilisation en interne et d'appliquer des règles cohérentes sans friction.

2) Consentement, divulgation et attentes

L'enregistrement fonctionne mieux lorsque les personnes comprennent ce qui se passe avant qu'il ne commence. L'évaluation doit examiner attentivement la manière dont les outils communiquent l'état de l'enregistrement lors des réunions réelles.

- Notification claire lorsque l'enregistrement commence

- Possibilité d'activer ou de désactiver l'enregistrement pour chaque réunion

- Gestion prévisible des retardataires

- Signaux visibles pour les participants externes, tels qu'un bot

Lorsque l'enregistrement est explicite et délibéré, les équipes sont plus à l'aise pour l'utiliser et moins enclines à créer des solutions de contournement.

3) Traitement par IA et utilisation de modèles

La manière dont les systèmes d'IA interagissent avec les données des réunions est un élément clé à prendre en compte lors de l'évaluation.

- Les données issues des réunions contribuent-elles à la formation des modèles ?

- Si le traitement est isolé par client

- Quelles données restent après la génération des résumés ?

- Si des modèles tiers sont impliqués

Les outils qui expliquent clairement ces flux et sont conçus pour l'isolation donnent aux équipes l'assurance que leurs données seront traitées de manière appropriée au-delà de la réunion immédiate.

4) Traitement par IA et utilisation de modèles

La manière dont les systèmes d'IA interagissent avec les données des réunions est un élément clé à prendre en compte lors de l'évaluation.

- Les données issues des réunions contribuent-elles à la formation des modèles ?

- Si le traitement est isolé par client

- Quelles données restent après la génération des résumés ?

- Si des modèles tiers sont impliqués

Les outils qui expliquent clairement ces flux et sont conçus pour l'isolation donnent aux équipes l'assurance que leurs données seront traitées de manière appropriée au-delà de la réunion immédiate.

5) Reconnaître les réponses incomplètes

Au cours des évaluations, certaines réponses indiquent la nécessité d'approfondir la discussion.

- Allégations générales de conformité sans explication

- Références à des certifications qui ne sont pas liées aux flux de travail d'enregistrement

- Déclarations relatives à la sécurité sans détails sur l'accès ou la conservation

- Forte dépendance à l'égard des politiques sans contrôles systémiques à l'appui

Les évaluations plus rigoureuses considèrent ces éléments comme des invitations à clarifier plutôt que comme des signaux d'alerte.

6) Évaluation de l'impact au sein de l'organisation

Une évaluation responsable implique également de réfléchir à l'utilisation interne.

- Comment l'enregistrement s'intègre dans la culture actuelle des réunions

- Qui décide quand l'enregistrement est approprié ?

- Quelles sont les instructions fournies aux utilisateurs avant l'utilisation de l'outil ?

- Comment les préoccupations ou les refus sont traités

Lorsque ces décisions sont prises tôt, les équipes sont plus enclines à utiliser l'outil ouvertement plutôt que de l'éviter discrètement.

Les réponses les plus convaincantes ont tendance à inclure

Les réponses les plus utiles se concentrent sur le comportement du produit dans des conditions normales d'utilisation plutôt que dans des cas extrêmes.

- Explication claire des paramètres par défaut

- Description simple de l'accès dans des scénarios quotidiens

- Reconnaissance honnête des limites ou des contraintes

- Documentation reflétant la manière dont l'outil est réellement utilisé

Ce genre de détail permet aux équipes de déployer les outils de manière responsable et de les prendre en charge au fil du temps.

À la recherche de preuves au-delà de la conversation

L'évaluation est plus pertinente lorsqu'elle va au-delà des conversations commerciales et s'appuie sur des preuves indépendantes de celles-ci.

Des centres de sécurité ou de confiance accessibles au public et régulièrement mis à jour, une documentation expliquant clairement le fonctionnement pratique de l'enregistrement et de la transcription, ainsi que des descriptions transparentes du transfert des données entre les systèmes font toute la différence. Des audits indépendants reflétant l'utilisation réelle plutôt que la conformité abstraite ajoutent encore plus de poids. La mise à disposition de ces documents permet aux équipes chargées de la sécurité, des questions juridiques et des opérations de s'aligner plus facilement dès le début et de soutenir un déploiement responsable au fil du temps.

Comment les fournisseurs responsables atténuent les risques liés à la confidentialité dans la pratique

Les fournisseurs responsables atténuent les risques liés à la confidentialité en prenant des décisions concrètes concernant leurs produits plutôt qu'en donnant de vagues assurances. Ces décisions se reflètent dans le fonctionnement de l'enregistrement, les personnes autorisées à accéder au contenu, la durée de conservation des données et la manière dont le traitement par l'IA est géré en arrière-plan.

L'un des domaines les plus visibles est l'enregistrement lui-même. Les outils responsables rendent l'enregistrement explicite plutôt que caché. Dans le cas tl;dv, les réunions sont enregistrées par un bot visible qui se joint à l'appel, rendant l'enregistrement apparent pour tous les participants. Les hôtes peuvent démarrer ou arrêter l'enregistrement, et celui-ci n'est pas conçu pour s'exécuter silencieusement en arrière-plan. Cela réduit le risque de surprise et favorise une participation éclairée dès le début.

L'accès au contenu enregistré est un autre domaine où la mise en œuvre est importante. tl;dv l'accès aux enregistrements et aux transcriptions au niveau de l'espace de travail plutôt que de rendre le contenu visible par défaut pour tous. Cela signifie que les enregistrements ne sont accessibles qu'aux personnes appartenant à l'espace de travail concerné et que leur partage en dehors de ce contexte est contrôlé. Cette approche limite la diffusion involontaire et aligne l'accès sur le contexte initial de la réunion.

La conservation et la suppression sont considérées comme des contrôles opérationnels plutôt que comme des cas particuliers. tl;dv aux équipes de gérer la durée de conservation des enregistrements et des transcriptions, et la suppression supprime les données de réunion sous-jacentes plutôt que de simplement les masquer. Les résumés et les résultats générés par l'IA suivent le même cycle de vie que le matériel source, ce qui permet un traitement prévisible dans le temps.

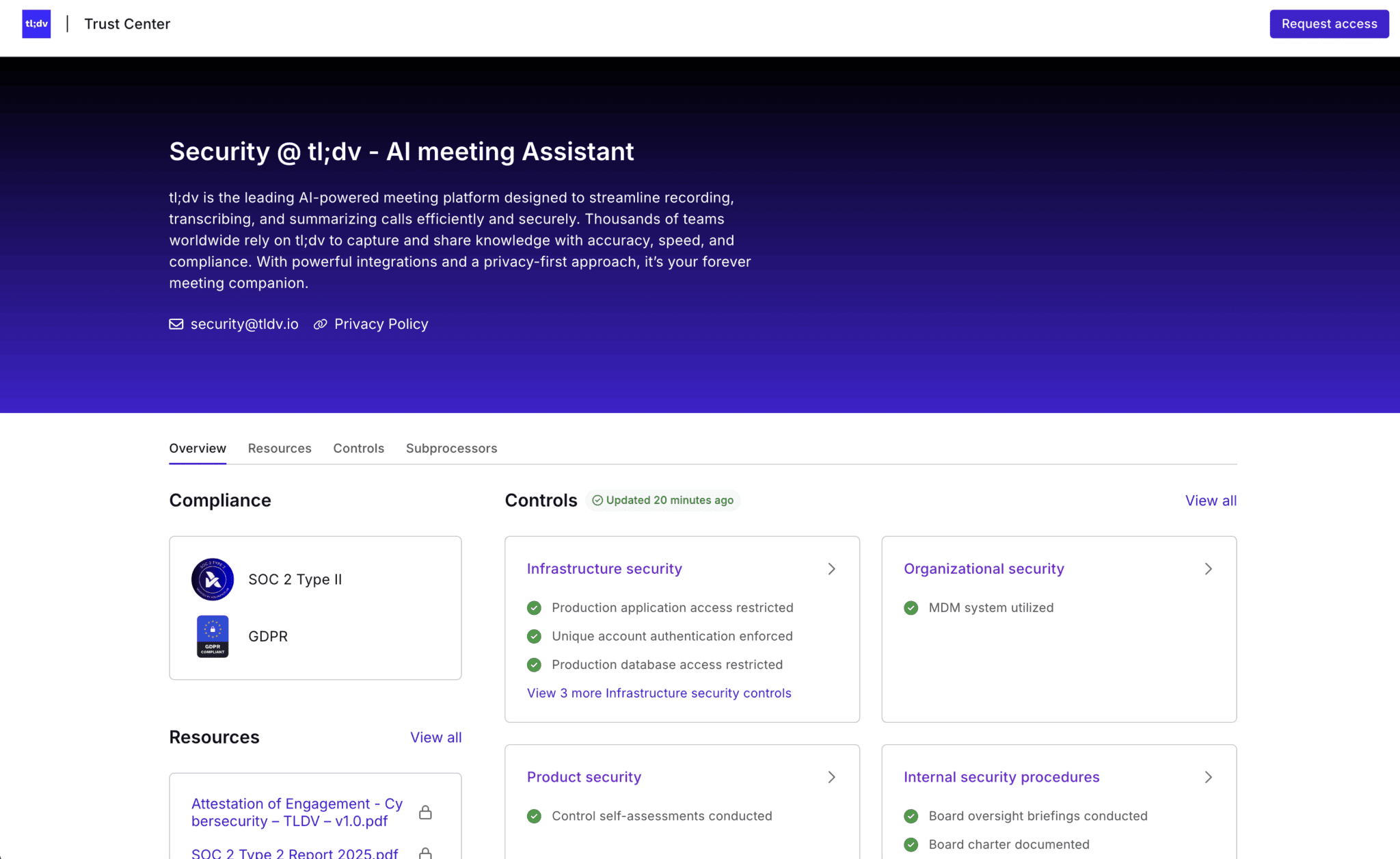

Les limites du traitement par l'IA sont explicitement documentées dans le Centre de confiance tl;dv.

Selon les documents publiés, les données issues des réunions avec les clients sont traitées uniquement dans le but de fournir des fonctionnalités telles que la transcription, les résumés et les analyses, et ne sont pas utilisées pour former des modèles d'IA plus généraux. Cette distinction aide les équipes à évaluer les risques liés à une utilisation secondaire, car elle établit une ligne claire quant à la manière dont les données sont traitées au-delà de la réunion immédiate. Le Centre de confiance comprend également des artefacts indépendants tels qu'une attestation SOC 2 de type II et un rapport de test de pénétration, ainsi que des détails sur les contrôles infrastructurels et organisationnels, montrant comment l'accès et le traitement sont régis dans le cadre des opérations quotidiennes.

L'emplacement où se trouvent ces informations est aussi important que leur contenu. tl;dv les engagements au niveau du système des comportements quotidiens. Son Centre de confiance documente la sécurité, le traitement des données et les pratiques de traitement à un niveau élevé, tandis que son Centre d'aide explique comment fonctionne l'enregistrement, comment l'accès est géré et comment les paramètres de conservation peuvent être appliqués dans la pratique. Cela permet aux équipes d'évaluer plus facilement la plateforme lors de l'achat et de comprendre son fonctionnement une fois qu'elle est utilisée.

Aucune de ces mesures n'élimine complètement le risque. Elles réduisent l'ambiguïté. Elles limitent l'exposition accidentelle. Elles favorisent une utilisation éclairée sans recourir à des solutions de contournement informelles.

Lorsque les fournisseurs documentent le fonctionnement de leurs systèmes, conçoivent leurs produits dans un souci de transparence et donnent aux équipes le contrôle sur l'accès et la conservation des données, la confidentialité fait partie intégrante du fonctionnement du produit plutôt que d'être ajoutée après coup. C'est ainsi que se traduit concrètement une atténuation responsable.

Choisir un assistant personnel intelligent sans prendre de risque

Les assistants de prise de notes IA occupent une place délicate. Ils promettent de soulager les tâches administratives, d'améliorer la mémorisation et de réduire les oublis, tout en touchant à la partie la plus humaine du travail, la conversation. Il est donc logique que les gens hésitent avant de laisser des outils écouter, mémoriser et résumer ce qu'ils disent au travail.

Cette hésitation reflète une compréhension instinctive du fait qu'une fois les conversations enregistrées et traitées, la donne change. Les mots ont une durée de vie plus longue. Le contexte dépasse le cadre initialement prévu. Ce qui semblait informel peut soudainement prendre un caractère permanent. Le contrôle commence à revêtir une importance qu'il n'avait pas auparavant.

Choisir de manière responsable ne signifie pas rejeter ces outils. Cela signifie prêter attention à leur comportement par défaut, à la clarté de leurs explications et à leur adéquation avec la réalité complexe des réunions réelles plutôt qu'avec celle, idéalisée, des réunions idéales. La visibilité l'emporte toujours sur l'invisibilité. Les paramètres par défaut sont plus importants que les cas particuliers. Une documentation claire est plus importante que les promesses rassurantes faites lors d'un appel commercial.

Cela permet également de faire la distinction entre essayer quelque chose et s'engager à le faire. De nombreuses équipes tirent profit de ces outils en les utilisant d'abord dans des contextes à faible risque, en observant comment fonctionnent l'enregistrement, l'accès et la conservation, puis en décidant ce qui leur semble acceptable avant de les déployer à plus grande échelle. Ce rythme respecte à la fois l'efficacité et les personnes dont les conversations sont enregistrées.

Lorsque les équipes souhaitent approfondir leurs recherches, le signal le plus fort est rarement une démonstration ou une conversation avec un commercial habile. Il s'agit plutôt des documents écrits laissés par le fournisseur. Les centres de confiance, les pages de sécurité et les articles d'aide montrent comment la confidentialité est gérée lorsque personne n'essaie de vous convaincre. Ils permettent de comprendre plus facilement ce qui est enregistré, qui peut le voir, combien de temps cela reste accessible et où s'arrête le traitement par l'IA.

Des fournisseurs tels que tl;dv publient ouvertement ces informations, établissant une distinction claire entre les engagements de haut niveau et les détails pratiques de l'utilisation quotidienne. Cela permet aux équipes de vérifier par elles-mêmes les affirmations, plutôt que de les accepter sur parole.

L'adoption de preneurs de notes IA ne devrait pas être considérée comme un acte de foi. En posant les bonnes questions, en fournissant une documentation claire et en faisant preuve d'une volonté d'agir de manière réfléchie, les équipes peuvent utiliser ces outils sans compromettre la confiance qui est à la base du bon fonctionnement des réunions.

FAQ sur l'IA et la confidentialité

À partir de 2026, les preneurs de notes IA seront-ils légaux au regard du RGPD ?

Oui, mais uniquement lorsqu'il existe une base légale claire pour le traitement, une divulgation appropriée avant l'enregistrement et des contrôles en place pour l'accès, la conservation et la suppression. Il ne suffit pas d'informer les participants après coup.

Les preneurs de notes IA utilisent-ils les données des réunions pour entraîner leurs modèles ?

Cela dépend du fournisseur. Certains outils indiquent que les données clients ne sont pas utilisées pour l'entraînement des modèles, tandis que d'autres peuvent s'appuyer sur des dispositions de traitement plus larges. Vérifiez toujours attentivement la documentation plutôt que de vous fier aux arguments marketing.

Les assistants de prise de notes IA devraient-ils être utilisés dans les réunions RH, juridiques ou financières ?

Ces contextes sont particulièrement sensibles, car les conversations portent souvent sur des informations confidentielles ou à fort impact. De nombreuses équipes limitent ou évitent l'enregistrement dans ces contextes, sauf en cas de nécessité clairement documentée et de contrôles rigoureux des données.

Que faut-il vérifier avant de choisir un assistant personnel intelligent ?

Vérifiez où les données sont stockées, combien de temps elles sont conservées, qui peut y accéder par défaut, si leur suppression entraîne la suppression complète des enregistrements et des transcriptions, comment fonctionne le traitement par IA et si le fournisseur fournit une documentation transparente en matière de sécurité et de confiance qui reflète l'utilisation réelle.