W 2026 r. sztuczna inteligencja wkroczyła do niektórych z najbardziej wrażliwych obszarów codziennej pracy. Spotkania, które kiedyś były zapisywane w notatnikach lub blakły w pamięci, są teraz rejestrowane, transkrybowane, podsumowywane i przechowywane, często automatycznie, często domyślnie i często bez zastanowienia się przez zespoły nad tym, co to oznacza dla prywatności. Dlatego rozmowy na temat sztucznej inteligencji i prywatności stały się tak burzliwe, zwłaszcza jeśli chodzi o programy do sporządzania notatek oparte na sztucznej inteligencji, które znajdują się na styku wygody i ryzyka.

Spędzam dużo czasu pisząc o tej przestrzeni i schemat jest zawsze ten sam. Zespoły nie są przeciwne sztucznej inteligencji. Są zajęte, przeciążone pracą i naprawdę wdzięczne za narzędzia, które odciążają je od codziennych obowiązków administracyjnych. Jednocześnie czują się niepewnie. Chcą wiedzieć, dokąd trafiają ich rozmowy, kto ma do nich dostęp, jak długo są przechowywane i czy nagrania te nie są potajemnie wykorzystywane w sposób, na który nie wyrazili zgody. Te obawy są uzasadnione.

W tym miejscu przyjrzymy się sztucznej inteligencji i prywatności z bardzo konkretnej perspektywy, czyli z punktu widzenia osób sporządzających notatki przy użyciu sztucznej inteligencji w 2026 roku. Nie będziemy zajmować się abstrakcyjną etyką i trudnymi do sprzedania koncepcjami. Skupimy się wyłącznie na rzeczywistych zagrożeniach związanych z tymi narzędziami, ich praktycznych przejawach oraz kwestiach, które zespoły powinny zrozumieć przed rozpoczęciem nagrywania i powierzeniem systemowi sztucznej inteligencji swoich rozmów.

Niezależnie od tego, czy obecnie korzystasz z notatnika AI, czy też nadal zastanawiasz się, jak wpłynie to na Twoją codzienną pracę, poniższe informacje dostarczą Ci solidnych wskazówek, które warto wziąć pod uwagę przy wyborze notatnika AI lub zmianie dostawcy.

TL;DR

Programy do sporządzania notatek oparte na sztucznej inteligencji pozwalają zaoszczędzić czas, ale zamieniają również nieformalne rozmowy na żywo w trwałe, możliwe do przeszukiwania zapisy, które stwarzają realne zagrożenie dla prywatności w zakresie zgody, przypisywania autorstwa, przechowywania, szkolenia modeli i wtórnego wykorzystania.

Zespoły mają rację, pytając, jak przechowywane są nagrania, kto ma do nich dostęp, jak długo są przechowywane i czy dane są ponownie wykorzystywane poza tworzeniem notatek.

Odpowiedzialne wdrożenie oznacza sprawdzenie podstawy prawnej, minimalizacji, praw do usuwania danych, zasad szkoleniowych i ustawień domyślnych, a następnie wybór dostawców, którzy zapewniają widoczność nagrań, ograniczają dostęp, jasno dokumentują przetwarzanie danych i dają zespołom rzeczywistą kontrolę nad przechowywaniem i usuwaniem danych.

Co sprawia, że programy do sporządzania notatek oparte na sztucznej inteligencji stanowią wyjątkowe zagrożenie dla prywatności?

Nie wszystkie narzędzia AI narażają prywatność w ten sam sposób. Asystent projektowy lub model analizy danych zazwyczaj przetwarza informacje, które użytkownicy decydują się wprowadzić świadomie i często po pewnym stopniu weryfikacji. Programy do sporządzania notatek oparte na sztucznej inteligencji działają inaczej. Przetwarzają one rozmowy na żywo, prowadzone w czasie rzeczywistym, często zawierające nieocenzurowane myśli, wrażliwe konteksty i informacje, które nigdy nie miały być zapisywane dosłownie.

Ta różnica ma znaczenie, ponieważ zmienia zarówno charakter przetwarzanych danych, jak i oczekiwania ludzi dotyczące kontroli, zgody i dalszego wykorzystania.

Nagrywanie rozmów na żywo

Pierwsza i najbardziej oczywista zmiana następuje w momencie nagrywania spotkania. Rozmowy na żywo nie są statycznymi dokumentami. Są płynne, kontekstowe i często mają charakter eksploracyjny. Ludzie mówią inaczej, gdy uważają, że rozmowa ma charakter tymczasowy. Spekulują, poprawiają się, testują pomysły i dzielą się informacjami, których nigdy nie zapisaliby na piśmie.

Kiedy sztuczna inteligencja rejestruje spotkanie, przekształca tę chwilową wymianę informacji w trwały artefakt. Stwarza to zagrożenie dla prywatności jeszcze przed rozpoczęciem przetwarzania przez sztuczną inteligencję. Nagranie rejestruje ton, intencje, komentarze na marginesie i momenty, które nigdy nie miały zostać zachowane poza salą. W wielu organizacjach właśnie tutaj zaczyna się dyskomfort, zwłaszcza gdy nagrania odbywają się automatycznie lub gdy uczestnicy nie są w pełni świadomi tego, co jest rejestrowane.

Istnieje również luka w zakresie zgody, którą zespoły często nie doceniają. Podczas spotkań rozproszonych lub międzyfirmowych nie wszyscy obecni mogą należeć do tej samej organizacji lub działać zgodnie z tymi samymi zasadami. Nagrywanie rozmowy na żywo rodzi pytania o to, kto wyraził zgodę na nagrywanie, w jaki sposób uzyskano tę zgodę i czy wytrzyma ona późniejszą kontrolę.

Transkrypcja i przypisanie mówcy

Transkrypcja stanowi dodatkowe źródło ryzyka, ponieważ przekształca mowę w tekst. Język mówiony jest chaotyczny. Zawiera przerwy, nakładające się wypowiedzi, nieudane początki i nieformalne sformułowania, które po zapisaniu mogą brzmieć zupełnie inaczej. Transkrypcja utrwala te momenty w sposób, który może wydawać się demaskujący, zwłaszcza gdy przypisuje się je konkretnym osobom.

Przypisanie wypowiedzi do konkretnych osób jeszcze bardziej zwiększa wrażliwość. Identyfikacja autorów wypowiedzi pozwala stworzyć przeszukiwalny rejestr indywidualnych wypowiedzi, opinii i oświadczeń. Podczas spotkań wewnętrznych może to wpływać na zaufanie, zwłaszcza gdy w grę wchodzą relacje władzy. Podczas spotkań zewnętrznych rodzi to pytania o to, czy klienci, partnerzy lub kandydaci oczekują, że ich wypowiedzi będą trwale przypisane do konkretnych osób i przechowywane.

W tym przypadku ważna jest dokładność, ale równie istotna jest interpretacja. Błędna atrybucja, częściowa transkrypcja lub utrata kontekstu mogą spowodować powstanie zapisów, które nie odzwierciedlają rzeczywistego znaczenia, a mimo to nadal istnieją jako dokumenty wyglądające na wiarygodne. Z punktu widzenia prywatności chodzi tu o ryzyko utraty reputacji i sprawiedliwość.

Przechowywanie, zatrzymywanie i możliwość wyszukiwania

Po nagraniu i transkrypcji spotkania trzeba je gdzieś przechowywać. Właśnie w kwestii przechowywania pojawia się wiele abstrakcyjnych obaw dotyczących prywatności. Zespoły często nie zdają sobie sprawy, jak długo przechowywane są nagrania, gdzie są one hostowane ani kto ma do nich domyślny dostęp.

Możliwość wyszukiwania zwiększa to ryzyko. Możliwość przeszukiwania danych z miesięcy lub lat spotkań jest bardzo przydatna, ale oznacza również, że poufne informacje mogą zostać ujawnione długo po tym, jak pierwotny kontekst stracił na znaczeniu. Przypadkowa uwaga wygłoszona podczas burzy mózgów może powrócić podczas audytów, sporów lub wewnętrznych przeglądów, w oderwaniu od warunków, w których została wypowiedziana.

Polityka przechowywania danych ma zatem kluczowe znaczenie, ale często jest pomijana. Nieograniczone przechowywanie danych wydaje się wygodne, ale z czasem zwiększa ryzyko. Im dłużej dane istnieją, tym większe jest prawdopodobieństwo, że zostaną wykorzystane, nadużyte lub naruszone. Zespoły dbające o prywatność coraz częściej pytają nie tylko o to, gdzie dane są przechowywane, ale także jak długo tam pozostają i jak łatwo można je usunąć.

Przetwarzanie AI, podsumowania, najważniejsze informacje i działania do podjęcia

Programy do sporządzania notatek oparte na sztucznej inteligencji oferują znacznie więcej niż tylko transkrypcję. Podsumowują dyskusje, wyodrębniają najważniejsze informacje, generują zadania do wykonania, a czasem wnioskują o intencjach lub priorytetach. Ten poziom przetwarzania wprowadza dodatkowe kwestie związane z prywatnością.

Podsumowania są interpretacjami. Kompresują one złożone rozmowy do uproszczonych narracji, które mogą zmieniać nacisk lub pomijać niuanse. Najważniejsze punkty i działania często ujawniają decyzje lub obowiązki, których uczestnicy nie sformułowali wprost w ten sposób. Chociaż są one przydatne, mogą tworzyć zapisy, które wydają się bardziej ostateczne niż rzeczywista rozmowa.

Z punktu widzenia prywatności niepokój budzi nie tylko fakt przetwarzania danych przez sztuczną inteligencję, ale także sposób wykorzystania i udostępniania wyników tego przetwarzania. Podsumowania są częściej przekazywane dalej, przechowywane w narzędziach projektowych lub wykorzystywane później, co powoduje, że zasięg pierwotnej rozmowy wykracza poza zamierzoną grupę odbiorców.

Istnieje również kwestia dostępu do modelu. Zespoły chcą wiedzieć, czy dane ze spotkań są przetwarzane w izolowanych środowiskach, czy są przechowywane po przetworzeniu i czy są kiedykolwiek udostępniane systemom wykraczającym poza bezpośrednie zadanie generowania notatek.

Ryzyko związane z wtórnym wykorzystaniem i obawy związane ze szkoleniem modeli

Jedną z najczęstszych obaw związanych z wykorzystaniem sztucznej inteligencji do sporządzania notatek jest ich wtórne wykorzystanie. Zespoły obawiają się, że ich rozmowy mogą zostać wykorzystane do celów, których nie zamierzały, takich jak ulepszanie modeli, szkolenie przyszłych systemów lub generowanie wniosków wykraczających poza zakres pierwotnego spotkania.

Obawy te nie są bezpodstawne. W szerszym ekosystemie sztucznej inteligencji ponowne wykorzystywanie danych jest powszechne, a komunikaty dostawców są często niejasne. Stwierdzenia typu „nie szkolimy się na podstawie Państwa danych” mogą ukrywać ważne szczegóły dotyczące tymczasowego przetwarzania, anonimizacji lub uczenia się zbiorczego.

Dla organizacji dbających o prywatność kluczową kwestią jest kontrola. Chcą one uzyskać jasne, weryfikowalne odpowiedzi na temat tego, czy dane ze spotkań przyczyniają się w jakikolwiek sposób do szkolenia modeli, czy istnieją mechanizmy rezygnacji oraz w jaki sposób zobowiązania te są egzekwowane pod względem technicznym, a nie tylko umownym.

Ryzyko związane z wtórnym wykorzystaniem danych rozciąga się również na obszar wewnętrzny. Nawet jeśli dostawca postępuje z danymi w sposób odpowiedzialny, organizacje muszą rozważyć, w jaki sposób zarejestrowane i przetworzone dane ze spotkań mogą zostać ponownie wykorzystane przez ich własne zespoły w sposób, którego uczestnicy nie przewidzieli.

Dlatego osoby sporządzające notatki przy pomocy sztucznej inteligencji odczuwają różnicę.

Wszystkie te czynniki razem wyjaśniają, dlaczego osoby sporządzające notatki przy użyciu sztucznej inteligencji są wyjątkowo wrażliwe w porównaniu z innymi narzędziami AI. Działają one w oparciu o niechronioną komunikację międzyludzką, tworzą trwałe zapisy tymczasowych wymian informacji i nakładają interpretację na surowe dane.

Ryzyko związane z prywatnością nie polega na samym naruszeniu prawa, ale na ujawnieniu danych. Zrozumienie tej różnicy jest pierwszym krokiem do odpowiedzialnej oceny tych narzędzi, zamiast reagowania ich całkowitą akceptacją lub całkowitym odrzuceniem.

Prawdziwe obawy zespołów i dlaczego nie są one irracjonalne

Kiedy zespoły mają wątpliwości co do osób sporządzających notatki przy użyciu sztucznej inteligencji, kuszące jest postrzeganie tego oporu jako strachu przed zmianą. W praktyce jednak obawy zgłaszane przez ludzi są konkretne, sytuacyjne i często oparte na bezpośrednich doświadczeniach. Spędzając czas w społecznościach praktyków, można zauważyć, że te same tematy powracają wielokrotnie, niezależnie od pełnionej funkcji czy branży.

Wewnętrzne spotkania i bezpieczeństwo psychologiczne

Jednym z pierwszych punktów napięcia związanych z osobami sporządzającymi notatki z wykorzystaniem sztucznej inteligencji są wewnętrzne spotkania, podczas których rozmowy mają charakter eksploracyjny i często pozostają niedokończone. Zespoły wielokrotnie opisują zmianę, jaka następuje po rozpoczęciu nagrywania. Ludzie zwalniają tempo. Język staje się bardziej ostrożny. Pomysły stają się bezpieczniejsze, zanim staną się lepsze.

Ta zmiana wyraźnie widać w długiej dyskusji na Reddicie na temat etyki narzędzi AI do sporządzania notatek w miejscu pracy. W wątku autor pierwotnego posta opisuje wprowadzenie narzędzia do sporządzania notatek opartego na sztucznej inteligencji do swojego zespołu i spotkało się to raczej z niechęcią niż zainteresowaniem. Jeden z kolegów poprosił, aby przed każdym spotkaniem informowano go o nagrywaniu, twierdząc, że nie lubi być nagrywany, nawet jeśli nie blokuje tego aktywnie.

Z odpowiedzi wynika jasno, że taka reakcja jest powszechna. Jeden z komentujących napisał: „Zawsze pytamy uczestników, czy możemy ich nagrywać przed każdym spotkaniem. To podstawowa profesjonalność”. Inny napisał: „Gdybym dowiedział się, że nagrywałeś mnie bez mojej zgody, zgłosiłbym to do działu kadr. To poważne naruszenie prywatności”.

W dyskusji wyraźnie widać, że bardzo niewiele osób sprzeciwia się samemu sporządzaniu notatek. Obawy dotyczą trwałości i utraty kontroli po zarejestrowaniu i przetworzeniu języka mówionego. Jeden z użytkowników wyjaśnił: „Nie chcę, aby moje słowa były wprowadzane do sztucznej inteligencji w celu stworzenia „podsumowania”, ponieważ nie ufam, że będzie ono dokładne”. Niepokój ten wynika z ryzyka spłaszczenia kontekstu i błędnej interpretacji intencji.

Kilku komentujących opisało również, w jaki sposób nagrywanie zmienia zachowania grupowe w miarę upływu czasu. Ludzie twierdzili, że czuli się komfortowo po ogłoszeniu nagrywania, ale zdecydowanie sprzeciwiali się nagrywaniu bez uprzedzenia, które wielu określiło jako nieuczciwe. Inni wyrazili obawy dotyczące narzędzi stron trzecich przenoszących wewnętrzne rozmowy poza zatwierdzone systemy, a jeden z komentujących zapytał, czy ktokolwiek naprawdę czuje się komfortowo, gdy „wszystkie wewnętrzne dyskusje firmy” są wysyłane gdzie indziej.

Podsumowując, odpowiedzi te wskazują na tę samą podstawową kwestię. Bezpieczeństwo psychologiczne zależy od tego, czy ludzie czują się swobodnie, aby głośno wyrażać swoje myśli, zmieniać swoje stanowisko i mówić niepoprawnie. Gdy spotkania są rutynowo nagrywane, transkrybowane, przypisywane i przechowywane, ta swoboda ulega ograniczeniu. Rozmowy stają się bardziej ostrożne i mniej otwarte, co wpływa na to, co się mówi, a czego nie.

Zespoły biorące udział w tych dyskusjach opisują mniej wstępnych pomysłów i bardziej ostrożne uczestnictwo, gdy nagrywanie staje się rutyną. Zmiana ta wpływa na sposób analizowania problemów i podejmowania decyzji, dlatego też nie można lekceważyć dyskomfortu związanego z wewnętrznym nagrywaniem jako zwykłej niechęci do stosowania nowych narzędzi.

Połączenia od klientów i zaufanie zewnętrzne

Rozmowy z klientami i kontrahentami wiążą się z innym rodzajem ryzyka, ponieważ osoby po drugiej stronie linii pozostają poza kontrolą organizacji. Nie znają one wewnętrznych zasad, nie wyraziły zgody na wybór wewnętrznych narzędzi i często ujawniają w rozmowie poufne informacje, nie wiedząc, w jaki sposób mogą one zostać wykorzystane.

Ta rozbieżność w oczekiwaniach wyraźnie widać w innej dyskusji na Reddicie na temat tego, dlaczego wielu profesjonalistów unika narzędzi do sporządzania notatek. Jeden z asystentów wykonawczych opisał sytuację prawną, w której klient akceptował udział młodszego kolegi w rozmowie telefonicznej, ale natychmiast sprzeciwiał się obecności sztucznej inteligencji sporządzającej notatki. Wniosek był prosty. Ludzie czują się bardziej komfortowo, ufając innej osobie niż zautomatyzowanemu systemowi, gdy stawka jest osobista.

W innych częściach wątku komentujący opisywali organizacje, które aktywnie usuwają lub całkowicie blokują dostęp do spotkań osobom sporządzającym notatki za pomocą sztucznej inteligencji, argumentując, że poufne rozmowy często bez ostrzeżenia schodzą na drażliwe tematy.

Nie chodzi tu o samo nagrywanie, ale o utratę kontroli po zakończeniu rozmowy. Klienci mogą oczekiwać notatek. Rzadko jednak spodziewają się, że ich słowa zostaną zapisane, będą możliwe do wyszukania i przetworzone przez system sztucznej inteligencji, do którego inni będą mieli później dostęp.

Kilku uczestników zauważyło, że rozmowy z klientami nie ograniczają się wyłącznie do spraw objętych agendą. Rutynowe rozmowy telefoniczne mogą szybko przejść w sferę spraw osobistych, finansowych lub prawnych, co sprawia, że nagrywanie wszystkich rozmów wydaje się ryzykowne.

Z tego powodu wiele organizacji przyjmuje ostrożne podejście. Niektóre ograniczają stosowanie notatników AI do użytku wewnętrznego. Inne wymagają wyraźnej zgody na rozmowy zewnętrzne. Kilka z nich całkowicie unika ich stosowania w kontaktach z klientami, przedkładając zaufanie nad wygodę.

Dlatego rozmowy zewnętrzne pozostają jednym z najbardziej wrażliwych kontekstów dla osób sporządzających notatki przy użyciu sztucznej inteligencji. Nie chodzi tu o zgodę na papierze. Chodzi o to, czy narzędzie spełnia oczekiwania osób po drugiej stronie linii.

Rozmowy dotyczące kadr, kwestii prawnych i finansowych

To przekonanie powraca wielokrotnie, gdy osoby pracujące z poufnymi informacjami rozmawiają o narzędziach do transkrypcji opartych na sztucznej inteligencji. Odzwierciedla ono raczej praktyczne ograniczenia niż filozoficzne stanowisko. W działach kadr, prawnym i finansowym spotkania są już domyślnie traktowane jako poufne, a nawet niewielka niepewność wiąże się z ogromnym ryzykiem.

W takich sytuacjach ludzie doskonale zdają sobie sprawę, że słowa nie istnieją w izolacji. Znaczenie zależy od tonu, czasu i intencji, a wszystko to może zostać utracone, gdy mowa zostanie przekształcona w trwały zapis. Rozmowa dotycząca wyników, dyskusja na temat zwolnień lub sesja poświęcona strategii prawnej zmienia charakter, gdy staje się dostępna do wyszukiwania i przeglądania przez osobę, która nie była obecna.

Obawy związane z ponownym wykorzystaniem potęgują ten niepokój. Praktycy często zwracają uwagę, że polityka prywatności może zezwalać na wykorzystanie nagrań audio lub transkrypcji do celów innych niż tworzenie notatek, w tym do szkolenia modeli lub udostępniania w ramach szerszych systemów. Nawet jeśli praktyki te są ujawniane, możliwość wtórnego wykorzystania wydaje się niezgodna z rozmowami, które zakładają ścisłą poufność.

W tych funkcjach istnieje również silna preferencja dla zachowania ścisłej kontroli. Przetwarzanie na urządzeniu jest często wymieniane jako bardziej akceptowalne niż przesyłanie danych do chmury, ponieważ zmniejsza niepewność co do tego, gdzie dane są przesyłane i kto może uzyskać do nich dostęp w późniejszym czasie. Różnica ta ma największe znaczenie w przypadkach, gdy sposób postępowania z informacjami wiąże się z konsekwencjami prawnymi, finansowymi lub zawodowymi.

W rezultacie zespoły HR, prawne i finansowe mają tendencję do zachowywania się konserwatywnie. Polegają na ręcznych notatkach. Ograniczają rejestrowanie. Unikają narzędzi, które zamieniają poufne rozmowy w długotrwałe artefakty. Decyzje te nie wynikają z oporu przed zmianami. Odzwierciedlają one zrozumienie, że po zarejestrowaniu i przetworzeniu pewnych rozmów nie można cofnąć ich ujawnienia.

W takich środowiskach powściągliwość jest racjonalną reakcją na wagę, jaką niosą ze sobą te rozmowy.

Zgoda i zaufanie pracowników

Jedną z najbardziej palących kwestii związanych z aplikacjami do sporządzania notatek opartymi na sztucznej inteligencji jest to, czy pracownicy mają rzeczywisty wybór w kwestii nagrywania i transkrypcji. Na papierze firmy często rozwiązują tę kwestię za pomocą zapisów w polityce lub powiadomień w aplikacji. W praktyce wiele osób ma jednak poczucie, że nie ma rzeczywistej kontroli nad tym, w jaki sposób ich słowa są rejestrowane i wykorzystywane.

Specjaliści ds. prywatności i komentatorzy wyraźnie zwrócili uwagę na tę kwestię. Niektórzy eksperci twierdzą, że osoby sporządzające notatki przy użyciu sztucznej inteligencji zacierają granicę między biernym powiadomieniem a aktywną, świadomą zgodą, ponieważ uczestnicy często dowiadują się o tym, że narzędzie ich nagrywało, dopiero po fakcie, gdy nagranie lub transkrypcja pojawiają się w ich aktach lub gdy pojawiają się dyskusje na temat przechowywania i ponownego wykorzystania danych. Rodzi to pytania o to, na ile zgoda jest udzielana dobrowolnie i co uczestnicy faktycznie rozumieją na temat tego, co stało się z danymi z ich spotkań.

W niedawnym artykule poświęconym obawom związanym z wykorzystaniem sztucznej inteligencji do sporządzania notatek wyjaśniono, że sama obecność automatycznego słuchacza podczas spotkania może wywoływać poczucie bycia obserwowanym lub monitorowanym, co zmienia sposób, w jaki ludzie się wypowiadają i uczestniczą w rozmowie. Pracownicy mogą zacząć filtrować swoje wypowiedzi, unikać niepewności lub powstrzymywać się od udziału w dyskusji, ponieważ wiedzą, że ich słowa są rejestrowane i przechowywane w sposób wykraczający daleko poza moment zakończenia rozmowy.

Kwestia ta pojawia się w wytycznych specjalistów ds. prywatności i ochrony danych , którzy podkreślają, że zgoda w ramach takich regulacji jak RODO musi być świadoma, konkretna i znacząca. Na przykład organizacje muszą poinformować uczestników nie tylko o tym, że nagrywany będzie dźwięk, ale także o tym, jakie dane będą rejestrowane, gdzie będą przechowywane, jak długo będą przechowywane i kto będzie miał do nich dostęp. Szczegóły te często są ukryte w zaproszeniach na spotkania lub warunkach korzystania z platformy, zamiast być jasno określone przed rozpoczęciem nagrywania.

Nagrywanie w tle i nieautoryzowane narzędzia

Jednym z bardziej niepokojących zjawisk związanych z osobami korzystającymi z notatników AI jest to, że niejasne zasady i ogólne ograniczenia nie powstrzymują ich przed nagrywaniem. Zmieniają jedynie miejsce, w którym to robią.

Często, gdy oficjalne narzędzia wydają się restrykcyjne lub są źle wyjaśnione, ludzie szukają alternatywnych rozwiązań. Pojawiają się wtedy konta osobiste, rozszerzenia przeglądarek, lokalne aplikacje i narzędzia zaprojektowane w celu uniknięcia wykrycia. Dyskusja na temat cyberbezpieczeństwa na temat tzw.„cieniowej sztucznej inteligencji”opisała organizację, która odkryła setki nieautoryzowanych kont notatników AI działających bez zgody, widoczności lub nadzoru. Takie zachowanie nie jest zaskakujące. Pracownicy często pobierają notatnik na kilka minut przed ważną rozmową lub aktywują funkcję, która już istnieje w narzędziach, z których korzystają na co dzień, takich jak Google Gemini Microsoft 365. Nagrywanie nie wydaje się odrębną decyzją, gdy jest wbudowane w znane oprogramowanie i przedstawiane jako domyślna wygoda, a nie wybór wynikający z polityki firmy.

W rezultacie powstaje fragmentaryczne ryzyko. Nagrania są rozproszone po kontach osobistych, niezarządzanych lokalizacjach przechowywania danych i systemach, do których nikt z działu IT ani bezpieczeństwa nie ma wglądu. Zasady przechowywania danych są niespójne. Dostęp do nich jest niejasny. Ponowne wykorzystanie danych staje się niemożliwe do śledzenia.

Właśnie dlatego całkowite zakazy przynoszą często odwrotny skutek. Gdy nagrywanie traktuje się jako coś, co należy tłumić, a nie regulować, nie znika ono. Staje się po prostu trudniejsze do zauważenia. Nieoficjalne wykorzystanie powoduje większą ekspozycję niż narzędzia, które są otwarcie stosowane, jasno wyjaśnione i zrozumiałe dla osób, które z nich korzystają.

Nagrywanie w ukryciu nie jest wynikiem błędnej oceny sytuacji przez pracownika. Jest to sygnał, że różnica między polityką firmy a codzienną rzeczywistością stała się zbyt duża.

Dlaczego te obawy zasługują na uwagę

Podsumowując, obawy te nie są ani irracjonalne, ani wrogie wobec sztucznej inteligencji. Odzwierciedlają one trzeźwe spojrzenie na to, jak osoby sporządzające notatki przy użyciu sztucznej inteligencji zmieniają cykl życia komunikacji w miejscu pracy w sposób, który ludzie mogą odczuć natychmiast.

Ludzie reagują na trwałość, przypisywanie autorstwa, możliwość wyszukiwania i ponownego wykorzystania, a także na zmianę w zakresie tego, kto kontroluje to, co dzieje się z ich słowami po zakończeniu spotkania. Reakcje te znajdują się na styku emocji i konsekwencji. Rozmowy, które kiedyś zanikały, teraz pozostają. Kontekst jest słabo przekazywany. Poczucie własności jest niejasne.

Uznanie znaczenia rzeczywistości. Bez zrozumienia, w jaki sposób narzędzia te zmieniają zachowania i oczekiwania, łatwo jest uznać dyskomfort za opór lub nadmiernie polegać na zapewnieniach, które brzmią wystarczająco dobrze na papierze, ale w praktyce okazują się niewystarczające.

Ten kontekst stanowi punkt wyjścia dla każdej sensownej oceny sposobu, w jaki osoby sporządzające notatki z wykorzystaniem sztucznej inteligencji podchodzą do kwestii prywatności.

Przepisy dotyczące prywatności w odniesieniu do urządzeń do sporządzania notatek opartych na sztucznej inteligencji są często sprowadzane do skrótów. Niektóre zespoły traktują je jako coś, co można załatwić za pomocą zaznaczenia pola wyboru. Inne uważają, że najlepiej unikać tego obszaru, chyba że zaangażuje się w to dział prawny. Żadne z tych podejść nie odzwierciedla tego, jak te zasady wyglądają w praktyce, gdy nagrywanie staje się częścią codziennej pracy.

Ramy prawne, takie jak RODO, mają tutaj znaczenie, ponieważ programy do sporządzania notatek oparte na sztucznej inteligencji mają do czynienia z rozmowami ustnymi. Ludzie mówią inaczej niż piszą. Poprawiają się w trakcie zdania. Dzielą się kontekstem, którego nigdy nie umieściliby w dokumencie. Regulacje stają się istotne właśnie dlatego, że te momenty są rejestrowane i przechowywane.

Kwestie, które należy wziąć pod uwagę przy rozważaniu zakupu urządzeń do sporządzania notatek opartych na sztucznej inteligencji

Istnieje wiele powodów, dla których przed wyborem odpowiedniego rozwiązania do sporządzania notatek opartego na sztucznej inteligencji dla swojej działalności gospodarczej należy przeprowadzić analizę due diligence. Oto kilka kwestii, które warto wziąć pod uwagę przy podejmowaniu tej decyzji.

1) Podstawa prawna, zgoda i uzasadniony interes

Jednym z pierwszych pytań, jakie zadają zespoły, jest to, czy wszyscy uczestnicy spotkania muszą wyrazić zgodę na nagrywanie. Odpowiedź rzadko jest prosta, co często powoduje niepokój.

Zgodnie z RODO organizacje potrzebują podstawy prawnej do przetwarzania danych osobowych. Jedną z opcji jest zgoda. Inną jest uzasadniony interes. Wiele narzędzi wykorzystywanych w miejscu pracy opiera się na uzasadnionym interesie, zakładając, że przetwarzanie danych służy rozsądnemu celowi biznesowemu i nie narusza praw osób fizycznych.

Osoby sporządzające notatki przy użyciu sztucznej inteligencji znajdują się na granicy tego założenia. Większość ludzi oczekuje, że notatki będą sporządzane. Mniej osób oczekuje, że ich dokładne słowa zostaną zarejestrowane i przetworzone przez zautomatyzowany system. Ta rozbieżność między oczekiwaniami a rzeczywistością ma znaczenie, nawet jeśli podstawa prawna jest technicznie poprawna.

Właśnie dlatego ujawnianie informacji ma tak duże znaczenie. Nawet jeśli zgoda nie stanowi podstawy, ludzie nadal muszą rozumieć, co dzieje się z ich danymi, zanim to nastąpi, a nie po pojawieniu się transkrypcji.

Jeśli ktoś dołączyłby do spotkania, oczekując notatek zamiast stałego zapisu, czy miałby poczucie, że otrzymał prawdziwy wybór?

2) Minimalizacja danych w świecie pełnych transkrypcji

Minimalizacja danych wydaje się teoretyczna, dopóki nie zderzy się z nagranym spotkaniem.

Sama idea jest prosta. Organizacje powinny gromadzić i przechowywać tylko to, czego potrzebują. Programy do sporządzania notatek oparte na sztucznej inteligencji często domyślnie postępują odwrotnie, rejestrując wszystko, ponieważ jest to łatwe i przydatne do późniejszego wyszukiwania.

Nie oznacza to, że narzędzia te są niezgodne z przepisami. Oznacza to jednak, że zespoły muszą zdecydować, czego faktycznie potrzebują. Pełne nagrania mogą być pomocne. Mogą też być zbędne. Transkrypcje mogą być przydatne przez pewien czas. Nie muszą jednak istnieć wiecznie.

Minimalizacja dotyczy tutaj intencji. Jaki problem jest rozwiązywany i ile danych jest przechowywanych, aby go rozwiązać?

Jeśli wystarczy streszczenie, po co zachowywać całą rozmowę?

3) Prawa dostępu, usuwania i kontroli

Przepisy przestają być abstrakcyjne, gdy ktoś prosi o wgląd do swoich danych.

Zgodnie z RODO osoby mają prawo dostępu do danych osobowych i w wielu przypadkach mogą zażądać ich usunięcia. W przypadku nagrywania i transkrypcji spotkań prawa te obejmują zarówno wypowiedzi ustne, jak i pisemne.

Wiąże się to z rzeczywistymi wymaganiami operacyjnymi. Zespoły muszą wiedzieć, gdzie znajdują się nagrania (najlepiej w jednej, ujednoliconej przestrzeni) i jak reagować na prośby bez zgadywania. Tutaj właśnie liczy się odpowiednie oprzyrządowanie. Ustawienia przechowywania i procesy usuwania przestają być miłym dodatkiem, a stają się koniecznością.

Bez tych kontroli nawet zespoły o dobrych intencjach mogą utknąć w martwym punkcie.

Gdyby ktoś poprosił Cię o usunięcie swoich wypowiedzi z poprzednich spotkań, czy byłbyś w stanie to zrobić bez śladu?

4) Ograniczenie celu i wykorzystanie wtórne

Ograniczenie celu dotyczy granic.

Zgodnie z RODO dane osobowe muszą być gromadzone w konkretnym, wyraźnym celu. Nie można ich później po cichu wykorzystywać do nowych celów bez jasnego uzasadnienia i przejrzystości.

W przypadku notatników AI cel jest zazwyczaj prosty. Rejestrowanie przebiegu spotkania. Tworzenie notatek. Ułatwianie wyszukiwania informacji.

Trudniejsze pytanie brzmi: co będzie dalej?

Czy nagranie pozostaje ograniczone do tego celu, czy też zaczyna służyć dodatkowym celom? Czy jest analizowane pod kątem wyników? Czy jest wprowadzane do systemów analitycznych? Czy jest wykorzystywane do szkolenia modeli? Czy jest udostępniane w szerszym zakresie narzędzi wewnętrznych?

Rozszerzenia te nie są automatycznie niezgodne z prawem. Wymagają jednak jasności. Jeśli pierwotnym celem było sporządzanie notatek, wszelkie szersze zastosowania muszą zostać zdefiniowane i przekazane na samym początku.

Właśnie w tym momencie może dojść do erozji zaufania. Ludzie mogą zaakceptować rejestrowanie danych w celach dokumentacyjnych. Mogą jednak zmienić zdanie, jeśli te same dane zostaną wykorzystane do przeprowadzenia niepowiązanej analizy lub opracowania modelu.

Ograniczenie celu wymusza prostą dyscyplinę. Dlaczego to zostało zebrane i czy nadal jest wykorzystywane w tym celu?

Jeśli zakres został rozszerzony, czy zostało to jasno określone?

Jeśli dane wykazały więcej niż oczekiwali uczestnicy, czy takie zaskoczenie byłoby do przyjęcia?

Dlaczego zespoły skupione na UE są z natury ostrożne?

Europejskie organy regulacyjne zajęły zdecydowane stanowisko w sprawie monitorowania miejsca pracy i nierównowagi sił. Systemy AI do sporządzania notatek dotyczą jednocześnie obu tych obszarów, co wyjaśnia, dlaczego zespoły skupione wokół UE często działają ostrożnie.

Ta ostrożność zazwyczaj pojawia się na wczesnym etapie. Zespoły zastanawiają się nad zachowaniem danych przed wdrożeniem. Pytają o dostęp przed włączeniem funkcji nagrywania. Szukają uzasadnienia, zamiast wprowadzać zasady z mocą wsteczną.

Jest to próba uniknięcia problemów, które trudno rozwiązać po utracie zaufania.

Jak odpowiedzialnie oceniać program do sporządzania notatek oparty na sztucznej inteligencji

Gdy zespoły zaakceptują fakt, że programy do sporządzania notatek oparte na sztucznej inteligencji budzą realne obawy dotyczące prywatności i bezpieczeństwa, kolejnym wyzwaniem staje się staranny wybór odpowiedniego rozwiązania. W tym momencie wiele ocen utknie w martwym punkcie, nie dlatego, że ludzie są niezainteresowani, ale dlatego, że trudno jest przewidzieć, jak narzędzie będzie się zachowywać po przejściu z fazy demonstracyjnej do codziennego użytku.

Odpowiedzialna ocena koncentruje się na wynikach, a nie na zapewnieniach. Celem jest zrozumienie, co dzieje się z danymi dotyczącymi spotkań w czasie, w różnych sytuacjach i gdy pojawiają się skrajne przypadki.

1) Zacznij od pytań opisujących zachowanie.

Wczesne oceny często koncentrują się na tym, czy narzędzie spełnia wymogi regulacyjne. Jest to ważne, ale rzadko oddaje pełny obraz sytuacji. Bardziej przydatne informacje można uzyskać, zrozumiejąc, jak system działa domyślnie.

- Miejsce przechowywania danych dotyczących spotkań, w tym regionów, których dotyczą

- Jak długo nagrania i transkrypcje są przechowywane przed usunięciem

- Kto może przeglądać nagrania, transkrypcje lub podsumowania po spotkaniu?

- Czy dostęp zmienia się w zależności od roli, obszaru roboczego lub własności?

- Co dzieje się z danymi, gdy ktoś opuszcza organizację?

Narzędzia, które dobrze radzą sobie w tych obszarach, ułatwiają zespołom wyjaśnianie sposobu użytkowania wewnątrz firmy i stosowanie spójnych zasad bez konfliktów.

2) Zgoda, ujawnianie informacji i oczekiwania

Nagrywanie działa najlepiej, gdy ludzie rozumieją, co się dzieje, zanim się rozpocznie. Ocena powinna dokładnie analizować sposób, w jaki narzędzia informują o statusie nagrywania podczas rzeczywistych spotkań.

- Wyraźne powiadomienie o rozpoczęciu nagrywania

- Możliwość włączania i wyłączania nagrywania dla poszczególnych spotkań

- Przewidywalne postępowanie w przypadku osób, które dołączyły do programu z opóźnieniem

- Widoczne sygnały dla uczestników zewnętrznych, takich jak bot

Gdy rejestrowanie jest jawne i celowe, zespoły chętniej z niego korzystają i rzadziej szukają sposobów na obejście tego wymogu.

3) Przetwarzanie AI i wykorzystanie modeli

Sposób interakcji systemów sztucznej inteligencji z danymi ze spotkań jest kluczowym obszarem zainteresowania podczas oceny.

- Czy dane ze spotkań przyczyniają się do szkolenia modelu?

- Czy przetwarzanie jest izolowane dla każdego klienta

- Jakie dane pozostają po wygenerowaniu podsumowań?

- Czy zaangażowane są modele stron trzecich

Narzędzia, które jasno wyjaśniają te przepływy i są zaprojektowane z myślą o izolacji, dają zespołom pewność co do sposobu przetwarzania ich danych poza bezpośrednim spotkaniem.

4) Przetwarzanie AI i wykorzystanie modeli

Sposób interakcji systemów sztucznej inteligencji z danymi ze spotkań jest kluczowym obszarem zainteresowania podczas oceny.

- Czy dane ze spotkań przyczyniają się do szkolenia modelu?

- Czy przetwarzanie jest izolowane dla każdego klienta

- Jakie dane pozostają po wygenerowaniu podsumowań?

- Czy zaangażowane są modele stron trzecich

Narzędzia, które jasno wyjaśniają te przepływy i są zaprojektowane z myślą o izolacji, dają zespołom pewność co do sposobu przetwarzania ich danych poza bezpośrednim spotkaniem.

5) Rozpoznawanie niekompletnych odpowiedzi

Podczas ocen niektóre odpowiedzi wskazują na potrzebę pogłębionej dyskusji.

- Ogólne twierdzenia dotyczące zgodności bez wyjaśnienia

- Odniesienia do certyfikatów, które nie są powiązane z procesami rejestrowania

- Oświadczenia dotyczące bezpieczeństwa bez szczegółowych informacji na temat dostępu lub przechowywania danych

- Duże uzależnienie od polityki bez wsparcia ze strony kontroli systemowych

W przypadku bardziej rygorystycznych ocen traktuje się je jako wskazówki do wyjaśnienia, a nie sygnały ostrzegawcze.

6) Ocena wpływu wewnątrz organizacji

Odpowiedzialna ocena obejmuje również rozważenie kwestii wykorzystania wewnętrznego.

- Jak nagrywanie wpisuje się w istniejącą kulturę spotkań

- Kto decyduje, kiedy nagrywanie jest właściwe?

- Jakie wskazówki otrzymują użytkownicy przed rozpoczęciem korzystania z narzędzia

- Jak traktowane są obawy lub rezygnacje

Kiedy decyzje te są podejmowane na wczesnym etapie, zespoły chętniej korzystają z narzędzia w sposób jawny, zamiast po cichu go unikać.

Co zazwyczaj zawierają mocniejsze odpowiedzi

Bardziej pomocne odpowiedzi skupiają się na tym, jak produkt zachowuje się podczas normalnego użytkowania, a nie w skrajnych przypadkach.

- Jasne wyjaśnienie ustawień domyślnych

- Prosty opis dostępu w codziennych sytuacjach

- Szczere uznanie ograniczeń lub przeszkód

- Dokumentacja odzwierciedlająca rzeczywiste wykorzystanie narzędzia

Tego rodzaju szczegóły ułatwiają zespołom odpowiedzialne wdrażanie narzędzi i zapewnianie im wsparcia w miarę upływu czasu.

Szukanie dowodów wykraczających poza rozmowę

Ocena jest bardziej miarodajna, gdy wykracza poza rozmowy sprzedażowe i uwzględnia dowody niezależne od nich.

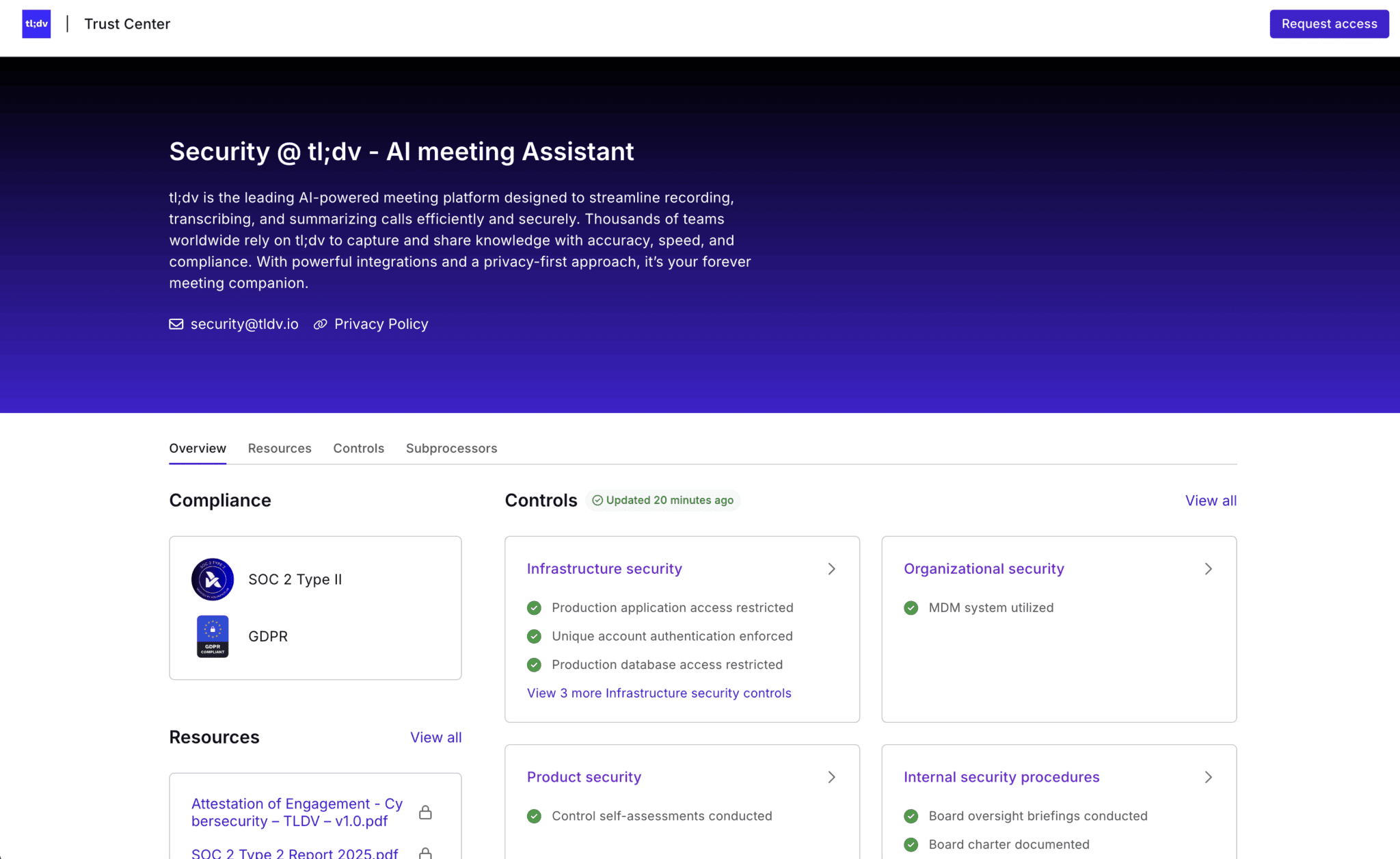

Publicznie dostępne centra bezpieczeństwa lub zaufania, które są na bieżąco aktualizowane, dokumentacja jasno wyjaśniająca, jak w praktyce działa rejestrowanie i transkrypcja, oraz przejrzyste opisy przepływu danych między systemami mają ogromne znaczenie. Niezależne audyty odzwierciedlające rzeczywiste wykorzystanie, a nie abstrakcyjną zgodność, mają dodatkowe znaczenie. Dostępność tych materiałów ułatwia zespołom ds. bezpieczeństwa, prawnym i operacyjnym wczesne dostosowanie się i wspieranie odpowiedzialnego wdrażania w miarę upływu czasu.

Jak odpowiedzialni dostawcy ograniczają ryzyko związane z prywatnością w praktyce

Odpowiedzialni dostawcy ograniczają ryzyko związane z prywatnością poprzez konkretne decyzje dotyczące produktów, a nie ogólne zapewnienia. Decyzje te dotyczą sposobu działania funkcji nagrywania, osób mających dostęp do treści, okresu przechowywania danych oraz sposobu przetwarzania danych przez sztuczną inteligencję.

Jednym z najbardziej widocznych obszarów jest samo nagrywanie. Odpowiedzialne narzędzia sprawiają, że nagrywanie jest jawne, a nie ukryte. W przypadku tl;dvspotkania są nagrywane za pomocą widocznego bota, który dołącza do rozmowy, dzięki czemu nagrywanie jest widoczne dla wszystkich uczestników. Gospodarze mogą rozpocząć lub zatrzymać nagrywanie, a nagrywanie nie jest zaprojektowane tak, aby działało cicho w tle. Zmniejsza to ryzyko zaskoczenia i od samego początku wspiera świadomy udział w spotkaniu.

Dostęp do nagranych treści to kolejny obszar, w którym wdrożenie ma znaczenie. tl;dv dostęp do nagrań i transkrypcji na poziomie obszaru roboczego, zamiast domyślnie udostępniać treści wszystkim użytkownikom. Oznacza to, że nagrania są dostępne tylko dla osób z odpowiedniego obszaru roboczego, a udostępnianie ich poza tym kontekstem jest kontrolowane. Takie podejście ogranicza niezamierzone rozpowszechnianie i dostosowuje dostęp do pierwotnego kontekstu spotkania.

Przechowywanie i usuwanie danych traktowane są jako środki kontroli operacyjnej, a nie jako przypadki skrajne. tl;dv zespołom zarządzać okresem dostępności nagrań i transkrypcji, a usunięcie powoduje całkowite zniknięcie danych dotyczących spotkania, a nie tylko ich ukrycie. Podsumowania i wyniki generowane przez sztuczną inteligencję mają taki sam cykl życia jak materiały źródłowe, co pozwala na przewidywalne zarządzanie nimi w czasie.

Granice przetwarzania AI są wyraźnie udokumentowane w Centrum zaufania tl;dv.

Zgodnie z opublikowanymi materiałami dane ze spotkań z klientami są przetwarzane wyłącznie w celu dostarczania funkcji takich jak transkrypcja, podsumowania i analizy i nie są wykorzystywane do szkolenia szerszych modeli sztucznej inteligencji. Rozróżnienie to pomaga zespołom ocenić ryzyko związane z wtórnym wykorzystaniem danych, ponieważ wyznacza jasną granicę w zakresie przetwarzania danych poza bezpośrednim spotkaniem. Centrum zaufania zawiera również niezależne artefakty, takie jak certyfikat SOC 2 typu II i raport z testów penetracyjnych, a także szczegółowe informacje na temat infrastruktury i kontroli organizacyjnych, pokazujące, w jaki sposób dostęp i przetwarzanie danych są regulowane w codziennej działalności.

Miejsce przechowywania tych informacji jest równie ważne jak sama treść. tl;dv zobowiązania na poziomie systemu od codziennych działań. Centrum zaufania dokumentuje kwestie bezpieczeństwa, przetwarzania danych i praktyki związane z ich przetwarzaniem na wysokim poziomie, natomiast centrum pomocy wyjaśnia, jak działa rejestrowanie, jak zarządzany jest dostęp i jak w praktyce można stosować ustawienia przechowywania. Ułatwia to zespołom ocenę platformy podczas procesu zakupowego i zrozumienie jej działania po wdrożeniu.

Żadne z tych środków nie eliminuje ryzyka całkowicie. Ograniczają one niejasności. Ograniczają przypadkowe narażenie. Wspierają świadome korzystanie bez konieczności stosowania nieformalnych rozwiązań zastępczych.

Kiedy dostawcy dokumentują działanie swoich systemów, projektują je z myślą o przejrzystości i zapewniają zespołom kontrolę nad dostępem i przechowywaniem danych, prywatność staje się częścią funkcjonowania produktu, a nie czymś dodanym po fakcie. Tak właśnie wygląda odpowiedzialne ograniczanie ryzyka w praktyce.

Wybór sztucznej inteligencji do sporządzania notatek bez ryzyka

Osoby sporządzające notatki przy pomocy sztucznej inteligencji znajdują się w niezręcznej sytuacji. Obiecują one ulgę w obowiązkach administracyjnych, lepsze zapamiętywanie i mniej pominiętych szczegółów, jednocześnie dotykając najbardziej ludzkiej części pracy, jaką jest rozmowa. Nic dziwnego, że ludzie wahają się, zanim pozwolą narzędziom słuchać, zapamiętywać i podsumowywać to, co mówią w pracy.

To wahanie odzwierciedla instynktowne zrozumienie, że po nagraniu i przetworzeniu rozmów sytuacja ulega zmianie. Słowa pozostają na dłużej. Kontekst rozprzestrzenia się dalej niż zamierzano. To, co wydawało się nieformalne, może nagle stać się trwałe. Kontrola zaczyna mieć znaczenie, jakiego wcześniej nie miała.

Odpowiedzialny wybór nie oznacza rezygnacji z tych narzędzi. Oznacza zwracanie uwagi na to, jak działają one domyślnie, jak jasno wyjaśniają swoje działanie i czy pasują do chaotycznej rzeczywistości prawdziwych spotkań, a nie tych idealizowanych. Widoczność zawsze wygrywa z niewidocznością. Ustawienia domyślne mają większe znaczenie niż skrajne przypadki. Jasna dokumentacja ma większe znaczenie niż zapewnienia podczas rozmowy handlowej.

Pomaga to również oddzielić wypróbowanie czegoś od podjęcia zobowiązania. Wiele zespołów czerpie korzyści z wykorzystania tych narzędzi najpierw w środowiskach o niskim ryzyku, sprawdzając, jak faktycznie działa nagrywanie, dostęp i przechowywanie, a następnie decydując, co jest akceptowalne, zanim wprowadzą je na szerszą skalę. Takie tempo działania szanuje zarówno wydajność, jak i osoby, których rozmowy są rejestrowane.

Kiedy zespoły chcą pogłębić swoją wiedzę, najsilniejszym sygnałem rzadko jest prezentacja lub rozmowa z elokwentnym przedstawicielem handlowym. Najważniejsze są pisemne informacje pozostawione przez dostawcę. Centra zaufania, strony dotyczące bezpieczeństwa i artykuły pomocy pokazują, w jaki sposób traktowana jest prywatność, gdy nikt nie próbuje nikogo przekonywać. Ułatwiają one zrozumienie, co jest rejestrowane, kto ma do tego dostęp, jak długo jest to przechowywane i gdzie kończy się przetwarzanie przez sztuczną inteligencję.

Sprzedawcy tacy jak tl;dv publikują te materiały otwarcie, wyraźnie oddzielając ogólne zobowiązania od praktycznych szczegółów codziennego użytkowania. Dzięki temu zespoły mają możliwość samodzielnego zweryfikowania tych informacji, zamiast polegać wyłącznie na zaufaniu.

Wprowadzenie notatników AI nie powinno być ryzykownym posunięciem. Dzięki odpowiednim pytaniom, przejrzystej dokumentacji i gotowości do podjęcia przemyślanych działań zespoły mogą korzystać z tych narzędzi bez podważania zaufania, które jest podstawą skutecznych spotkań.

Często zadawane pytania dotyczące sztucznej inteligencji i prywatności

Czy od 2026 r. notatki sporządzane przez sztuczną inteligencję będą zgodne z RODO?

Może tak być, ale tylko wtedy, gdy istnieje jasna podstawa prawna przetwarzania danych, odpowiednie ujawnienie przed rejestracją oraz kontrole dostępu, przechowywania i usuwania danych. Samo powiadomienie uczestników po fakcie nie wystarczy.

Czy programy do sporządzania notatek oparte na sztucznej inteligencji wykorzystują dane z spotkań do szkolenia swoich modeli?

To zależy od dostawcy. Niektóre narzędzia deklarują, że dane klientów nie są wykorzystywane do szkolenia modeli, podczas gdy inne mogą opierać się na szerszych ustaleniach dotyczących przetwarzania danych. Zawsze należy dokładnie sprawdzać dokumentację, zamiast polegać na deklaracjach marketingowych.

Czy notatki tworzone przez sztuczną inteligencję powinny być wykorzystywane podczas spotkań dotyczących kadr, kwestii prawnych lub finansowych?

Konteksty te charakteryzują się większą wrażliwością, ponieważ rozmowy często dotyczą informacji poufnych lub mających duże znaczenie. Wiele zespołów ogranicza lub unika nagrywania w takich sytuacjach, chyba że istnieje wyraźna, udokumentowana potrzeba i stosowane są rygorystyczne środki kontroli danych.

Co należy sprawdzić przed wyborem programu do sporządzania notatek opartego na sztucznej inteligencji?

Sprawdź, gdzie dane są przechowywane, jak długo są przechowywane, kto ma do nich domyślny dostęp, czy usunięcie powoduje całkowite zniknięcie nagrań i transkrypcji, jak działa przetwarzanie AI oraz czy dostawca zapewnia przejrzystą dokumentację dotyczącą bezpieczeństwa i zaufania, która odzwierciedla rzeczywiste wykorzystanie.