В 2026 году искусственный интеллект проник в некоторые из самых деликатных сфер повседневной работы. Встречи, которые раньше записывались в блокноты или оставались в памяти, теперь записываются, транскрибируются, резюмируются и хранятся, часто автоматически, часто по умолчанию и часто без того, чтобы команды полностью остановились и подумали о том, что это означает для конфиденциальности. Именно поэтому разговоры об ИИ и конфиденциальности стали такими насыщенными, особенно когда речь идет о системах записи ИИ, которые находятся на стыке удобства и риска.

Я уделяю много времени написанию статей об этой сфере, и картина всегда одна и та же. Команды не против искусственного интеллекта. Они заняты, перегружены работой и искренне благодарны за инструменты, которые избавляют их от административных задач. В то же время они испытывают беспокойство. Они хотят знать, куда попадают их разговоры, кто имеет к ним доступ, как долго они хранятся и не используются ли эти записи без их согласия. Эти опасения вполне обоснованы.

Здесь мы рассмотрим искусственный интеллект и конфиденциальность через призму конкретного примера — использования систем искусственного интеллекта для ведения записей в 2026 году. Речь не пойдет об абстрактной этике и сложных концепциях. Мы рассмотрим реальные риски, связанные с использованием этих инструментов, как эти риски проявляются на практике и что команды должны понимать, прежде чем нажать кнопку записи и довериться системе искусственного интеллекта в отношении своих разговоров.

Независимо от того, используете ли вы в настоящее время AI-ноутбук или все еще думаете о том, как он может повлиять на вашу повседневную работу, эта статья даст вам несколько полезных советов, которые стоит учитывать при выборе AI-ноутбука или переходе к другому поставщику.

TL;DR

Искусственный интеллект, записывающий беседы, экономит время, но также превращает живые, неформальные разговоры в постоянные записи с возможностью поиска, что создает реальные риски для конфиденциальности в отношении согласия, атрибуции, хранения, обучения моделей и вторичного использования.

Команды имеют право задавать вопросы о том, как хранятся записи, кто имеет к ним доступ, как долго они хранятся и используются ли данные после создания заметок.

Ответственное принятие означает проверку законных оснований, минимизацию, права на удаление, политики обучения и настройки по умолчанию, а затем выбор поставщиков, которые делают записи видимыми, ограничивают доступ, четко документируют обработку и предоставляют командам реальный контроль над хранением и удалением.

Что делает AI-конспекторов уникальным риском для конфиденциальности

Не все инструменты искусственного интеллекта создают одинаковую угрозу конфиденциальности. Помощник по дизайну или модель анализа данных обычно работает с информацией, которую пользователи сознательно вводят, часто после некоторой проверки. Искусственный интеллект, ведущий записи, отличается от этого. Он работает с живыми разговорами, произносимыми в режиме реального времени, часто содержащими нефильтрованные мысли, конфиденциальный контекст и информацию, которая никогда не была предназначена для дословного записывания.

Эта разница имеет значение, поскольку она меняет как характер обрабатываемых данных, так и ожидания людей в отношении контроля, согласия и последующего использования.

Запись живых разговоров

Первое и наиболее очевидное изменение происходит в момент записи встречи. Живые разговоры не являются статичными документами. Они изменчивы, контекстуальны и часто носят исследовательский характер. Люди говорят по-разному, когда считают, что разговор является временным. Они спекулируют, исправляют себя, проверяют идеи и делятся информацией, которую, возможно, никогда не изложили бы в письменной форме.

Когда искусственный интеллект записывает встречу, он превращает этот мимолетный обмен информацией в постоянный артефакт. Это создает риск для конфиденциальности еще до начала любой обработки искусственным интеллектом. Запись фиксирует тон, намерения, побочные комментарии и моменты, которые никогда не должны были сохраняться за пределами комнаты. Во многих организациях именно здесь начинается дискомфорт, особенно когда запись происходит автоматически или когда участники не полностью осознают, что именно записывается.

Существует также разрыв в согласии, который команды часто недооценивают. На распределенных или межкорпоративных совещаниях не все присутствующие могут принадлежать к одной и той же организации или действовать в соответствии с одними и теми же политиками. Запись живого разговора вызывает вопросы о том, кто согласился на запись, как было получено это согласие и выдержит ли оно тщательную проверку впоследствии.

Транскрипция и атрибуция говорящего

Транскрипция добавляет второй уровень риска, преобразуя речь в текст. Устная речь не всегда четкая. Она включает в себя прерывания, наложения, ложные старты и неформальные формулировки, которые могут читаться совсем по-другому, когда их записывают. Транскрипция запечатлевает эти моменты таким образом, что они могут показаться откровенными, особенно когда они приписываются конкретным говорящим.

Атрибуция выступающих еще больше повышает чувствительность. Идентификация того, кто что сказал, создает доступную для поиска запись индивидуальных вкладов, мнений и заявлений. На внутренних совещаниях это может повлиять на доверие, особенно когда речь идет о динамике власти. На внешних совещаниях это вызывает вопросы о том, ожидают ли клиенты, партнеры или кандидаты, что их слова будут навсегда зафиксированы и сохранены.

Здесь важна точность, но не менее важна и интерпретация. Неправильная атрибуция, неполная транскрипция или потеря контекста могут привести к созданию записей, которые не отражают фактический смысл, но при этом остаются документами, выглядящими авторитетными. С точки зрения конфиденциальности речь идет о риске для репутации и справедливости.

Хранение, сохранение и возможность поиска

После того как встреча записана и транскрибирована, она должна где-то храниться. Именно при хранении многие абстрактные вопросы конфиденциальности становятся конкретными. Команды часто не осознают, как долго хранятся записи, где они хранятся и кто по умолчанию имеет к ним доступ.

Возможность поиска усиливает этот риск. Возможность поиска по данным о встречах за несколько месяцев или лет — это мощный инструмент, но он также означает, что конфиденциальная информация может всплыть на поверхность спустя долгое время после того, как исчезнет ее первоначальный контекст. Случайное замечание, сделанное во время мозгового штурма, может всплыть во время аудитов, споров или внутренних проверок, в отрыве от условий, в которых оно было сказано.

Поэтому политика хранения данных имеет решающее значение, но часто упускается из виду. Неограниченное хранение кажется удобным, но со временем увеличивает риск утечки информации. Чем дольше данные хранятся, тем выше вероятность того, что к ним получат доступ, злоупотребят ими или нарушат их конфиденциальность. Команды, заботящиеся о конфиденциальности, все чаще задают вопросы не только о том, где хранятся данные, но и о том, как долго они там хранятся и насколько легко их можно удалить.

Обработка искусственным интеллектом, резюме, основные моменты и действия

Системы искусственного интеллекта для создания заметок предлагают гораздо больше, чем просто транскрипцию. Они резюмируют дискуссии, выделяют основные моменты, генерируют задачи и иногда делают выводы о намерениях или приоритетах. Этот уровень обработки требует дополнительных мер по обеспечению конфиденциальности.

Резюме – это интерпретации. Они сжимают сложные разговоры в упрощенные повествования, которые могут изменять акценты или опускать нюансы. Основные моменты и пункты для действий часто выявляют решения или обязанности, которые участники явно не формулировали таким образом. Несмотря на свою полезность, эти результаты могут создавать записи, которые кажутся более окончательными, чем был на самом деле разговор, лежащий в их основе.

С точки зрения конфиденциальности, проблема заключается не только в том, что ИИ обрабатывает данные, но и в том, как эти результаты используются и передаются. Резюме чаще всего пересылаются, хранятся в инструментах проекта или используются в качестве справочного материала в дальнейшем, что расширяет охват исходного разговора за пределы его целевой аудитории.

Также возникает вопрос о доступе к модели. Команды хотят понять, обрабатываются ли данные встреч в изолированных средах, сохраняются ли они после обработки и подвергаются ли они когда-либо воздействию систем, выходящих за рамки непосредственной задачи создания заметок.

Риск вторичного использования и опасения по поводу обучения модели

Одной из самых насущных проблем, связанных с использованием ИИ для ведения записей, является вторичное использование. Команды опасаются, что их разговоры могут быть использованы в целях, не предусмотренных ими, таких как улучшение моделей, обучение будущих систем или получение информации, выходящей за рамки первоначальной встречи.

Эти опасения не являются беспочвенными. В более широкой экосистеме ИИ повторное использование данных является обычной практикой, а сообщения поставщиков часто носят неопределенный характер. Такие заявления, как «мы не проводим обучение на ваших данных», могут скрывать важные детали о временной обработке, анонимизации или агрегированном обучении.

Для организаций, заботящихся о конфиденциальности, ключевым вопросом является контроль. Они хотят получить четкие и поддающиеся проверке ответы на вопросы о том, способствуют ли данные о встречах обучению моделей в какой-либо форме, существуют ли механизмы отказа от участия и как эти обязательства выполняются с технической точки зрения, а не только на договорной основе.

Риск вторичного использования также распространяется на внутренний уровень. Даже если поставщик ответственно обращается с данными, организации должны учитывать, что записанные и обработанные данные о встречах могут быть повторно использованы их собственными командами способами, которые участники не могли предвидеть.

Вот почему люди, делающие заметки с помощью ИИ, чувствуют себя по-другому

В совокупности эти факторы объясняют, почему программы для создания заметок на базе искусственного интеллекта вызывают особую чувствительность по сравнению с другими инструментами искусственного интеллекта. Они работают с незащищенной человеческой коммуникацией, создают долговечные записи на основе временных обменов и накладывают интерпретацию на необработанные данные.

Риск для конфиденциальности не заключается в самом по себе неправомерном действии. Он заключается в раскрытии информации. Понимание этого различия — первый шаг к ответственной оценке этих инструментов, а не к их безоговорочному принятию или полному отклонению.

Реальные опасения команд и почему они не являются иррациональными

Когда команды колеблются по поводу использования систем искусственного интеллекта для ведения записей, возникает соблазн объяснить это сопротивление страхом перед изменениями. На практике же опасения людей носят конкретный, ситуативный характер и часто основаны на непосредственном опыте. Проведите некоторое время в сообществах практиков, и вы увидите, что одни и те же темы повторяются снова и снова, независимо от должности или отрасли.

Внутренние встречи и психологическая безопасность

Один из первых моментов напряженности вокруг систем записи с помощью ИИ проявляется на внутренних совещаниях, где разговор носит исследовательский характер и часто остается незавершенным. Команды неоднократно описывают сдвиг, который происходит, когда в комнату входит записывающее устройство. Люди замедляются. Речь становится более сдержанной. Идеи становятся более безопасными, прежде чем они становятся лучше.

Это изменение ясно прослеживается в долгосрочной дискуссии на Reddit об этике использования инструментов искусственного интеллекта для ведения записей на работе. В этой ветке автор оригинального поста описывает, как он представил своему коллективу инструмент для создания заметок на базе ИИ и столкнулся с недовольством, а не интересом. Один из коллег попросил его сообщать перед каждым совещанием, будет ли вестись запись, заявив, что ему совсем не нравится, когда его записывают, даже если он не будет активно этому препятствовать.

Ответы ясно показывают, что такая реакция является обычным явлением. Один из комментаторов написал: «Мы ВСЕГДА спрашиваем участников, можно ли записывать их перед любой встречей. Это элементарный профессионализм». Другой сказал: «Если бы я узнал, что вы записали меня без моего согласия, я бы сообщил об этом в отдел кадров. Это серьезное нарушение конфиденциальности».

В ходе дискуссии стало очевидно, что очень немногие люди возражают против самого процесса записи заметок. Обеспокоенность вызывает постоянство и потеря контроля после того, как устная речь записывается и обрабатывается. Один пользователь объяснил: «Я не хочу, чтобы мои слова вводились в ИИ для создания «резюме», потому что я не верю, что оно будет точным». Это беспокойство связано с риском упрощения контекста и неправильного толкования намерения.

Несколько комментаторов также описали, как запись меняет поведение группы с течением времени. Люди сказали, что они чувствовали себя комфортно, когда о записи было объявлено заранее, но решительно выступали против неожиданной записи, которую многие описывали как нечестную. Другие выразили обеспокоенность по поводу того, что сторонние инструменты переносят внутренние разговоры за пределы утвержденных систем, а один комментатор спросил, действительно ли кто-то чувствует себя комфортно, когда «все внутренние дискуссии компании» отправляются в другое место.

В совокупности эти ответы указывают на одну и ту же основную проблему. Психологическая безопасность зависит от того, чувствуют ли люди себя способными высказывать свои мысли вслух, менять свою позицию и говорить неидеально. Когда встречи регулярно записываются, транскрибируются, атрибутируются и хранятся, эта свобода сужается. Разговоры становятся более осторожными и менее открытыми, что влияет на то, что говорится, а что никогда не говорится.

Команды, участвующие в этих обсуждениях, описывают меньшее количество предварительных идей и более осторожное участие, когда запись становится рутинной. Это изменение влияет на то, как исследуются проблемы и как принимаются решения, поэтому дискомфорт, связанный с внутренней записью, нельзя списать на простое нежелание применять новые инструменты.

Звонки клиентов и внешнее доверие

Звонки клиентов и заказчиков создают особый вид риска, поскольку люди на другом конце линии находятся вне контроля организации. Они не знакомы с внутренними политиками, не соглашались с выбором внутренних инструментов и часто привносят в разговор конфиденциальную информацию, не зная, как с ней будут обращаться.

Этот разрыв в ожиданиях ясно прослеживается в другой дискуссии на Reddit о том, почему многие профессионалы избегают инструментов для ведения заметок. Один исполнительный помощник описал юридическую ситуацию, в которой клиент согласился бы на участие в звонке младшего коллеги, но сразу же возразил бы против присутствия искусственного интеллекта, ведущего записи. Вывод был прост. Людям легче доверять другому человеку, чем автоматизированной системе, когда речь идет о личных интересах.

В других частях этой ветки комментаторы описывали организации, которые активно удаляют или полностью блокируют участие AI-стенографистов в совещаниях, аргументируя это тем, что конфиденциальные разговоры часто без предупреждения переходят в деликатную область.

Проблема здесь заключается не в самой записи, а в потере контроля, когда разговор выходит за пределы звонка. Клиенты могут ожидать, что их слова будут записаны. Они редко ожидают, что их слова будут сохранены, доступны для поиска и обработаны системой искусственного интеллекта, к которой другие могут вернуться позже.

Несколько участников отметили, что разговоры с клиентами не всегда строго соответствуют повестке дня. Рутинные звонки могут быстро перейти в личную, финансовую или юридическую плоскость, что делает запись всех разговоров рискованной.

Из-за этого многие организации придерживаются осторожного подхода. Некоторые ограничивают использование AI-конспекторов внутренним использованием. Другие требуют явного одобрения для внешних звонков. Некоторые полностью избегают их в условиях работы с клиентами, ставя доверие выше удобства.

Именно поэтому внешние звонки остаются одним из самых деликатных контекстов для систем искусственного интеллекта, ведущих записи. Проблема не в разрешении на бумаге. Проблема в том, соответствует ли инструмент ожиданиям людей на другом конце линии.

Беседы по вопросам кадровой, юридической и финансовой деятельности

Это мнение неоднократно звучит, когда люди, работающие с конфиденциальной информацией, говорят об инструментах транскрипции на базе искусственного интеллекта. Оно отражает скорее практические ограничения, чем философскую позицию. В сфере управления персоналом, юриспруденции и финансов встречи по умолчанию считаются конфиденциальными, и даже небольшие неопределенности несут в себе чрезмерный риск.

В таких ситуациях люди хорошо понимают, что слова не существуют изолированно. Значение зависит от интонации, времени и намерения, и все это может быть утрачено, когда речь превращается в долговечную запись. Разговор о результатах работы, обсуждение увольнения или сессия по разработке юридической стратегии меняют свой характер, когда их можно найти и просмотреть позже человеку, который не был присутствующим.

Обеспокоенность по поводу повторного использования усугубляет это беспокойство. Специалисты часто отмечают, что политика конфиденциальности может разрешать использование аудиозаписей или стенограмм в целях, выходящих за рамки создания заметок, включая обучение моделей или обмен данными в более широких системах. Даже когда такие практики раскрываются, возможность вторичного использования кажется несовместимой с разговорами, предполагающими строгую конфиденциальность.

В этих функциях также наблюдается явное предпочтение к сохранению контроля на ближнем расстоянии. Обработка на устройстве часто упоминается как более приемлемая, чем загрузка в облако, поскольку она снижает неопределенность относительно того, куда передаются данные и кто может получить к ним доступ впоследствии. Это различие имеет наибольшее значение в тех случаях, когда обработка информации влечет за собой юридические, финансовые или трудовые последствия.

В результате, отделы кадров, юридические и финансовые службы склонны действовать консервативно. Они полагаются на рукописные записи. Они ограничивают запись. Они избегают инструментов, которые превращают деликатные дискуссии в долговечные артефакты. Эти решения не связаны с сопротивлением изменениям. Они отражают понимание того, что после того, как определенные разговоры зафиксированы и обработаны, их раскрытие нельзя отменить.

В таких условиях сдержанность является рациональной реакцией на важность этих разговоров.

Согласие и доверие сотрудников

Одной из самых острых проблем, связанных с использованием систем искусственного интеллекта для записи и транскрибирования разговоров, является вопрос о том, действительно ли у сотрудников есть выбор в отношении записи и транскрибирования. На бумаге компании часто решают эту проблему с помощью политики или уведомлений в приложениях. На практике это приводит к тому, что многие люди чувствуют, что у них практически нет реального контроля над тем, как их слова записываются и используются.

Специалисты по вопросам конфиденциальности и комментаторы четко обозначили эту проблему. Некоторые эксперты утверждают, что системы искусственного интеллекта для ведения записей стирают грань между пассивным уведомлением и активным информированным согласием, поскольку участники часто узнают о том, что их записывали, только после того, как запись или стенограмма появляются в их файлах или возникают дискуссии о хранении и повторном использовании. Это вызывает вопросы о том, насколько свободно дается согласие и что участники на самом деле понимают о том, что произошло с данными их встреч.

В недавней статье, посвященной опасениям по поводу использования систем искусственного интеллекта для ведения записей, объясняется, что само присутствие автоматического слушателя на собрании может создать ощущение, что за вами наблюдают или следят, что меняет манеру речи и участие людей. Сотрудники могут начать фильтровать свою речь, избегать неопределенности или сдерживать свои высказывания, потому что знают, что их слова записываются и хранятся гораздо дольше, чем длится разговор.

Эта проблема отражена в руководствах специалистов по конфиденциальности и защите данных , которые подчеркивают, что согласие в рамках таких систем, как GDPR, должно быть информированным, конкретным и значимым. Например, организации должны сообщать участникам не только о том, что будет производиться аудиозапись, но и о том, какие данные будут собираться, где они будут храниться, как долго они будут храниться и кто будет иметь к ним доступ. Эти детали часто затеряны в приглашениях на встречи или условиях использования платформы, а не прописаны перед началом записи.

Запись в фоновом режиме и несанкционированные инструменты

Одной из наиболее неприятных тенденций, наблюдаемых в связи с использованием систем искусственного интеллекта для ведения записей, является то, что неясные правила и общие ограничения не останавливают запись. Они лишь меняют место, где она происходит.

Часто, когда официальные инструменты кажутся ограничивающими или плохо объясненными, люди ищут альтернативы. Появляются личные учетные записи, расширения для браузеров, локальные приложения и инструменты, предназначенные для избежания обнаружения. Обсуждение кибербезопасности так называемой«теневой ИИ»описывается организация, обнаружившая сотни несанкционированных учетных записей для ведения записей с помощью ИИ, которые работали без одобрения, видимости или контроля. Такое поведение неудивительно. Сотрудники часто загружают приложение для записи заметок за несколько минут до важного звонка или активируют функции, которые уже существуют в инструментах, которые они используют каждый день, таких как Google Gemini Microsoft 365. Запись не воспринимается как отдельное решение, когда она встроена в знакомое программное обеспечение и представлена как удобство по умолчанию, а не как выбор политики.

Результатом является фрагментированный риск. Записи в конечном итоге распределяются по личным учетным записям, неуправляемым местам хранения и системам, которые не видны никому из ИТ-отдела или службы безопасности. Правила хранения данных несогласованны. Доступ к данным неясен. Повторное использование данных становится невозможным отследить.

Вот почему полные запреты, как правило, приводят к обратному результату. Когда запись рассматривается как нечто, что нужно подавлять, а не регулировать, она не исчезает. Она становится менее заметной. Неофициальное использование создает больше рисков, чем инструменты, которые открыто принимаются, четко объясняются и понимаются людьми, которые их используют.

Запись в тени не является провалом в суждениях сотрудника. Это сигнал о том, что разрыв между политикой и повседневной реальностью стал слишком большим.

Почему эти опасения заслуживают внимания

В совокупности эти опасения не являются ни иррациональными, ни враждебными по отношению к ИИ. Они отражают трезвое видение того, как системы ИИ для создания заметок меняют жизненный цикл коммуникации на рабочем месте таким образом, что люди могут почувствовать это сразу.

Люди реагируют на постоянство, атрибуцию, возможность поиска и повторного использования, а также на изменение того, кто контролирует, что происходит с их словами после окончания встречи. Эти реакции находятся на стыке эмоций и последствий. Разговоры, которые раньше исчезали, теперь сохраняются. Контекст плохо передается. Право собственности становится размытым.

Признание важности реальности. Не понимая, как эти инструменты меняют поведение и ожидания, легко списать дискомфорт на сопротивление или чрезмерно полагаться на заверения, которые выглядят убедительно на бумаге, но не оправдывают себя на практике.

Этот контекст является отправной точкой для любой значимой оценки того, как программы для создания заметок на базе ИИ обрабатывают конфиденциальную информацию.

Регулирование конфиденциальности в отношении систем искусственного интеллекта для ведения записей часто сводится к краткому описанию. Некоторые команды рассматривают его как нечто, с чем можно справиться с помощью флажка. Другие считают, что лучше избегать этой темы, если только в дело не вмешивается юридический отдел. Ни один из этих подходов не отражает того, как эти правила проявляются, когда запись становится частью повседневной работы.

Такие рамки, как GDPR, имеют здесь значение, потому что системы искусственного интеллекта, ведущие записи, имеют дело с устной речью. Люди говорят иначе, чем пишут. Они исправляют себя в середине предложения. Они делятся контекстом, который, возможно, никогда не включили бы в документ. Регулирование становится актуальным именно потому, что эти моменты фиксируются и сохраняются.

Вопросы, которые следует учитывать при рассмотрении систем искусственного интеллекта для ведения записей

Есть много причин, по которым людям необходимо проявить должную осмотрительность, прежде чем выбрать подходящий для их бизнеса AI-ноутбук. Вот лишь несколько моментов, которые следует учитывать при выборе.

1) Правовая основа, согласие и законный интерес

Один из первых вопросов, который задают команды, – нужно ли всем участникам встречи дать согласие на запись. Ответ редко бывает простым, и именно в этом часто заключается источник неудобства.

В соответствии с GDPR, организациям необходимо иметь законное основание для обработки персональных данных. Одним из вариантов является согласие. Другим вариантом является законный интерес. Многие инструменты для работы полагаются на законный интерес, исходя из предположения, что обработка данных поддерживает разумные бизнес-цели и не нарушает права личности.

Искусственный интеллект, занимающийся ведением записей, находится на грани этого предположения. Большинство людей ожидают, что записи будут вестись. Меньшее количество людей ожидают, что их точные слова будут зафиксированы и обработаны автоматизированной системой. Этот разрыв между ожиданиями и реальностью имеет значение, даже если правовая основа технически обоснована.

Вот почему раскрытие информации имеет такое большое значение. Когда согласие не является основой, люди все равно должны понимать, что происходит с их данными, до того, как это произойдет, а не после появления транскрипта.

Если бы кто-то присоединился к вашему собранию, ожидая заметок, а не постоянной записи, почувствовал бы он, что ему был предоставлен реальный выбор?

2) Минимизация данных в мире полных стенограмм

Минимизация данных звучит теоретично, пока не сталкивается с записанным совещанием.

Сама по себе идея проста. Организации должны собирать и хранить только то, что им нужно. Искусственный интеллект по умолчанию часто поступает наоборот, фиксируя все, потому что это легко сделать и полезно для последующего поиска.

Это не означает, что эти инструменты несовместимы с нормативными требованиями. Это означает, что команды должны решить, что им действительно нужно. Полные записи могут быть полезны. Они также могут быть ненужными. Стенограммы могут быть ценными в течение определенного времени. Возможно, нет необходимости хранить их вечно.

Минимизация здесь касается намерения. Какая проблема решается и какой объем данных хранится для ее решения?

Если краткое изложение удовлетворяет потребности, зачем хранить весь разговор?

3) Права доступа, удаления и контроля

Регулирование перестает казаться абстрактным, когда кто-то просит предоставить ему свои данные.

В соответствии с GDPR люди имеют право на доступ к своим персональным данным и, во многих случаях, могут потребовать их удаления. Когда встречи записываются и транскрибируются, эти права распространяются как на устные, так и на письменные высказывания.

Это создает реальные операционные требования. Команды должны знать, где хранятся записи (желательно в одном едином месте) и как реагировать на запросы без догадок. Именно здесь важна роль инструментов. Настройки хранения и процессы удаления перестают быть просто приятным дополнением и становятся необходимостью.

Без этих мер контроля даже команды с благими намерениями могут оказаться в тупике.

Если бы кто-то попросил вас удалить свои выступления с прошлых заседаний, смогли бы вы сделать это без проблем?

4) Ограничение цели и вторичное использование

Ограничение цели касается границ.

Согласно GDPR, персональные данные должны собираться по конкретной, явно выраженной причине. Позже их нельзя незаметно расширять для новых целей без четкого обоснования и прозрачности.

В случае с AI-конспекторами заявленная цель обычно проста. Зафиксировать ход встречи. Составить конспект. Упростить поиск информации.

Более сложный вопрос заключается в том, что будет дальше.

Запись остается ограниченной этой целью или начинает служить дополнительным целям? Анализируется ли она для получения информации о производительности? Вводится ли в аналитические системы? Используется ли для обучения моделей? Распространяется ли через более широкие внутренние инструменты?

Эти расширения не являются автоматически незаконными. Однако они требуют ясности. Если первоначальной целью было ведение заметок, любое более широкое использование должно быть определено и сообщено с самого начала.

Именно здесь доверие может быть подорвано. Люди могут согласиться на запись для документирования. Но они могут по-другому отреагировать, если те же данные будут использоваться для несвязанного анализа или разработки моделей.

Ограничение цели вынуждает соблюдать простую дисциплину. Почему это было собрано и используется ли оно по-прежнему для этой цели?

Если сфера применения расширилась, было ли это четко указано?

Если данные превзошли ожидания участников, будет ли это удивление приемлемым?

Почему команды, ориентированные на ЕС, по своей природе осторожны

Европейские регулирующие органы заняли жесткую позицию в отношении мониторинга рабочего места и дисбаланса сил. Системы искусственного интеллекта для ведения записей затрагивают обе эти области, что объясняет, почему команды, работающие в ЕС, часто действуют осторожно.

Эта осторожность обычно проявляется на раннем этапе. Команды задумываются о сохранении данных еще до внедрения. Они спрашивают о доступе, прежде чем включить запись. Они ищут обоснование, а не дорабатывают правила позже.

Это попытка избежать проблем, которые трудно решить после потери доверия.

Как ответственно оценивать ИИ-конспектатора

Как только команды признают, что программы для создания заметок на базе ИИ поднимают реальные вопросы конфиденциальности и безопасности, следующей задачей становится тщательный выбор одной из них. Именно на этом этапе многие оценки заходят в тупик, и не потому, что люди теряют интерес, а потому, что становится сложно понять, как инструмент будет вести себя после перехода от демонстрационной версии к повседневному использованию.

Ответственная оценка фокусируется на результатах, а не на гарантиях. Цель состоит в том, чтобы понять, что происходит с данными о встречах с течением времени, в различных ситуациях и при появлении крайних случаев.

1) Начните с вопросов, описывающих поведение

Ранние оценки часто сосредоточены на том, соответствует ли инструмент нормативным требованиям. Это важно, но редко дает полную картину. Более полезную информацию можно получить, понимая, как система работает по умолчанию.

- Место хранения данных о встречах, включая задействованные регионы

- Как долго хранятся записи и стенограммы перед удалением

- Кто может просматривать записи, стенограммы или резюме после встречи

- Изменяется ли доступ в зависимости от роли, рабочего пространства или права собственности

- Что происходит с данными, когда кто-то уходит из организации

Инструменты, которые хорошо справляются с этими задачами, облегчают командам объяснение использования внутри компании и применение единых правил без конфликтов.

2) Согласие, раскрытие информации и ожидания

Запись работает лучше всего, когда люди понимают, что происходит, еще до ее начала. При оценке следует внимательно посмотреть, как инструменты сообщают о статусе записи на реальных встречах.

- Четкое уведомление о начале записи

- Возможность включать или выключать запись для каждого собрания

- Предсказуемое обращение с поздними участниками

- Видимые сигналы для внешних участников, таких как бот

Когда запись ведется явно и сознательно, команды чувствуют себя более комфортно при ее использовании и реже прибегают к обходным путям.

3) Обработка искусственного интеллекта и использование моделей

Взаимодействие систем искусственного интеллекта с данными о встречах является ключевым аспектом, на который обращается особое внимание в ходе оценки.

- Влияют ли данные встреч на обучение модели

- Изолирована ли обработка для каждого клиента

- Какие данные остаются после создания сводных отчетов

- Участвуют ли модели третьих сторон

Инструменты, которые четко объясняют эти потоки и разработаны для обеспечения изоляции, дают командам уверенность в том, как их данные обрабатываются за пределами непосредственного совещания.

4) Обработка искусственного интеллекта и использование моделей

Взаимодействие систем искусственного интеллекта с данными о встречах является ключевым аспектом, на который обращается особое внимание в ходе оценки.

- Влияют ли данные встреч на обучение модели

- Изолирована ли обработка для каждого клиента

- Какие данные остаются после создания сводных отчетов

- Участвуют ли модели третьих сторон

Инструменты, которые четко объясняют эти потоки и разработаны для обеспечения изоляции, дают командам уверенность в том, как их данные обрабатываются за пределами непосредственного совещания.

5) Распознавание неполных ответов

В ходе оценок некоторые ответы сигнализируют о необходимости более глубокого обсуждения.

- Общие заявления о соответствии без объяснений

- Ссылки на сертификаты, не связанные с рабочими процессами записи

- Заявления о безопасности без подробной информации о доступе или хранении

- Сильная зависимость от политики без поддержки системного контроля

Более строгие оценки рассматривают их как повод для разъяснений, а не как тревожные сигналы.

6) Оценка воздействия внутри организации

Ответственная оценка также включает в себя размышления о внутреннем использовании.

- Как запись вписывается в существующую культуру проведения совещаний

- Кто решает, когда запись является уместной

- Какие инструкции получают люди перед использованием инструмента

- Как обрабатываются запросы или отказы

Когда эти решения принимаются на раннем этапе, команды с большей вероятностью будут открыто использовать инструмент, а не тихо избегать его.

Что, как правило, включают в себя более убедительные ответы

Более полезные ответы сосредоточены на том, как продукт ведет себя при нормальном использовании, а не в крайних случаях.

- Четкое объяснение настроек по умолчанию

- Простое описание доступа в повседневных ситуациях

- Честное признание ограничений или препятствий

- Документация, отражающая фактическое использование инструмента

Такие детали упрощают командам ответственное внедрение инструментов и их поддержку в течение длительного времени.

В поисках доказательств, выходящих за рамки разговора

Оценка будет более достоверной, если она будет выходить за рамки продаж и учитывать факты, не связанные с ними.

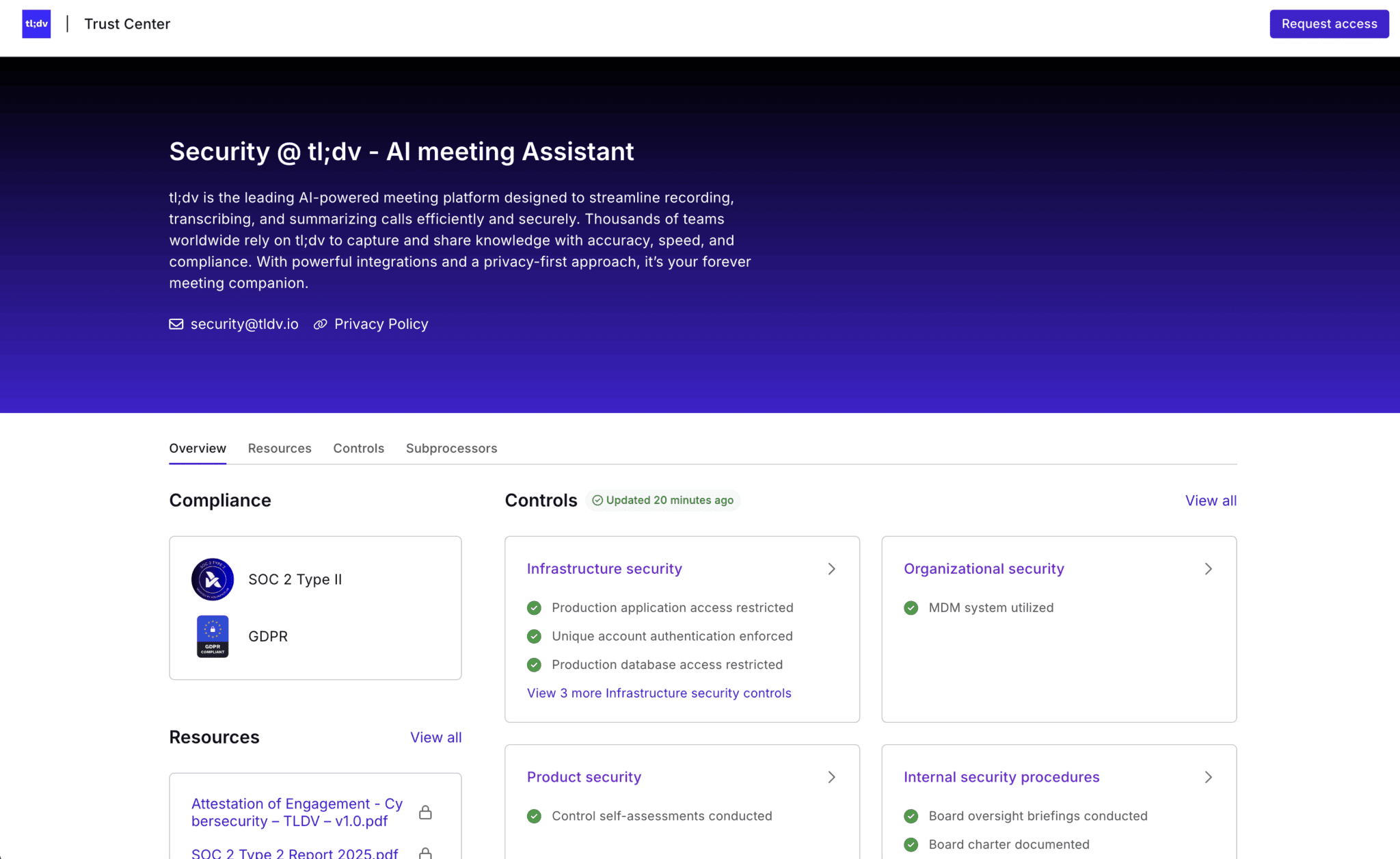

Доступные для общественности центры безопасности или доверия, которые постоянно обновляются, документация, в которой четко объясняется, как на практике работает запись и транскрипция, а также прозрачные описания того, как данные перемещаются между системами, — все это имеет большое значение. Независимые аудиты, которые отражают реальное использование, а не абстрактное соответствие требованиям, добавляют дополнительный вес. Наличие этих материалов облегчает скоординированную работу команд по безопасности, юридическим вопросам и операциям на раннем этапе и способствует ответственному внедрению в течение длительного времени.

Как ответственные поставщики снижают риски для конфиденциальности на практике

Ответственные поставщики снижают риски для конфиденциальности с помощью конкретных решений по продуктам, а не общих заверений. Эти решения проявляются в том, как работает запись, кто может получить доступ к контенту, как долго хранятся данные и как обрабатываются данные искусственным интеллектом за кулисами.

Одной из наиболее заметных областей является сама запись. Ответственные инструменты делают запись явной, а не скрытой. В случае tl;dvвстречи записываются с помощью видимого бота, который присоединяется к звонку, делая запись очевидной для всех участников. Ведущие могут запускать или останавливать запись, и запись не предназначена для бесшумного выполнения в фоновом режиме. Это снижает риск неожиданностей и способствует информированному участию с самого начала.

Доступ к записанному контенту — еще одна область, в которой важна реализация. tl;dv доступ к записям и стенограммам на уровне рабочего пространства, а не делает контент общедоступным по умолчанию. Это означает, что записи доступны только людям в соответствующем рабочем пространстве, а обмен информацией за пределами этого контекста контролируется. Такой подход ограничивает непреднамеренное распространение и согласовывает доступ с исходным контекстом встречи.

Хранение и удаление рассматриваются как операционные меры контроля, а не как крайние случаи. tl;dv командам управлять сроком хранения записей и стенограмм, а удаление удаляет исходные данные о встрече, а не просто скрывает их из вида. Резюме и результаты, сгенерированные искусственным интеллектом, следуют тому же жизненному циклу, что и исходный материал, что обеспечивает предсказуемое обращение с ними в течение времени.

Границы обработки искусственного интеллекта четко задокументированы в Центре доверия tl;dv.

Согласно опубликованным материалам, данные встреч с клиентами обрабатываются исключительно для предоставления таких функций, как транскрипция, резюме и аналитика, и не используются для обучения более широких моделей искусственного интеллекта. Это различие помогает командам оценивать риск вторичного использования, поскольку четко определяет, как данные обрабатываются после непосредственной встречи. Центр доверия также включает независимые артефакты, такие как аттестат SOC 2 Type II и отчет о тесте на проникновение, а также подробную информацию об инфраструктуре и организационных механизмах контроля, демонстрирующие, как регулируются доступ и обработка данных в повседневной деятельности.

Место хранения этой информации так же важно, как и само ее содержание. tl;dv обязательства на системном уровне от повседневной деятельности. В Центре доверия на высоком уровне документируются практики безопасности, обработки и использования данных, а в Справочном центре объясняется, как работает запись, как управляется доступ и как на практике можно применять настройки хранения. Это упрощает для команд оценку платформы при закупке и понимание ее поведения после начала использования.

Ни одна из этих мер не устраняет риск полностью. Они снижают неопределенность. Они ограничивают случайное воздействие. Они способствуют осознанному использованию без прибегания к неформальным обходным путям.

Когда поставщики документируют функции своих систем, разрабатывают их с учетом требований прозрачности и предоставляют командам контроль над доступом и хранением данных, конфиденциальность становится неотъемлемой частью работы продукта, а не чем-то, добавленным задним числом. Так на практике выглядит ответственное снижение рисков.

Выбор AI-конспекта без доверия к азартным играм

Искусственный интеллект, занимающийся ведением записей, находится в неловком положении. Он обещает облегчить административную работу, улучшить запоминание и сократить количество упущенных деталей, но при этом затрагивает самую человеческую часть работы — общение. Вполне логично, что люди колеблются, прежде чем позволить инструментам слушать, запоминать и обобщать то, что они говорят на работе.

Это колебание отражает инстинктивное понимание того, что после записи и обработки разговоров ситуация меняется. Слова остаются надолго. Контекст распространяется дальше, чем предполагалось. То, что казалось неформальным, может внезапно стать постоянным. Контроль начинает иметь значение, которого раньше не было.

Ответственный выбор не означает отказ от этих инструментов. Это означает, что нужно обращать внимание на то, как они работают по умолчанию, насколько понятно они объясняют свою работу и подходят ли они для реальных встреч, а не для идеализированных. Видимость всегда превосходит невидимость. Установки по умолчанию важнее, чем крайние случаи. Четкая документация важнее, чем заверения в ходе коммерческого звонка.

Это также помогает отделить пробное использование от окончательного принятия решения. Многие команды получают пользу от использования этих инструментов сначала в условиях с низким уровнем риска, наблюдая, как на самом деле работают запись, доступ и хранение, и решая, что является приемлемым, прежде чем внедрять что-либо в более широком масштабе. Такой подход учитывает как эффективность, так и интересы людей, чьи разговоры записываются.

Когда команды хотят углубиться в тему, самым убедительным сигналом редко бывает демонстрация или беседа с ловким продавцом. Это письменные записи, которые оставляет после себя поставщик. Центры доверия, страницы безопасности и статьи справки показывают, как обрабатываются личные данные, когда никто не пытается вас убедить. Они помогают понять, что записывается, кто может это видеть, как долго это хранится и где заканчивается обработка искусственным интеллектом.

Такие поставщики, как tl;dv открыто публикуют эти материалы, четко разграничивая высокоуровневые обязательства и практические детали повседневного использования. Это дает командам возможность самостоятельно проверять заявления, а не принимать их на веру.

Внедрение систем искусственного интеллекта для ведения записей не должно восприниматься как рискованный шаг. С помощью правильных вопросов, четкой документации и готовности действовать обдуманно команды могут использовать эти инструменты, не подрывая доверие, которое в первую очередь обеспечивает эффективность встреч.

Часто задаваемые вопросы об искусственном интеллекте и конфиденциальности

С 2026 года будут ли искусственные интеллекты, ведущие записи, законными в соответствии с GDPR?

Да, но только при наличии четких законных оснований для обработки, надлежащего раскрытия информации перед записью и мер контроля доступа, хранения и удаления. Простого уведомления участников после факта недостаточно.

Используют ли AI-конспекторы данные о встречах для обучения своих моделей?

Это зависит от поставщика. Некоторые инструменты заявляют, что данные клиентов не используются для обучения моделей, в то время как другие могут полагаться на более широкие механизмы обработки. Всегда внимательно проверяйте документацию, а не полагайтесь на маркетинговые заявления.

Следует ли использовать AI-конспекторов на совещаниях по кадровым, юридическим или финансовым вопросам?

Эти контексты отличаются повышенной чувствительностью, поскольку в разговорах часто фигурирует конфиденциальная или важная информация. Многие команды ограничивают или избегают записи в таких ситуациях, если только нет явной, задокументированной необходимости и надежных средств контроля данных.

Что следует проверить перед выбором AI-ноутбука?

Обратите внимание на то, где хранятся данные, как долго они сохраняются, кто имеет к ним доступ по умолчанию, удаляются ли записи и транскрипты полностью при удалении, как работает обработка с помощью ИИ и предоставляет ли поставщик прозрачную документацию по безопасности и надежности, отражающую реальные условия использования.