La IA se ha abierto camino en algunas de las partes más delicadas del trabajo cotidiano en 2026. Las reuniones que antes quedaban plasmadas en cuadernos o en recuerdos difusos ahora se graban, transcriben, resumen y almacenan, a menudo de forma automática, por defecto y sin que los equipos se paren a pensar en lo que eso significa para la privacidad. Por eso, los debates sobre la IA y la privacidad se han vuelto tan controvertidos, especialmente en lo que respecta a los tomadores de notas basados en IA, que se sitúan en la encrucijada entre la comodidad y el riesgo.

Dedico mucho tiempo a escribir sobre este tema, y el patrón es siempre el mismo. Los equipos no están en contra de la IA. Están ocupados, desbordados y realmente agradecidos por las herramientas que les liberan de tareas administrativas en su día a día. Al mismo tiempo, se sienten incómodos. Quieren saber adónde van tus conversaciones, quién puede acceder a ellas, cuánto tiempo se conservan y si esas grabaciones se reutilizan de forma sigilosa sin tu consentimiento. Esas preocupaciones son razonables.

Aquí analizaremos la IA y la privacidad desde una perspectiva muy concreta: los dispositivos de toma de notas con IA en 2026. No se trata de ética abstracta ni de argumentos de venta agresivos, sino de los riesgos reales que plantean estas herramientas, cómo se manifiestan esos riesgos en la práctica y lo que los equipos deben comprender antes de pulsar el botón de grabar y confiar sus conversaciones a un sistema de IA.

Tanto si actualmente utilizas un sistema de toma de notas con IA como si todavía estás pensando en cómo incorporarlo a tu vida laboral diaria, esto te proporcionará algunos datos útiles que debes tener en cuenta a la hora de elegir un sistema de toma de notas con IA o cambiar de proveedor.

TL;DR

Los tomadores de notas con IA ahorran tiempo, pero también convierten las conversaciones informales en directo en registros permanentes y consultables que plantean riesgos reales para la privacidad en lo que respecta al consentimiento, la atribución, la conservación, el entrenamiento de modelos y el uso secundario.

Los equipos tienen razón al preguntarse cómo se almacenan las grabaciones, quién puede acceder a ellas, cuánto tiempo se conservan y si los datos se reutilizan más allá de la creación de notas.

Una adopción responsable implica comprobar la base legal, la minimización, los derechos de eliminación, las políticas de formación y la configuración predeterminada, y luego elegir proveedores que hagan visible el registro, limiten el acceso, documenten claramente el procesamiento y den a los equipos un control real sobre la conservación y la eliminación.

¿Por qué los dispositivos de toma de notas con IA suponen un riesgo único para la privacidad?

No todas las herramientas de IA generan el mismo tipo de exposición de la privacidad. Un asistente de diseño o un modelo de análisis de datos suelen trabajar con información que los usuarios deciden introducir deliberadamente y, a menudo, tras un cierto nivel de revisión. Los tomadores de notas de IA son diferentes. Operan con conversaciones en directo, pronunciadas en tiempo real, que a menudo contienen pensamientos sin filtrar, contextos delicados e información que nunca se pretendió capturar textualmente.

Esa diferencia es importante porque cambia tanto la naturaleza de los datos que se procesan como las expectativas que tienen las personas sobre el control, el consentimiento y el uso posterior.

Grabación de conversaciones en directo

El primer cambio, y el más evidente, se produce en el momento en que se graba una reunión. Las conversaciones en directo no son documentos estáticos. Son fluidas, contextuales y, a menudo, exploratorias. Las personas hablan de forma diferente cuando creen que una conversación es temporal. Especulan, se corrigen, prueban ideas y comparten información que quizá nunca pondrían por escrito.

Cuando un asistente de IA graba una reunión, convierte ese intercambio efímero en un artefacto permanente. Esto crea un riesgo para la privacidad incluso antes de que comience cualquier procesamiento de IA. La grabación captura el tono, la intención, los comentarios secundarios y los momentos que nunca se pretendía conservar fuera de la sala. En muchas organizaciones, aquí es donde comienza la incomodidad, especialmente cuando las grabaciones se realizan de forma automática o cuando los participantes no son plenamente conscientes de lo que se está capturando.

También existe una brecha de consentimiento que los equipos suelen subestimar. En las reuniones distribuidas o entre empresas, es posible que no todos los presentes pertenezcan a la misma organización o operen bajo las mismas políticas. La grabación de una conversación en directo plantea preguntas sobre quién ha dado su consentimiento para ser grabado, cómo se obtuvo ese consentimiento y si este resistiría un examen posterior.

Transcripción y atribución de los hablantes

La transcripción añade un segundo nivel de riesgo al transformar el habla en texto. El lenguaje hablado es desordenado. Incluye interrupciones, solapamientos, comienzos en falso y expresiones informales que pueden interpretarse de forma muy diferente una vez escritas. Una transcripción congela esos momentos de una manera que puede resultar reveladora, especialmente cuando se atribuyen a oradores concretos.

La atribución de los oradores aumenta aún más la sensibilidad. Identificar quién dijo qué crea un registro consultable de las contribuciones, opiniones y declaraciones individuales. En las reuniones internas, eso puede afectar a la confianza, especialmente cuando hay dinámicas de poder en juego. En las reuniones externas, plantea dudas sobre si los clientes, socios o candidatos esperan que sus palabras se atribuyan y almacenen de forma permanente.

La precisión es importante en este caso, pero también lo es la interpretación. Las atribuciones erróneas, las transcripciones parciales o la pérdida de contexto pueden dar lugar a registros que no reflejan lo que realmente se quería decir, pero que siguen existiendo como documentos con apariencia oficial. Desde el punto de vista de la privacidad, se trata de un riesgo para la reputación y la equidad.

Almacenamiento, conservación y facilidad de búsqueda

Una vez que se graba y transcribe una reunión, hay que almacenarla en algún lugar. El almacenamiento es donde muchas preocupaciones abstractas sobre la privacidad se convierten en concretas. Los equipos a menudo no se dan cuenta de cuánto tiempo se conservan las grabaciones, dónde se alojan o quién puede acceder a ellas por defecto.

La capacidad de búsqueda amplifica este riesgo. La posibilidad de buscar en meses o años de datos de reuniones es muy útil, pero también significa que la información confidencial puede salir a la luz mucho después de que el contexto original haya desaparecido. Un comentario casual hecho en una sesión de brainstorming puede resurgir durante auditorías, disputas o revisiones internas, separado de las condiciones en las que se dijo.

Por lo tanto, las políticas de retención son fundamentales, pero a menudo se pasan por alto. La retención ilimitada parece conveniente, pero aumenta la exposición con el tiempo. Cuanto más tiempo existan los datos, mayor será la posibilidad de que se acceda a ellos, se utilicen indebidamente o se violen. Los equipos conscientes de la privacidad preguntan cada vez más no solo dónde se almacenan los datos, sino también cuánto tiempo permanecen allí y con qué facilidad se pueden eliminar.

Procesamiento de IA, resúmenes, aspectos destacados y medidas a tomar

Los tomadores de notas con IA ofrecen mucho más que transcripción. Resumen debates, extraen lo más destacado, generan acciones y, en ocasiones, deducen intenciones o prioridades. Este nivel de procesamiento introduce consideraciones adicionales en materia de privacidad.

Los resúmenes son interpretaciones. Compriman conversaciones complejas en narrativas simplificadas, lo que puede cambiar el énfasis u omitir matices. Los aspectos destacados y las medidas a tomar a menudo ponen de manifiesto decisiones o responsabilidades que los participantes no formularon explícitamente de esa manera. Aunque son útiles, estos resultados pueden crear registros que parecen más definitivos de lo que realmente fue la conversación subyacente.

Desde el punto de vista de la privacidad, la preocupación no es solo que la IA procese los datos, sino cómo se utilizan y comparten esos resultados. Es más probable que los resúmenes se reenvíen, se almacenen en herramientas de proyectos o se consulten más adelante, lo que amplía el alcance de la conversación original más allá de tu público previsto.

También está la cuestión del acceso al modelo. Los equipos quieren saber si los datos de las reuniones se procesan en entornos aislados, si se conservan después del procesamiento y si alguna vez se exponen a sistemas ajenos a la tarea inmediata de generar notas.

Riesgo de uso secundario y temores sobre el entrenamiento de modelos

Una de las preocupaciones más persistentes en torno a los tomadores de notas con IA es el uso secundario. A los equipos les preocupa que sus conversaciones puedan reutilizarse para fines que no eran los previstos, como mejorar modelos, entrenar futuros sistemas o generar conocimientos que vayan más allá del ámbito de la reunión original.

Estos temores no son infundados. En el ecosistema más amplio de la IA, la reutilización de datos es habitual y los mensajes de los proveedores suelen ser vagos. Afirmaciones como «no entrenamos con tus datos» pueden ocultar detalles importantes sobre el procesamiento temporal, la anonimización o el aprendizaje agregado.

Para las organizaciones preocupadas por la privacidad, la cuestión clave es el control. Quieren respuestas claras y verificables sobre si los datos de las reuniones contribuyen al entrenamiento de modelos de alguna forma, si existen mecanismos de exclusión voluntaria y cómo se aplican esos compromisos técnicamente, no solo contractualmente.

El riesgo del uso secundario también se extiende a nivel interno. Incluso si un proveedor maneja los datos de forma responsable, las organizaciones deben considerar cómo los datos registrados y procesados de las reuniones podrían ser reutilizados por sus propios equipos de formas que los participantes no habían previsto.

Por eso los tomadores de notas con IA se sienten diferentes.

En conjunto, estos factores explican por qué los tomadores de notas de IA se sienten especialmente sensibles en comparación con otras herramientas de IA. Operan sobre comunicaciones humanas sin filtrar, crean registros duraderos a partir de intercambios temporales y superponen interpretaciones a los datos sin procesar.

El riesgo para la privacidad no es una mala práctica inherente. Es la exposición. Comprender esa distinción es el primer paso para evaluar estas herramientas de forma responsable, en lugar de reaccionar con una aceptación generalizada o un rechazo rotundo.

Las verdaderas preocupaciones de los equipos y por qué no son irracionales

Cuando los equipos se muestran reticentes ante los tomadores de notas con IA, es tentador interpretar esa resistencia como miedo al cambio. En la práctica, las preocupaciones que plantean las personas son específicas, circunstanciales y, a menudo, se basan en experiencias directas. Si pasas tiempo en comunidades de profesionales, verás que los mismos temas surgen repetidamente, independientemente del puesto o el sector.

Reuniones internas y seguridad psicológica

Uno de los primeros puntos de tensión en torno a los tomadores de notas con IA se manifiesta en las reuniones internas, donde la conversación es exploratoria y a menudo inconclusa. Los equipos describen repetidamente un cambio una vez que la grabación entra en la sala. Las personas reducen el ritmo. El lenguaje se vuelve más riguroso. Las ideas se vuelven más seguras antes de mejorar.

Ese cambio se refleja claramente en un debate de larga duración en Reddit sobre la ética de las herramientas de IA para tomar notas en el trabajo. En el hilo, el autor original describe cómo presentó una herramienta de toma de notas basada en IA a su equipo y se encontró con incomodidad en lugar de interés. Un colega pidió que se le avisara antes de cada reunión si se iba a grabar, diciendo que no le gustaba nada que le grabaran, aunque no lo bloquearía activamente.

Las respuestas dejan claro que esta reacción es habitual. Un comentarista escribió: «Siempre preguntamos a los participantes si podemos grabarlos antes de cualquier reunión. Es una cuestión de profesionalidad básica». Otro dijo: «Si descubriera que me has grabado sin mi consentimiento, te denunciaría a Recursos Humanos. Es una grave violación de la privacidad».

Lo que destaca en todo el debate es que muy pocas personas se oponen a la toma de notas en sí misma. La preocupación se centra en la permanencia y la pérdida de control una vez que el lenguaje hablado se captura y procesa. Un usuario explicó: «No quiero que mis palabras se introduzcan en una IA para producir un "resumen" porque no confío en que este sea preciso». Esa inquietud se debe al riesgo de que el contexto se aplane y se malinterprete la intención.

Varios comentaristas también describieron cómo la grabación altera el comportamiento del grupo con el tiempo. Las personas dijeron que se sentían cómodas una vez que se anunciaba la grabación, pero se oponían firmemente a las grabaciones sorpresa, que muchos describieron como deshonestas. Otros expresaron su preocupación por las herramientas de terceros que trasladan las conversaciones internas fuera de los sistemas aprobados, y un comentarista preguntó si alguien se sentía realmente cómodo con que «todas las discusiones internas de la empresa» se enviaran a otro lugar.

En conjunto, estas respuestas apuntan al mismo problema subyacente. La seguridad psicológica depende de que las personas se sientan capaces de pensar en voz alta, cambiar de opinión y expresarse de forma imperfecta. Cuando las reuniones se graban, transcriben, atribuyen y almacenan de forma rutinaria, esa libertad se ve reducida. Las conversaciones se vuelven más cautelosas y menos abiertas, lo que condiciona lo que se dice y lo que nunca se dice.

Los equipos que participan en estas discusiones describen menos ideas provisionales y una participación más cautelosa una vez que la grabación se convierte en algo habitual. Ese cambio afecta a la forma en que se analizan los problemas y se toman las decisiones, por lo que la incomodidad que genera la grabación interna no puede descartarse como una simple reticencia a adoptar nuevas herramientas.

Llamadas de clientes y confianza externa

Las llamadas de clientes y usuarios plantean un tipo de riesgo diferente, ya que las personas al otro lado de la línea están fuera del control de la organización. No comparten las políticas internas, no han aceptado las decisiones sobre las herramientas internas y, a menudo, aportan información confidencial a la conversación sin saber cómo se va a gestionar.

Esa diferencia en las expectativas se refleja claramente en otro debate en Reddit sobre por qué muchos profesionales evitan las herramientas para tomar notas. Un asistente ejecutivo describió un caso legal en el que un cliente aceptaba que un colega junior se uniera a una llamada, pero se oponía inmediatamente a la presencia de un sistema de toma de notas basado en IA. La conclusión era sencilla: las personas se sienten más cómodas confiando en otra persona que en un sistema automatizado cuando lo que está en juego es algo personal.

En otras partes del hilo, los comentaristas describieron organizaciones que eliminan o bloquean activamente a los tomadores de notas con IA de las reuniones, argumentando que las conversaciones confidenciales a menudo se desvían hacia temas delicados sin previo aviso.

La preocupación aquí no es la grabación en sí, sino la pérdida de control una vez que la conversación sale de la llamada. Los clientes pueden esperar que se tomen notas. Rara vez esperan que sus palabras se almacenen, se puedan buscar y sean procesadas por un sistema de inteligencia artificial que otros puedan revisar más tarde.

Varios participantes señalaron que las conversaciones con los clientes no se ciñen estrictamente a los límites de la agenda. Las llamadas rutinarias pueden derivar rápidamente hacia temas personales, financieros o legales, lo que hace que la grabación generalizada resulte arriesgada.

Por eso, muchas organizaciones adoptan un enfoque cauteloso. Algunas limitan el uso de los tomadores de notas con IA al ámbito interno. Otras exigen una autorización explícita para las llamadas externas. Unas pocas los evitan por completo en entornos de atención al cliente, dando prioridad a la confianza sobre la comodidad.

Por eso las llamadas externas siguen siendo uno de los contextos más delicados para los tomadores de notas con IA. La cuestión no es el permiso sobre el papel. Se trata de si la herramienta se ajusta a las expectativas de las personas al otro lado de la línea.

Conversaciones sobre recursos humanos, asuntos legales y finanzas

Ese sentimiento surge repetidamente cuando las personas que trabajan con información confidencial hablan sobre las herramientas de transcripción con IA. Refleja una limitación práctica más que una postura filosófica. En los ámbitos de recursos humanos, jurídico y financiero, las reuniones ya se consideran sensibles por defecto, y las pequeñas incertidumbres conllevan un riesgo desmesurado.

En estos contextos, las personas son muy conscientes de que las palabras no existen de forma aislada. El significado depende del tono, el momento y la intención, y todo eso puede perderse una vez que el discurso se convierte en un registro duradero. Una conversación sobre el rendimiento, una discusión sobre despidos o una sesión de estrategia legal cambian de carácter cuando pueden ser buscadas y revisadas posteriormente por alguien que no estaba presente.

Las preocupaciones en torno a la reutilización se suman a esa inquietud. Los profesionales suelen señalar que las políticas de privacidad pueden permitir que el audio o las transcripciones se utilicen para fines que van más allá de la creación de notas, como la formación de modelos o el intercambio dentro de sistemas más amplios. Incluso cuando se revelan esas prácticas, la posibilidad de un uso secundario parece incompatible con conversaciones que presuponen una estricta confidencialidad.

En estas funciones también existe una marcada preferencia por mantener un control estricto. El procesamiento en el dispositivo se menciona con frecuencia como más aceptable que las cargas basadas en la nube, ya que reduce la incertidumbre sobre el destino de los datos y quién podría acceder a ellos posteriormente. Esa distinción es especialmente importante cuando el tratamiento de la información tiene consecuencias legales, financieras o laborales.

Como resultado, los equipos de recursos humanos, jurídico y financiero tienden a actuar de forma conservadora. Dependen de notas manuales. Limitan el registro. Evitan herramientas que convierten las conversaciones delicadas en artefactos de larga duración. Estas decisiones no tienen que ver con resistirse al cambio. Reflejan la comprensión de que, una vez que ciertas conversaciones se capturan y procesan, la exposición no se puede revertir.

En estos entornos, la moderación es una respuesta racional al peso que tienen esas conversaciones.

Consentimiento y confianza de los empleados

Una de las preocupaciones más candentes en torno a los dispositivos de toma de notas con IA es si los empleados tienen realmente la posibilidad de elegir si quieren que se les grabe y transcriba. Sobre el papel, las empresas suelen abordar esta cuestión mediante políticas o notificaciones en las aplicaciones. En la práctica, esto hace que muchas personas sientan que tienen poco control real sobre cómo se capturan y utilizan sus palabras.

Los profesionales y comentaristas especializados en privacidad han señalado claramente este problema. Algunos expertos sostienen que los tomadores de notas basados en IA difuminan la línea entre la notificación pasiva y el consentimiento activo e informado, ya que los participantes a menudo solo descubren que una herramienta los ha estado grabando después de que la grabación o la transcripción aparecen en sus archivos o se producen discusiones sobre la conservación y la reutilización. Esto plantea dudas sobre la libertad con la que se da el consentimiento y lo que los participantes entienden realmente sobre lo que ha ocurrido con los datos de sus reuniones.

Un artículo reciente sobre las preocupaciones relativas a los tomadores de notas con IA explicaba que la mera presencia de un oyente automatizado en una reunión puede crear una sensación de estar siendo observado o vigilado, lo que cambia la forma en que las personas hablan y participan. Los empleados pueden verse obligados a filtrar su lenguaje, evitar la incertidumbre o reprimir sus aportaciones porque saben que sus palabras están siendo captadas y almacenadas de formas que van mucho más allá del momento en que termina la conversación.

Este problema aparece en las directrices de los profesionales de la privacidad y la protección de datos que insisten en que el consentimiento en marcos como el RGPD debe ser informado, específico y significativo. Por ejemplo, las organizaciones deben informar a los participantes no solo de que se grabará el audio, sino también de qué datos se recopilan, dónde se almacenan, cuánto tiempo se conservan y quién tendrá acceso a ellos. Estos detalles suelen quedar ocultos en las invitaciones a las reuniones o en las condiciones de servicio de la plataforma, en lugar de explicarse claramente antes de comenzar la grabación.

Grabación en segundo plano y herramientas no autorizadas

Una de las tendencias más incómodas que se está produciendo en torno a los dispositivos de toma de notas con IA es que las normas poco claras y las restricciones generales no impiden la grabación. Lo único que cambian es el lugar donde se produce.

A menudo, cuando las herramientas oficiales resultan restrictivas o están mal explicadas, la gente busca alternativas. Empiezan a aparecer cuentas personales, extensiones de navegador, aplicaciones locales y herramientas diseñadas para evitar la detección. Un debate sobre ciberseguridad sobre la denominada«IA en la sombra»describía cómo una organización descubrió cientos de cuentas de toma de notas con IA no autorizadas que operaban sin aprobación, visibilidad ni supervisión. Ese comportamiento no es sorprendente. Los empleados suelen descargar un tomador de notas minutos antes de una llamada importante o activar funciones que ya existen en las herramientas que usan a diario, como Google Gemini Microsoft 365. La grabación no se percibe como una decisión independiente cuando está integrada en un software familiar y se presenta como una comodidad predeterminada en lugar de una elección de política.

El resultado es un riesgo fragmentado. Las grabaciones terminan dispersas en cuentas personales, ubicaciones de almacenamiento no gestionadas y sistemas que nadie en TI o seguridad puede supervisar. Las normas de retención son inconsistentes. El acceso no está claro. El seguimiento de la reutilización de datos se vuelve imposible.

Por eso las prohibiciones generales suelen ser contraproducentes. Cuando la grabación se trata como algo que hay que suprimir en lugar de regular, no desaparece. Se vuelve más difícil de ver. El uso no oficial genera más exposición que las herramientas que se adoptan abiertamente, se explican con claridad y son comprendidas por las personas que las utilizan.

La grabación encubierta no es un fallo de criterio por parte de los empleados. Es una señal de que la brecha entre la política y la realidad cotidiana se ha ampliado demasiado.

Por qué estas preocupaciones merecen ser tenidas en cuenta

En conjunto, estas preocupaciones no son irracionales ni hostiles hacia la IA. Reflejan una visión clara de cómo los tomadores de notas de IA alteran el ciclo de vida de la comunicación en el lugar de trabajo de formas que las personas pueden percibir de inmediato.

Lo que molesta a la gente es la permanencia, la atribución, la posibilidad de búsqueda y la reutilización, junto con un cambio en quién controla lo que ocurre con sus palabras una vez que termina una reunión. Esas reacciones se sitúan en la intersección entre la emoción y las consecuencias. Las conversaciones que antes se desvanecían ahora persisten. El contexto se transmite mal. La propiedad se vuelve difusa.

Reconocer que la realidad importa. Sin comprender cómo estas herramientas cambian el comportamiento y las expectativas, es fácil descartar la incomodidad como resistencia, o confiar excesivamente en garantías que parecen suficientes sobre el papel, pero que en la práctica se quedan cortas.

Ese contexto es el punto de partida para cualquier evaluación significativa de cómo los programas de toma de notas con IA gestionan la privacidad.

La normativa sobre privacidad en torno a los dispositivos de toma de notas con IA suele reducirse a una simple formalidad. Algunos equipos lo tratan como algo que se puede gestionar con una casilla de verificación. Otros lo ven como un tema que es mejor evitar, a menos que intervenga el departamento jurídico. Ninguno de estos enfoques refleja cómo se aplican estas normas una vez que la grabación pasa a formar parte del trabajo diario.

Los marcos normativos como el RGPD son importantes en este caso porque los programas de toma de notas basados en IA tratan conversaciones orales. Las personas hablan de forma diferente a como escriben. Se corrigen a sí mismas en mitad de una frase. Comparten contexto que quizá nunca incluirían en un documento. La normativa cobra relevancia precisamente porque esos momentos se capturan y se conservan.

Preguntas que debes tener en cuenta al analizar los dispositivos de toma de notas con IA

Hay muchas razones por las que es necesario realizar un análisis exhaustivo antes de decidirse por el tomador de notas con IA más adecuado para las operaciones de tu empresa. A continuación, te presentamos algunos puntos que debes tener en cuenta a la hora de tomar esa decisión.

1) Base legal, consentimiento e interés legítimo

Una de las primeras preguntas que se hacen los equipos es si todos los participantes en una reunión deben dar su consentimiento para que se grabe. La respuesta rara vez es sencilla, y ahí es donde suele surgir la inquietud.

Según el RGPD, las organizaciones necesitan una base legal para tratar datos personales. El consentimiento es una opción. El interés legítimo es otra. Muchas herramientas del lugar de trabajo se basan en el interés legítimo, partiendo del supuesto de que el tratamiento respalda un fin comercial razonable y no prevalece sobre los derechos individuales.

Los tomadores de notas con IA se sitúan al límite de esa suposición. La mayoría de la gente espera que se tomen notas. Pocos esperan que un sistema automatizado capture y procese sus palabras exactas. Esa brecha entre las expectativas y la realidad es importante, incluso cuando la base legal es técnicamente sólida.

Por eso la divulgación tiene tanta importancia. Cuando no existe consentimiento, las personas deben saber qué va a ocurrir con sus datos antes de que ocurra, no después de que aparezca una transcripción.

Si alguien se uniera a tu reunión esperando tomar notas en lugar de un registro permanente, ¿sentiría que se le ha dado una opción real?

2) Minimización de datos en un mundo de transcripciones completas

La minimización de datos parece algo teórico hasta que choca con una reunión grabada.

La idea en sí misma es sencilla. Las organizaciones deben recopilar y conservar solo lo que necesitan. Los tomadores de notas con IA suelen hacer lo contrario por defecto, capturando todo porque es fácil de hacer y útil para buscar más adelante.

Eso no hace que estas herramientas sean incompatibles con la normativa. Lo que sí significa es que los equipos deben decidir qué es lo que realmente necesitan. Las grabaciones completas pueden ser útiles. También pueden ser innecesarias. Las transcripciones pueden ser valiosas durante un tiempo. Puede que no sea necesario que se conserven para siempre.

La minimización aquí tiene que ver con la intención. ¿Qué problema se está resolviendo y cuántos datos se guardan para resolverlo?

Si un resumen satisface las necesidades, ¿por qué conservar toda la conversación?

3) Derechos de acceso, supresión y control

La normativa deja de parecer abstracta cuando alguien solicita ver sus datos.

En virtud del RGPD, las personas tienen derecho a acceder a sus datos personales y, en muchos casos, a solicitar que se eliminen. Cuando se graban y transcriben reuniones, esos derechos se extienden tanto a las contribuciones orales como a las escritas.

Esto plantea exigencias operativas reales. Los equipos deben saber dónde se almacenan las grabaciones (preferiblemente en un único espacio unificado) y cómo actuar ante las solicitudes sin tener que hacer conjeturas. Aquí es donde las herramientas cobran importancia. La configuración de retención y los procesos de eliminación dejan de ser algo deseable y pasan a ser necesarios.

Sin esos controles, incluso los equipos bienintencionados pueden encontrarse atascados.

Si alguien te pidiera que eliminaras sus contribuciones de reuniones anteriores, ¿podrías hacerlo de forma limpia?

4) Limitación de la finalidad y uso secundario

La limitación de la finalidad tiene que ver con los límites.

Según el RGPD, los datos personales deben recopilarse por un motivo específico y explícito. No pueden ampliarse silenciosamente a nuevos usos posteriormente sin una justificación clara y transparencia.

Con los tomadores de notas con IA, el objetivo declarado suele ser sencillo. Capturar la reunión. Generar notas. Facilitar la recuperación de la información.

La pregunta más difícil es qué pasará después.

¿La grabación se limita a ese propósito o comienza a servir para otros adicionales? ¿Se analiza para obtener información sobre el rendimiento? ¿Se introduce en sistemas de análisis? ¿Se utiliza para entrenar modelos? ¿Se comparte entre herramientas internas más amplias?

Estas extensiones no son automáticamente ilegales. Sin embargo, requieren claridad. Si el propósito original era tomar notas, cualquier uso más amplio debe definirse y comunicarse desde el principio.

Aquí es donde la confianza puede verse mermada. Es posible que las personas acepten el registro de datos con fines documentales. Sin embargo, pueden cambiar de opinión si esos mismos datos se utilizan para realizar análisis o desarrollar modelos que no guardan relación con el tema en cuestión.

La limitación de la finalidad impone una disciplina sencilla. ¿Por qué se recopiló esto y se sigue utilizando por ese motivo?

Si el alcance se ha ampliado, ¿se ha dejado claro?

Si los datos superaran las expectativas de los participantes, ¿esa sorpresa sería aceptable?

Por qué los equipos centrados en la UE son cautelosos por naturaleza

Los reguladores europeos han adoptado una postura firme con respecto a la vigilancia en el lugar de trabajo y el desequilibrio de poder. Los sistemas de toma de notas basados en IA afectan a ambas áreas a la vez, lo que explica por qué los equipos centrados en la UE suelen actuar con cautela.

Esa precaución suele aparecer pronto. Los equipos piensan en la retención antes del lanzamiento. Preguntan sobre el acceso antes de habilitar la grabación. Buscan justificaciones en lugar de adaptar las normas a posteriori.

Se trata de un intento por evitar problemas que son difíciles de resolver una vez que se pierde la confianza.

Cómo evaluar de forma responsable un programa de toma de notas basado en IA

Una vez que los equipos aceptan que los tomadores de notas con IA plantean cuestiones reales de privacidad y seguridad, el siguiente reto es elegir uno con cuidado. Aquí es donde muchas evaluaciones se estancan, no porque la gente esté desmotivada, sino porque resulta difícil saber cómo se comportará una herramienta una vez que pase de la fase de demostración al uso diario.

La evaluación responsable se centra en los resultados más que en las garantías. El objetivo es comprender qué ocurre con los datos de las reuniones a lo largo del tiempo, en diferentes situaciones y cuando surgen casos extremos.

1) Comienza con preguntas que describan el comportamiento.

Las evaluaciones iniciales suelen centrarse en si una herramienta cumple los requisitos normativos. Eso es importante, pero rara vez ofrece una visión completa. Se obtiene una perspectiva más útil al comprender cómo funciona el sistema por defecto.

- Dónde se almacenan los datos de la reunión, incluidas las regiones implicadas.

- ¿Cuánto tiempo se conservan las grabaciones y transcripciones antes de su eliminación?

- ¿Quién puede ver las grabaciones, transcripciones o resúmenes después de una reunión?

- Si el acceso cambia en función del rol, el espacio de trabajo o la propiedad.

- ¿Qué ocurre con los datos cuando alguien abandona la organización?

Las herramientas que gestionan bien estas áreas facilitan a los equipos explicar su uso internamente y aplicar reglas coherentes sin fricciones.

2) Consentimiento, divulgación y expectativas

La grabación funciona mejor cuando las personas comprenden lo que va a suceder antes de que comience. La evaluación debe analizar detenidamente cómo las herramientas comunican el estado de la grabación en reuniones reales.

- Notificación clara cuando comienza la grabación

- Posibilidad de activar o desactivar la grabación en cada reunión.

- Manejo predecible de los que se incorporan tarde

- Señales visibles para participantes externos, como un bot.

Cuando la grabación es explícita y deliberada, los equipos se sienten más cómodos utilizándola y son menos propensos a crear soluciones alternativas.

3) Procesamiento de IA y uso de modelos

La forma en que los sistemas de IA interactúan con los datos de las reuniones es un aspecto clave en la evaluación.

- Si los datos de las reuniones contribuyen al entrenamiento del modelo.

- Si el procesamiento se realiza de forma aislada por cliente

- ¿Qué datos quedan después de generar los resúmenes?

- Si hay modelos de terceros involucrados

Las herramientas que explican claramente estos flujos y están diseñadas para el aislamiento proporcionan a los equipos confianza sobre cómo se gestionan sus datos más allá de la reunión inmediata.

4) Procesamiento de IA y uso de modelos

La forma en que los sistemas de IA interactúan con los datos de las reuniones es un aspecto clave en la evaluación.

- Si los datos de las reuniones contribuyen al entrenamiento del modelo.

- Si el procesamiento se realiza de forma aislada por cliente

- ¿Qué datos quedan después de generar los resúmenes?

- Si hay modelos de terceros involucrados

Las herramientas que explican claramente estos flujos y están diseñadas para el aislamiento proporcionan a los equipos confianza sobre cómo se gestionan sus datos más allá de la reunión inmediata.

5) Reconocer las respuestas incompletas

Durante las evaluaciones, algunas respuestas indican la necesidad de un debate más profundo.

- Afirmaciones generales sobre el cumplimiento sin explicación alguna.

- Referencias a certificaciones que no están vinculadas a flujos de trabajo de grabación.

- Declaraciones sobre seguridad sin detalles sobre acceso o retención.

- Gran dependencia de las políticas sin controles de sistema que las respalden.

Las evaluaciones más rigurosas tratan estos casos como motivos para pedir aclaraciones, en lugar de señales de alarma.

6) Evaluación del impacto dentro de la organización

Una evaluación responsable también incluye pensar en el uso interno.

- Cómo encaja la grabación en la cultura de reuniones existente

- ¿Quién decide cuándo es apropiado grabar?

- Qué orientación reciben las personas antes de utilizar la herramienta

- Cómo se gestionan las inquietudes o las exclusiones voluntarias

Cuando estas decisiones se toman desde el principio, es más probable que los equipos utilicen la herramienta abiertamente en lugar de evitarla discretamente.

Las respuestas más contundentes suelen incluir

Las respuestas más útiles se centran en cómo se comporta el producto en condiciones normales de uso, en lugar de en casos extremos.

- Explicación clara de la configuración predeterminada

- Descripción sencilla del acceso en situaciones cotidianas.

- Reconocimiento honesto de los límites o restricciones

- Documentación que refleje cómo se utiliza realmente la herramienta.

Este tipo de detalles facilita que los equipos implementen herramientas de manera responsable y las mantengan a lo largo del tiempo.

Buscando pruebas más allá de la conversación

La evaluación es más sólida cuando va más allá de las conversaciones de ventas y se centra en pruebas que existen independientemente de ellas.

Los centros de seguridad o confianza disponibles públicamente que se mantienen actualizados, la documentación que explica claramente cómo funcionan en la práctica el registro y la transcripción, y las descripciones transparentes de cómo se transfieren los datos entre los sistemas marcan la diferencia. Las auditorías independientes que reflejan el uso real en lugar del cumplimiento abstracto añaden aún más peso. Disponer de este material facilita que los equipos de seguridad, jurídico y de operaciones se coordinen desde el principio y apoyen una implementación responsable a lo largo del tiempo.

Cómo los proveedores responsables mitigan el riesgo para la privacidad en la práctica

Los proveedores responsables mitigan los riesgos para la privacidad mediante decisiones concretas sobre los productos, en lugar de garantías generales. Estas decisiones se reflejan en cómo funciona la grabación, quién puede acceder al contenido, cuánto tiempo se conservan los datos y cómo se gestiona el procesamiento de la IA entre bastidores.

Una de las áreas más visibles es la grabación en sí misma. Las herramientas responsables hacen que la grabación sea explícita en lugar de oculta. En el caso tl;dv, las reuniones se graban a través de un bot visible que se une a la llamada, lo que hace que la grabación sea evidente para todos los participantes. Los anfitriones pueden iniciar o detener la grabación, y esta no está diseñada para ejecutarse silenciosamente en segundo plano. Esto reduce el riesgo de sorpresas y favorece una participación informada desde el principio.

El acceso al contenido grabado es otra área en la que la implementación es importante. tl;dv el acceso a las grabaciones y transcripciones a nivel del espacio de trabajo, en lugar de hacer que el contenido sea visible de forma predeterminada para todos. Esto significa que las grabaciones solo están disponibles para las personas que se encuentran dentro del espacio de trabajo correspondiente, y que se controla su uso compartido fuera de ese contexto. Este enfoque limita la difusión no deseada y alinea el acceso con el contexto original de la reunión.

La retención y la eliminación se tratan como controles operativos en lugar de casos extremos. tl;dv los equipos gestionar el tiempo que las grabaciones y transcripciones permanecen disponibles, y la eliminación borra los datos subyacentes de la reunión en lugar de simplemente ocultarlos. Los resúmenes y los resultados generados por IA siguen el mismo ciclo de vida que el material original, lo que permite un manejo predecible a lo largo del tiempo.

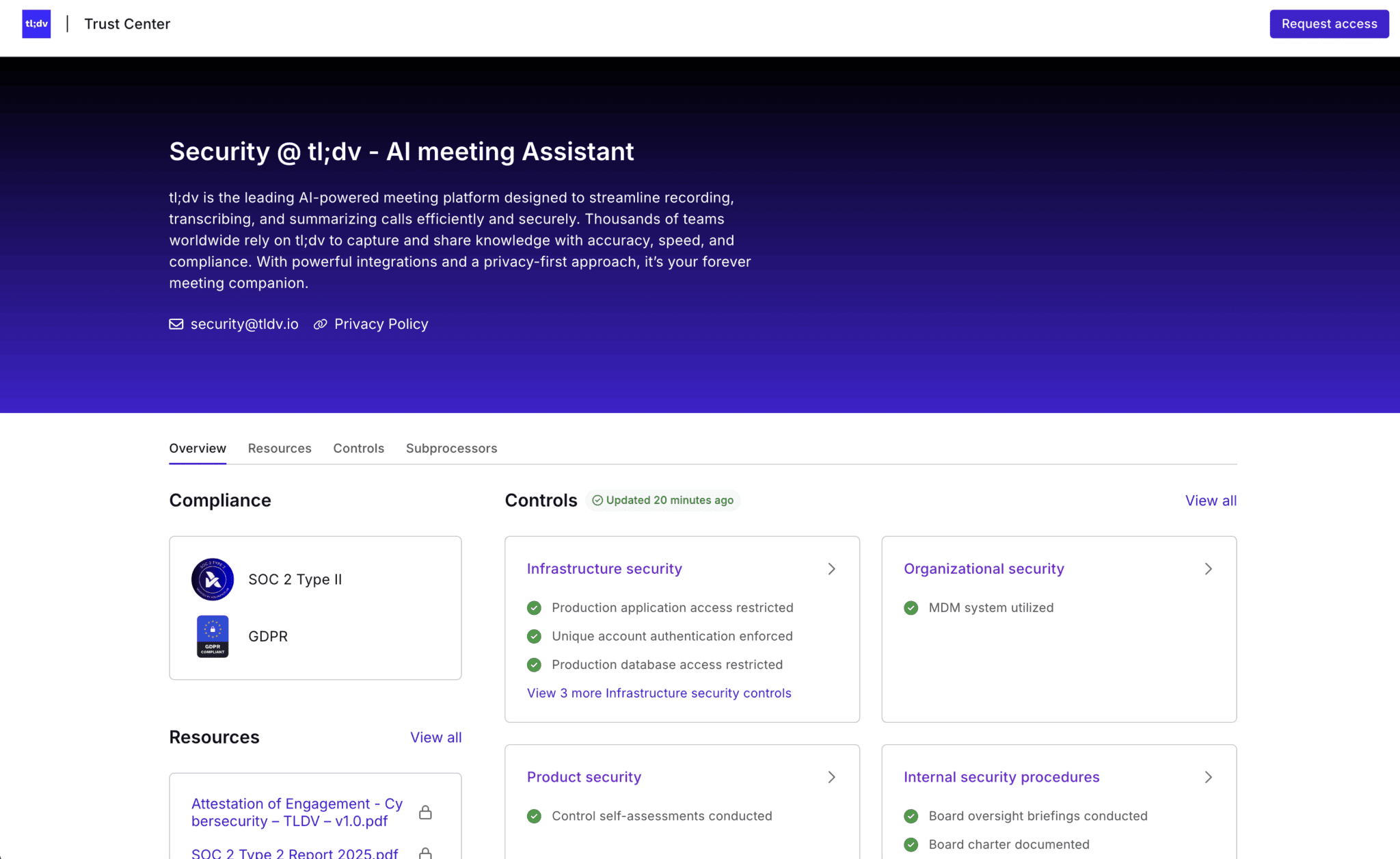

Los límites del procesamiento de IA están documentados explícitamente en el Centro de confianza tl;dv.

Según los materiales publicados, los datos de las reuniones con los clientes se procesan únicamente para ofrecer funciones como transcripciones, resúmenes e información, y no se utilizan para entrenar modelos de IA más amplios, una distinción que ayuda a los equipos a evaluar el riesgo de uso secundario, ya que establece una línea clara sobre cómo se manejan los datos más allá de la reunión inmediata. El Centro de confianza también incluye artefactos independientes, como una certificación SOC 2 Tipo II y un informe de pruebas de penetración, junto con detalles sobre la infraestructura y los controles organizativos, que muestran cómo se gestionan el acceso y el procesamiento en las operaciones diarias.

El lugar donde se almacena esta información es tan importante como el contenido en sí mismo. tl;dv los compromisos a nivel del sistema del comportamiento diario. Su Centro de confianza documenta la seguridad, el manejo de datos y las prácticas de procesamiento a un alto nivel, mientras que su Centro de ayuda explica cómo funciona la grabación, cómo se gestiona el acceso y cómo se pueden aplicar en la práctica los ajustes de retención. Esto facilita a los equipos la evaluación de la plataforma durante la adquisición y la comprensión de su comportamiento una vez que está en uso.

Ninguna de estas medidas elimina el riesgo por completo. Reducen la ambigüedad. Limitan la exposición accidental. Favorecen un uso informado sin depender de soluciones alternativas informales.

Cuando los proveedores documentan lo que hacen sus sistemas, diseñan pensando en la visibilidad y otorgan a los equipos control sobre el acceso y la retención, la privacidad pasa a formar parte del funcionamiento del producto, en lugar de ser algo añadido a posteriori. Así es como se aplica en la práctica una mitigación responsable.

Elegir un asistente de toma de notas con IA sin arriesgar la confianza

Los tomadores de notas con IA se encuentran en una situación incómoda. Prometen aliviar las tareas administrativas, mejorar la memoria y reducir los detalles que se pasan por alto, al tiempo que tocan la parte más humana del trabajo: la conversación. Es lógico que la gente dude antes de dejar que unas herramientas escuchen, recuerden y resuman lo que dicen en el trabajo.

Esa vacilación refleja una comprensión instintiva de que, una vez que las conversaciones se graban y procesan, el terreno cambia. Las palabras duran más tiempo. El contexto viaja más lejos de lo previsto. Lo que parecía informal puede parecer de repente permanente. El control empieza a cobrar importancia de una forma que antes no tenía.

Elegir de forma responsable no significa descartar estas herramientas. Significa prestar atención a cómo funcionan por defecto, cómo se explican con claridad y si se adaptan a la compleja realidad de las reuniones reales, en lugar de a las idealizadas. La visibilidad siempre gana a la invisibilidad. Los valores predeterminados son más importantes que los casos extremos. Una documentación clara es más importante que las garantías en una llamada comercial.

También ayuda a separar el hecho de probar algo de comprometerse con ello. Muchos equipos obtienen valor al utilizar estas herramientas primero en entornos de bajo riesgo, viendo cómo funcionan realmente la grabación, el acceso y la retención, y decidiendo qué les parece aceptable antes de implementarlas de forma más amplia. Ese tipo de ritmo respeta tanto la eficiencia como a las personas cuyas conversaciones se están capturando.

Cuando los equipos quieren profundizar, la señal más clara rara vez es una demostración o una conversación con un hábil representante de ventas. Es el registro escrito que deja un proveedor. Los centros de confianza, las páginas de seguridad y los artículos de ayuda muestran cómo se gestiona la privacidad cuando nadie intenta convencerte. Facilitan la comprensión de lo que se registra, quién puede verlo, cuánto tiempo permanece y dónde se detiene el procesamiento de la IA.

Proveedores como tl;dv publican este material abiertamente, trazando una línea clara entre los compromisos de alto nivel y los detalles prácticos del uso diario. Eso les da a los equipos espacio para verificar las afirmaciones por ustedes mismos, en lugar de aceptarlas sin más.

Adoptar los tomadores de notas con IA no debería parecer un acto de fe. Con las preguntas adecuadas, una documentación clara y la voluntad de actuar con deliberación, los equipos pueden utilizar estas herramientas sin socavar silenciosamente la confianza que hace que las reuniones funcionen en primer lugar.

Preguntas frecuentes sobre la IA y la privacidad

A partir de 2026, ¿serán legales los tomadores de notas con IA según el RGPD?

Pueden serlo, pero solo cuando exista una base legal clara para el tratamiento, se haya informado debidamente antes de la grabación y se hayan establecido controles para el acceso, la conservación y la supresión. No basta con notificar a los participantes a posteriori.

¿Los tomadores de notas con IA utilizan los datos de las reuniones para entrenar sus modelos?

Esto depende del proveedor. Algunas herramientas afirman que los datos de los clientes no se utilizan para el entrenamiento de modelos, mientras que otras pueden basarse en acuerdos de procesamiento más amplios. Comprueba siempre la documentación detenidamente en lugar de fiarte de las afirmaciones de marketing.

¿Deberían utilizarse los tomadores de notas con IA en las reuniones de RR. HH., jurídicas o financieras?

Estos contextos conllevan una mayor sensibilidad, ya que las conversaciones suelen incluir información confidencial o de gran impacto. Muchos equipos limitan o evitan grabar en estos entornos, a menos que exista una necesidad clara y documentada y se apliquen estrictos controles de datos.

¿Qué debemos comprobar antes de elegir un tomador de notas con IA?

Fíjate dónde se almacenan los datos, cuánto tiempo se conservan, quién puede acceder a ellos por defecto, si la eliminación borra por completo las grabaciones y transcripciones, cómo funciona el procesamiento de IA y si el proveedor ofrece documentación transparente sobre seguridad y confianza que refleje el uso en el mundo real.