2026年、AIは日常業務の最も機密性の高い領域にまで浸透している。 かつてノートや記憶に頼っていた会議は、今や記録され、文字起こしされ、要約され、保存される。多くの場合自動的に、デフォルトで、そしてチームがそのプライバシーへの影響を十分に考えないままに。だからこそ、AIとプライバシーに関する議論はこれほどまでに複雑化している。特にAIノートテイカーに関してはなおさらだ。便利さとリスクの境界線上に位置する存在だからである。

この分野について多くの時間を費やして執筆しているが、パターンは常に同じだ。チームはAIに反対しているわけではない。彼らは多忙で手一杯であり、日常業務から管理業務を削減してくれるツールに心から感謝している。同時に不安も抱えている。会話の内容がどこへ行くのか、誰がアクセスできるのか、どのくらい保存されるのか、そしてそれらの記録が同意していない方法で密かに再利用されていないかを知りたいのだ。こうした懸念は当然である。

ここでは、2026年のAIノートテイカーという非常に具体的な視点から、AIとプライバシーについて考察します。抽象的な倫理論や難解な議論ではなく、これらのツールがもたらす現実的なリスク、そのリスクが実際にどのように現れるか、そしてチームが録音ボタンを押す前に理解すべきこと、つまり会話内容をAIシステムに委ねる前に把握すべき点を明らかにします。

現在AIノートテイカーを利用している方も、日常業務にどう組み込むか検討中の方も、AIノートテイカーの選択や他社への切り替えを検討する際の確かな判断材料となるでしょう。

要約すると

AIノートテイカーは時間を節約するが、同時に生の非公式な会話を恒久的で検索可能な記録に変換するため、同意、帰属、保存期間、モデル訓練、二次利用に関する現実的なプライバシーリスクを引き起こす。

チームが、記録の保存方法、アクセス権限、保存期間、およびメモ作成以外の目的でのデータ再利用の有無について疑問を持つのは当然である。

責任ある導入とは、法的根拠の確認、最小化、削除権限、研修方針、デフォルト設定を検証した上で、記録を可視化し、アクセスを制限し、処理を明確に文書化し、チームが保持と削除を実質的に管理できるベンダーを選択することを意味する。

AIノートテイカーが特有のプライバシーリスクとなる理由

すべてのAIツールが同じ種類のプライバシーリスクを生むわけではない。デザインアシスタントやデータ分析モデルは通常、ユーザーが意図的に入力し、ある程度検討した上で提供する情報に基づいて動作する。一方、AIノートテイカーは異なる。これらはリアルタイムで交わされる会話、つまり生の会話に基づいて動作し、しばしばフィルターのかかっていない思考や機微な文脈、逐語的に記録されることを意図されていない情報を含む。

その違いは重要である。なぜなら、処理されるデータの性質と、人々が制御、同意、および下流での利用について抱く期待の両方を変えるからである。

ライブ会話の録音

会議が記録される瞬間、最も明白な変化が最初に生じる。生の会話は静的な文書ではない。流動的で文脈に依存し、しばしば探求的である。会話が一時的だと認識すると、人々の話し方は変わる。推測し、自らを修正し、アイデアを試す。そして決して文書化されないかもしれない情報を共有するのだ。

AIノートテイカーが会議を記録すると、その一時的なやり取りが永続的な記録物へと変わる。これはAI処理が始まる前からプライバシーリスクを生み出す。録音は、その場以外で保存されることを意図されなかった口調、意図、傍論、瞬間を捉える。多くの組織では、特に録音が自動的に行われる場合や、参加者が何が記録されているかを完全に認識していない場合に、ここから不快感が生じ始める。

チームがしばしば過小評価する同意のギャップも存在する。分散型や社をまたぐ会議では、出席者全員が同じ組織に属しているとは限らず、同じ方針のもとで活動しているとも限らない。生会話を録音すると、誰が録音に同意したのか、その同意はどのように得られたのか、後日の精査に耐えられるのかといった問題が生じる。

文字起こしと話者帰属

文字起こしは、話し言葉をテキストに変換することで第二のリスク層を加える。話し言葉は雑然としている。中断や重なり、言い直し、非公式な表現が含まれており、書き起こされると全く異なる印象を与えることがある。文字起こしはそうした瞬間を固定化し、特に発言者が特定された場合には、露呈されたような感覚を伴うことがある。

発言者の帰属を明示することで、機密性はさらに高まる。誰が何を発言したかを特定することで、個人の貢献、意見、発言を検索可能な記録として残すことができる。内部会議では、特に権力関係が絡む場合、信頼性に影響を与える可能性がある。外部会議では、顧客、パートナー、候補者が自身の発言が恒久的に帰属され保存されることを期待しているかどうかという疑問が生じる。

正確性は重要だが、解釈も同様に重要である。誤った帰属、部分的な転記、文脈の喪失は、実際の意図を反映しない記録を生み出す可能性がある。それにもかかわらず、それらは権威ある文書として存在し続ける。プライバシーの観点からは、これは評判リスクと公平性の問題である。

保管、保持および検索可能性

会議の録音と文字起こしが完了すると、その記録はどこかに保存される必要がある。ストレージこそが、多くの抽象的なプライバシー懸念を具体的な問題に変える場所だ。チームは往々にして、録音記録がどれほど長期にわたり保持されるのか、どこにホストされているのか、あるいはデフォルトで誰がアクセスできるのかを認識していない。

検索可能性はこのリスクを増幅させる。数か月あるいは数年にわたる会議データを横断的に検索できる能力は強力だが、それは同時に、機密情報が元の文脈が薄れたずっと後に表面化する可能性を意味する。ブレインストーミングセッションで何気なく発せられた発言が、監査や紛争、内部レビューの際に、発言時の状況から切り離された形で再浮上する可能性がある。

データ保持ポリシーは極めて重要でありながら、しばしば見過ごされがちです。無期限の保持は便利に感じられますが、時間の経過とともにリスクが増大します。データが存在する期間が長ければ長いほど、アクセスされる可能性、悪用される可能性、漏洩される可能性が高まります。プライバシーを重視するチームは、データの保存場所だけでなく、どのくらいの期間保存されるのか、またどれだけ容易に削除できるのかをますます問うようになっています。

AI処理、要約、ハイライト、アクションアイテム

AIノートテイカーは単なる文字起こし以上の機能を提供する。議論を要約し、重要な点を抽出し、アクションアイテムを生成し、時には意図や優先順位を推測することもある。この処理層は追加のプライバシー上の考慮事項をもたらす。

要約は解釈である。複雑な会話を簡略化された物語に圧縮するため、強調点が変化したりニュアンスが省略されたりする。ハイライトやアクションアイテムは、参加者が明示的にそう定めていなかった決定や責任を浮き彫りにすることが多い。有用ではあるが、こうした成果物は、実際の会話よりも決定的な印象を与える記録を生み出す可能性がある。

プライバシーの観点から懸念されるのは、AIがデータを処理することだけでなく、その出力結果がどのように利用・共有されるかである。要約は転送されたり、プロジェクトツールに保存されたり、後で参照されたりする可能性が高く、その結果、元の会話の影響範囲が意図された対象を超えて拡大する。

モデルへのアクセス権の問題もある。チームは、会議データが隔離された環境で処理されるかどうか、処理後に保持されるかどうか、そしてノート生成という直接的なタスクを超えて他のシステムに晒される可能性があるかどうかを理解したいと考えている。

二次利用リスクとモデル訓練への懸念

AIノートテイカーに関する最も根強い懸念の一つは、二次利用である。 チームは、自社の会話が意図しない目的で再利用される可能性を懸念している。例えば、モデルの改善、将来のシステムの訓練、あるいは元の会議の範囲を超えた知見の生成などが挙げられる。

こうした懸念は根拠のないものではない。広範なAIエコシステムではデータの再利用が一般的であり、ベンダーのメッセージはしばしば曖昧である。「お客様のデータで学習を行いません」といった声明は、一時的な処理、匿名化、または集約学習に関する重要な詳細を隠している可能性がある。

プライバシーを重視する組織にとって、核心的な課題は管理権限である。データがモデル訓練に何らかの形で利用されるか否か、オプトアウト手段が存在するか否か、そしてそれらの約束が契約上だけでなく技術的にどのように履行されるかについて、明確かつ検証可能な回答を求めている。

二次利用リスクは内部にも及ぶ。ベンダーがデータを責任を持って扱ったとしても、組織は記録・処理された会議データが、参加者が想定していなかった方法で自社チームによって再利用される可能性を考慮しなければならない。

これがAIノートテイカーが異なる理由だ

これらの要因を総合すると、AIノートテイカーが他のAIツールと比べて特に敏感に感じられる理由が説明できる。それらは無防備な人間のコミュニケーションを処理し、一時的なやり取りから永続的な記録を生成し、生データの上に解釈を重ねるからだ。

プライバシーリスクは本質的な不正行為ではない。それは情報漏洩である。この区別を理解することが、これらのツールを無条件に受け入れるか完全に拒絶するかの反応ではなく、責任を持って評価する第一歩となる。

チームが抱える真の懸念事項、そしてそれらが非合理的ではない理由

チームがAIノートテイカーに躊躇する時、その抵抗を変化への恐怖と捉えたくなる。しかし実際には、人々が抱く懸念は具体的かつ状況に依存し、直接的な経験に基づいていることが多い。実務者のコミュニティで時間を過ごせば、役割や業界を問わず、同じテーマが繰り返し浮上するのがわかるだろう。

内部会議と心理的安全性

AIノートテイカーを巡る初期の緊張点は、内部会議で顕在化する。そこでは会話は模索的で未完成なことが多い。チームは記録が導入されると変化が起きると繰り返し述べる。人々の話し方は遅くなり、言葉は慎重になる。アイデアはより良くなる前に、より安全なものへと変容する。

その変化は 職場におけるAIノート取りツールの倫理に関する長期間にわたるRedditの議論で明らかだ。 職場におけるAIノート取りツールの倫理に関する長期間にわたるRedditの議論で明らかになっている。スレッドでは、投稿者がチームにAIノート取りツールを導入したところ、関心ではなく不快感で迎えられたと述べている。同僚の一人は、会議ごとに録音の有無を事前に知らせるよう要求し、「積極的に阻止はしないが、録音されるのは全く好まない」と語った。

返信からは、この反応が一般的であることが明らかだ。あるコメント投稿者はこう記している。 「私たちは会議の前に必ず参加者に録画の許可を求めます。それが基本的なプロ意識です」 別のコメントでは、もし同意なく録画されていたと知ったら、人事部に報告します。重大なプライバシー侵害です。」

議論全体を通して際立っているのは、メモ取りそのものに反対する人はほとんどいないという点だ。懸念の焦点は、話し言葉が記録・処理された後の永続性と制御の喪失にある。あるユーザーはこう説明した。「自分の発言がAIに投入されて『要約』を生成されるのは望まない。正確な要約をAIが作成できるとは信じられないからだ」。この不安は、文脈が平坦化され意図が誤解されるリスクと密接に結びついている。

複数のコメント投稿者も、記録が時間の経過とともに集団行動をどのように変化させるかを説明した。人々は記録が事前に告知されれば問題ないと述べたが、不意の記録には強く反対し、多くの人がそれを不誠実だと表現した。また、サードパーティ製ツールが社内会話を承認されたシステム外に流出させる懸念も提起され、あるコメント投稿者は「社内のあらゆる議論」が外部に送信されることに本当に安心できる人がいるのかと問いかけた。

これらの反応を総合すると、同じ根本的な問題が浮かび上がる。心理的安全性は、人々が自由に意見を述べ、立場を変え、不完全な表現でも発言できると感じられることに依存している。会議が日常的に録音・文字起こし・発言者特定・保存される環境では、その自由は狭められる。会話は慎重になり、開かれた性質を失い、その結果、語られる内容と語られない内容が形作られるのだ。

これらの議論に参加するチームは、記録が日常的になると、仮説的なアイデアの提示が減り、慎重な参加が増えると述べる。この変化は問題の探求方法や意思決定の形成に影響を与えるため、内部記録に対する不快感は、単に新しいツールの導入を渋っているだけとは片付けられない。

顧客からの電話と外部からの信頼

顧客やクライアントとの電話対応は、別の種類のリスクを伴います。なぜなら、電話の向こう側にいる人々は組織の管理下にないからです。彼らは内部方針を共有しておらず、内部ツールの選択に同意しておらず、また、その情報がどのように扱われるかを知らずに、しばしば機密情報を会話に持ち込むことがあります。

その期待のギャップは 別のRedditの議論で 多くの専門家がノート取りツールを避ける理由について議論した別のスレッドで明らかになった。あるエグゼクティブアシスタントは、クライアントが若手同僚の電話参加は認めるが、AIノートテイカーの同席には即座に反対する法的状況を説明した。結論は単純だった。利害が個人的に関わる場面では、人は自動化されたシステムよりも人間を信頼する方が安心するのだ。

スレッドの別の箇所では、コメント投稿者たちが、会議からAIノートテイカーを積極的に排除またはブロックする組織について言及し、機密性の高い会話がしばしば予告なくデリケートな領域に流れ込むと主張している。

問題となるのは記録そのものではなく、会話が通話から離れた後の管理の喪失である。顧客はメモを取ることを期待するかもしれないが、自分の発言が保存され、検索可能となり、後から他者が参照できるAIシステムによって処理されることを期待することは稀である。

複数の参加者が、クライアントとの会話は議題の範囲内にきちんと収まらないと指摘した。日常的な電話でも、すぐに個人的な話題や財務、法的な領域に移行する可能性があり、これが全面的な録音にリスクを感じさせる要因となっている。

そのため、多くの組織は慎重な姿勢を取っている。内部利用に限定する組織もあれば、外部通話には明示的な承認を要求する組織もある。顧客対応の場面では利便性よりも信頼を優先し、AIノートテイカーを完全に回避する組織も一部存在する。

だからこそ、外部通話こそがAIノートテイカーにとって最もデリケートな状況の一つであり続ける。問題は書面上の許可ではない。ツールが通話先の相手の期待に沿うかどうかである。

人事、法務、財務に関する会話

「会議で話された内容を他人に知られたくないなら、AI文字起こしツールに入力するな。」

機密情報を扱う人々がAI文字起こしツールについて語る際、この懸念が繰り返し浮上する。これは哲学的な立場というより、現実的な境界線を反映している。人事、法務、財務の現場では、会議はデフォルトで機密扱いされており、些細な不確実性が過大なリスクを伴うのだ。

こうした文脈では、言葉が孤立して存在しないことを人々は痛感している。意味は口調やタイミング、意図に依存し、それらはすべて、発言が永続的な記録に転換された瞬間に失われる可能性がある。パフォーマンスに関する会話、冗長性に関する議論、法的戦略会議といったものは、後日、その場にいなかった人物によって検索・検証可能になると、その性質が変わってしまうのだ。

再利用に関する懸念が不安を増幅させる。実務家たちはしばしば、プライバシーポリシーが音声や文字起こしをノート作成以外の目的(モデル訓練や広範なシステム内での共有など)に使用することを許可し得ると指摘する。そうした利用が明示されていても、二次利用の可能性は厳格な機密性を前提とする会話と相容れないと感じられる。

これらの機能では、制御を身近に保つことへの強い志向も見られる。クラウドベースのアップロードよりも、デバイス上での処理がより受け入れられやすいと頻繁に言及される。これは、データがどこを移動し、後で誰がアクセスする可能性があるかについての不確実性を低減するためである。この区別は、情報の取り扱い方法に法的、財務的、または雇用上の結果が伴う場合に最も重要となる。

その結果、人事、法務、財務チームは保守的に行動する傾向がある。彼らは手書きのメモに依存し、記録を制限し、機密性の高い議論を永続的な記録に変えるツールを避ける。こうした判断は変化への抵抗ではない。特定の会話が記録・処理された時点で、その公開を元に戻せないという理解の表れである。

こうした環境では、それらの会話が持つ重みに対する抑制は合理的な対応である。

従業員の同意と信頼

AIノートテイカーを巡る最も懸念される問題の一つは、従業員が録音・文字起こしされることについて真に選択権を持っているかどうかである。形式上、企業はしばしばポリシー文言やアプリ内通知でこれを処理する。しかし実際には、多くの人々が自身の発言がどのように記録・利用されるかについて実質的なコントロールをほとんど持てないと感じている。

プライバシー専門家や論評家はこの問題を明確に指摘している。一部の専門家は、AIノートテイカーが受動的な通知と能動的な情報に基づく同意の境界線を曖昧にすると主張する。参加者は、記録や文字起こしが自身のファイルに表示されたり、保存・再利用に関する議論が発生したりした事後になって初めて、ツールによる記録が行われていたことに気付くことが多いからだ。これにより、同意がどれほど自由意志に基づいて与えられたのか、また参加者が自身の会議データに何が起きたのかを実際にどの程度理解しているのかについて疑問が生じる。

AIノートテイカーに関する懸念についての最近の記事は 会議に自動化されたリスナーが存在するという事実自体が、監視されている感覚を生み出し、人々の発言や参加の仕方を変えてしまうと説明している。従業員は、自分の言葉が会話が終わった後もはるかに長く記録・保存されることを知っているので、言葉遣いを慎重に選んだり、不確実性を避けたり、発言を控えたりしてしまう可能性がある。

この問題は プライバシーおよびデータ保護の専門家によるガイダンスで GDPRなどの枠組みにおける同意は、情報に基づく、具体的かつ実質的なものでなければならないと強調している。例えば、組織は参加者に音声が録音されることだけでなく、どのようなデータが収集されるか、どこに保存されるか、どのくらいの期間保持されるか、誰がアクセス権を持つかについても説明しなければならない。こうした詳細は、録音開始前に明示されるのではなく、会議招待状やプラットフォームの利用規約の中に埋もれがちである。

シャドーレコーディングと非認可ツール

AIノートテイカーを巡って浮上した不快な傾向の一つは、不明確なルールや一律の制限が録音行為を止めないことだ。それらは単に場所を変えるだけである。

公式ツールが制限的だったり説明不足だと感じられると、人々は代替手段を探すようになる。個人アカウント、ブラウザ拡張機能、ローカルアプリ、検知回避を目的としたツールが登場し始める。 サイバーセキュリティに関する議論 いわゆる「シャドーAI」に関する議論では、承認も可視性も監視もない状態で稼働する数百もの非公認AIノートテイカーアカウントを発見した組織が紹介された。この行動は驚くべきことではない。 従業員は重要な会議の直前にノートテイカーをダウンロードしたり、Gemini 365など日常的に使用するツール内に既に存在する機能を有効にしたりすることが多い。慣れ親しんだソフトウェアに組み込まれ、ポリシー選択ではなくデフォルトの利便性として位置付けられる場合、記録は独立した意思決定とは感じられないのだ。

その結果、リスクは断片化される。記録は個人アカウントや管理されていない保存場所、IT部門やセキュリティ部門の誰も把握していないシステムに分散してしまう。保存ルールは一貫性を欠き、アクセス権限は不明確だ。データの再利用を追跡することは不可能となる。

これが包括的な禁止が逆効果になりがちな理由だ。記録を規制すべき対象としてではなく、抑圧すべきものとして扱うと、それは消え去ることはない。むしろ見えにくくなる。非公式な利用は、公に採用され、明確に説明され、利用者に理解されているツールよりも、むしろ露出を増大させるのだ。

影の記録は従業員の判断ミスではない。それは方針と日常の実態との隔たりがあまりにも大きくなったという信号である。

なぜこれらの懸念が重視されるべきなのか

これらの懸念は、総合的に見れば非合理的でもなければAIに対する敵意でもない。それらは、AIノートテイカーが職場コミュニケーションのライフサイクルを、人々が即座に実感できる形で変容させる様子を、冷静な視点で捉えたものである。

人々が反応しているのは、永続性、帰属、検索可能性、再利用性、そして会議終了後に発言がどうなるかを誰が制御するかという変化である。それらの反応は感情と結果の交差点に位置する。かつては消え去っていた会話が今や持続する。文脈は伝わりにくい。所有権は曖昧に感じられる。

現実が重要であることを認識する。これらのツールが行動や期待をどう変えるかを理解しなければ、不快感を抵抗と見なして軽視したり、紙の上では十分に見えるが実際には不十分な保証に過度に依存したりしがちである。

その文脈こそが、AIノートテイカーがプライバシーをどのように扱うかを意味ある形で評価する上での出発点である。

AIノートテイカーに関するプライバシー規制は、しばしば簡略化されて扱われる。一部のチームはチェックボックスで処理できるものと見なし、他のチームは法務部門が関与しない限り関わるべきでない領域と考える。いずれのアプローチも、記録が日常業務の一部となった際にこれらの規則が実際にどのように現れるかを反映していない。

GDPRのような枠組みがここで重要となるのは、AIノートテイカーが音声会話を取り扱うためだ。人は書く時とは異なる話し方をする。文の途中で自らを修正する。文書には決して記載しない文脈を共有する。まさにそうした瞬間が記録され保存されるからこそ、規制が関連性を持つのである。

AIノートテイカーを検討する際に考慮すべき点

ビジネス運営に適したAIノートテイカーを導入する前に、入念な調査が必要な理由は数多くあります。選択時に考慮すべき論点をいくつか挙げます。

1) 法的根拠、同意および正当な利益

チームが最初に尋ねる質問の一つは、会議の参加者全員が録音に同意する必要があるかどうかだ。答えは単純なことがほとんどなく、そこに不安が生じ始めることが多い。

GDPRの下では、組織は個人データを処理するための法的根拠を必要とします。同意は一つの選択肢です。正当な利益は別の選択肢です。多くの職場ツールは、処理が合理的な事業目的を支援し、個人の権利を侵害しないという前提のもと、正当な利益に依存しています。

AIノートテイカーはその前提の境界線上に位置する。大半の人はメモが取られることを想定している。しかし、自分の発言が自動システムによって正確に記録・処理されることを想定している人は少ない。この期待と現実のギャップは、法的根拠が技術的に妥当であっても重要である。

これが開示がこれほど重要視される理由だ。同意が根拠でない場合でも、人々は記録が残った後ではなく、事前に自身のデータに何が起きるのかを理解する必要がある。

もし誰かが、恒久的な記録ではなくメモを期待して会議に参加した場合、その人は真の選択肢を与えられたと感じるでしょうか?

2) 完全な記録が存在する世界におけるデータの最小化

データ最小化は、記録された会議と衝突するまでは理論的に聞こえる。

その考え自体は単純明快だ。組織は必要なものだけを収集し保管すべきである。AIノートテイカーはデフォルトで逆の行動を取る傾向がある。後で検索しやすいという理由で、簡単にできるからという理由で、あらゆる情報を取り込むのだ。

これらのツールが規制と両立しないわけではない。ただし、チームは実際に何が必要かを判断しなければならない。完全な記録は有用かもしれないし、不要かもしれない。文字起こしは一時的には価値があるかもしれないが、永久に保存する必要はないかもしれない。

ここでの最小化は意図に関するものです。解決しようとしている問題は何か、そしてそれを解決するためにどれだけのデータが保持されているのか?

要約で十分なら、なぜ会話全体を保存するのですか?

3) アクセス権、削除権及び管理権

誰かが自分のデータを見たいと要求した時、規制は抽象的なものから現実のものへと変わる。

GDPRの下では、個人は自身の個人データにアクセスする権利を有し、多くの場合、その削除を要求する権利も有する。会議が録音・文字起こしされる場合、これらの権利は書面による発言と同様に、口頭による発言にも及ぶ。

これにより実際の運用上の要求が生じる。チームは録画データの保管場所(できれば単一の統合スペース)と、推測に頼らずリクエストに対応する方法を把握する必要がある。ここでツールの重要性が問われる。保存設定と削除プロセスは「あれば便利な機能」から「必須の要件」へと変わるのだ。

そうした管理がなければ、善意のチームでさえ行き詰まることがある。

もし誰かが過去の会議での自分の発言を削除してほしいと頼んだら、あなたはそれをきれいにできるでしょうか?

4) 利用目的の限定と二次利用

目的制限とは境界に関するものである。

GDPRでは、個人データは特定の明確な目的のために収集されなければなりません。明確な正当性と透明性なしに、後から密かに新たな用途に拡大することは許されません。

AIノートテイカーの目的は通常、明快だ。会議を記録する。ノートを生成する。情報の検索を容易にする。

より難しい問題は、次に何が起こるかだ。

その記録は当初の目的のみに留まるのか、それとも追加的な目的にも活用され始めるのか?パフォーマンス分析のために解析されるのか?分析システムに投入されるのか?モデル訓練に利用されるのか?より広範な社内ツール間で共有されるのか?

これらの拡張機能は自動的に違法となるわけではない。ただし、明確化が必要である。本来の目的がメモ取りであった場合、それ以上の用途は当初から定義し、周知される必要がある。

ここで信頼が損なわれる可能性がある。人々は記録目的での記録には同意するかもしれない。しかし、同じデータが関連性のない分析やモデル開発に利用される場合、その見方は変わるかもしれない。

目的限定は単純な規律を強いる。なぜこれは収集されたのか、そして今もその目的で使用されているのか?

範囲が拡大したのであれば、その点は明確にされているのか?

もしデータが参加者の予想以上に成果を上げた場合、その驚きは受け入れられるものとなるだろうか?

EU中心のチームが設計上慎重である理由

欧州の規制当局は職場監視と権力の不均衡について厳しい見解を示している。AIノートテイカーは両領域に同時に触れるため、EU中心のチームが慎重な動きを見せる理由がここにある。

その慎重さは通常、早い段階で現れる。チームは展開前にリテンション(定着率)を考慮する。録画を有効化する前にアクセス権限について尋ねる。後からルールを適用するのではなく、正当性を求める。

これは、信頼が失われた後に修復が困難な問題を回避しようとする試みである。

AIノートテイカーを責任を持って評価する方法

チームがAIノートテイカーが真のプライバシーとセキュリティ上の問題を提起することを受け入れた後、次の課題は慎重にツールを選択することである。多くの評価がここで停滞するのは、関心が薄れたからではなく、デモ段階を超えて日常的に使用されるようになった際にツールがどのように振る舞うかを判断することが困難になるためである。

責任ある評価は保証ではなく結果に焦点を当てる。目的は、会議データが時間の経過とともに、異なる状況下で、またエッジケースが発生した際にどのように変化するかを理解することである。

1) 行動を説明する質問から始める

初期評価では、ツールが規制要件を満たしているかどうかに焦点が当てられることが多い。それは重要だが、全体像を伝えることは稀である。より有用な知見は、システムがデフォルトでどのように動作するかを理解することから得られる。

- 会議データが保存される場所(関連する地域を含む)

- 記録と文字起こしは削除されるまでどのくらい保存されますか

- 会議終了後、録画、議事録、または要約を閲覧できるのは誰ですか

- アクセス権限が役割、ワークスペース、所有権に基づいて変更されるかどうか

- 組織を離れる際にデータはどうなるのか

これらの領域を適切に扱うツールは、チームが社内で使用方法を説明し、摩擦なく一貫したルールを適用することを容易にする。

2) 同意、開示、および期待

記録は、開始前に何が起きるかを人々が理解している場合に最も効果的です。評価では、実際の会議においてツールが記録状態をどのように伝達するかを詳細に検討すべきです。

- 録画開始時の明確な通知

- 会議ごとに録画のオン/オフを切り替える機能

- 遅れて参加した者に対する予測可能な対応

- 外部参加者(ボットなど)向けの可視信号

記録が明示的かつ意図的な場合、チームはそれをより快適に使用でき、回避策を作る可能性が低くなる。

3) AI処理とモデルの使用

AIシステムが会議データとどのように相互作用するかは、評価における重点的な検討領域である。

- 会議データがモデル訓練に寄与するか否か

- 処理が顧客ごとに分離されているかどうか

- サマリー生成後に残るデータは何ですか

- 第三者のモデルが関与しているかどうか

これらの流れを明確に説明し、分離を設計するツールは、チームが直近の会議を超えてデータがどのように扱われるかについて確信を持てるようにします。

4) AI処理とモデルの使用

AIシステムが会議データとどのように相互作用するかは、評価における重点的な検討領域である。

- 会議データがモデル訓練に寄与するか否か

- 処理が顧客ごとに分離されているかどうか

- 要約が生成された後に残るデータは何ですか

- 第三者のモデルが関与しているかどうか

これらの流れを明確に説明し、分離を設計するツールは、チームが直近の会議を超えてデータがどのように扱われるかについて確信を持てるようにします。

5) 不完全な回答の認識

評価の過程において、一部の回答はより深い議論の必要性を示唆している。

- 説明を伴わない広範なコンプライアンス主張

- 記録ワークフローに関連付けられていない認証への言及

- アクセスや保持に関する詳細を伴わない安全性に関する声明

- 支援システム管理を伴わない政策への過度な依存

より厳格な評価では、これらを危険信号ではなく、明確化のための手がかりとして扱う。

6) 組織内への影響の評価

責任ある評価には、内部利用についても考慮することが含まれる。

- 既存の会議文化における記録の役割

- 記録が適切かどうかを決めるのは誰か

- ツールを使用する前に人々が受けるガイダンス

- 懸念事項やオプトアウトの取り扱い方法

これらの決定が早期に行われると、チームはツールをこっそり避けるのではなく、積極的に活用する可能性が高くなる。

より強い回答には通常以下が含まれる

より有益な回答は、エッジケースではなく、通常の使用における製品の動作に焦点を当てています。

- デフォルト設定の明確な説明

- 日常的なシナリオにおけるアクセスのわかりやすい説明

- 限界や制約を率直に認めること

- ツールが実際にどのように使用されているかを反映したドキュメント

このような詳細な仕様により、チームはツールを責任を持って導入し、長期的にサポートすることが容易になります。

会話を超えた証拠を探している

評価は、営業会話を超えて、それらとは独立して存在する証拠に目を向けることでより強固になる。

公開されているセキュリティまたは信頼センターが常に最新の状態に保たれ、記録と文字起こしが実際にどのように機能するかを明確に説明する文書、そしてシステム間でデータがどのように移動するかを透明性をもって記述することが、すべて重要な役割を果たします。抽象的なコンプライアンスではなく実際の使用状況を反映した独立監査は、さらなる信頼性を加えます。こうした資料が利用可能であることで、セキュリティ、法務、運用チームが早期に連携し、時間をかけて責任ある展開を支援することが容易になります。

責任あるベンダーが実際にプライバシーリスクを軽減する方法

責任あるベンダーは、漠然とした保証ではなく具体的な製品設計を通じてプライバシーリスクを軽減する。こうした設計は、記録機能の動作方法、コンテンツへのアクセス権限、データの保存期間、そしてバックエンドでのAI処理の扱い方に現れる。

最も目立つ領域の一つが記録そのものです。責任あるツールは記録を隠すのではなく明示します。tl;dv、会議は通話に参加する可視化されたボットを通じて記録され、参加者全員に記録が行われていることが明らかになります。ホストは記録の開始・停止が可能で、記録はバックグラウンドで静かに実行されるよう設計されていません。これにより不意を突かれるリスクが減り、最初から情報に基づいた参加が促進されます。

録画コンテンツへのアクセスも実装が重要な領域です。tl;dv 、コンテンツをデフォルトで全ユーザーに公開するのではなく、ワークスペース単位で録画と文字起こしへのアクセスをtl;dv 。これにより、録画は関連するワークスペース内のメンバーのみが利用可能となり、そのコンテキスト外への共有は制御されます。このアプローチにより意図しない拡散が制限され、アクセス権限が元の会議の文脈に沿うようになります。

保持と削除は例外的なケースではなく、運用上の制御として扱われます。tl;dv チームは録音と文字起こしの利用可能期間を管理tl;dv 、削除時には単に非表示にするのではなく、元の会議データそのものが消去されます。要約やAI生成出力もソース素材と同じライフサイクルに従うため、時間の経過に伴う予測可能な処理が実現されます。

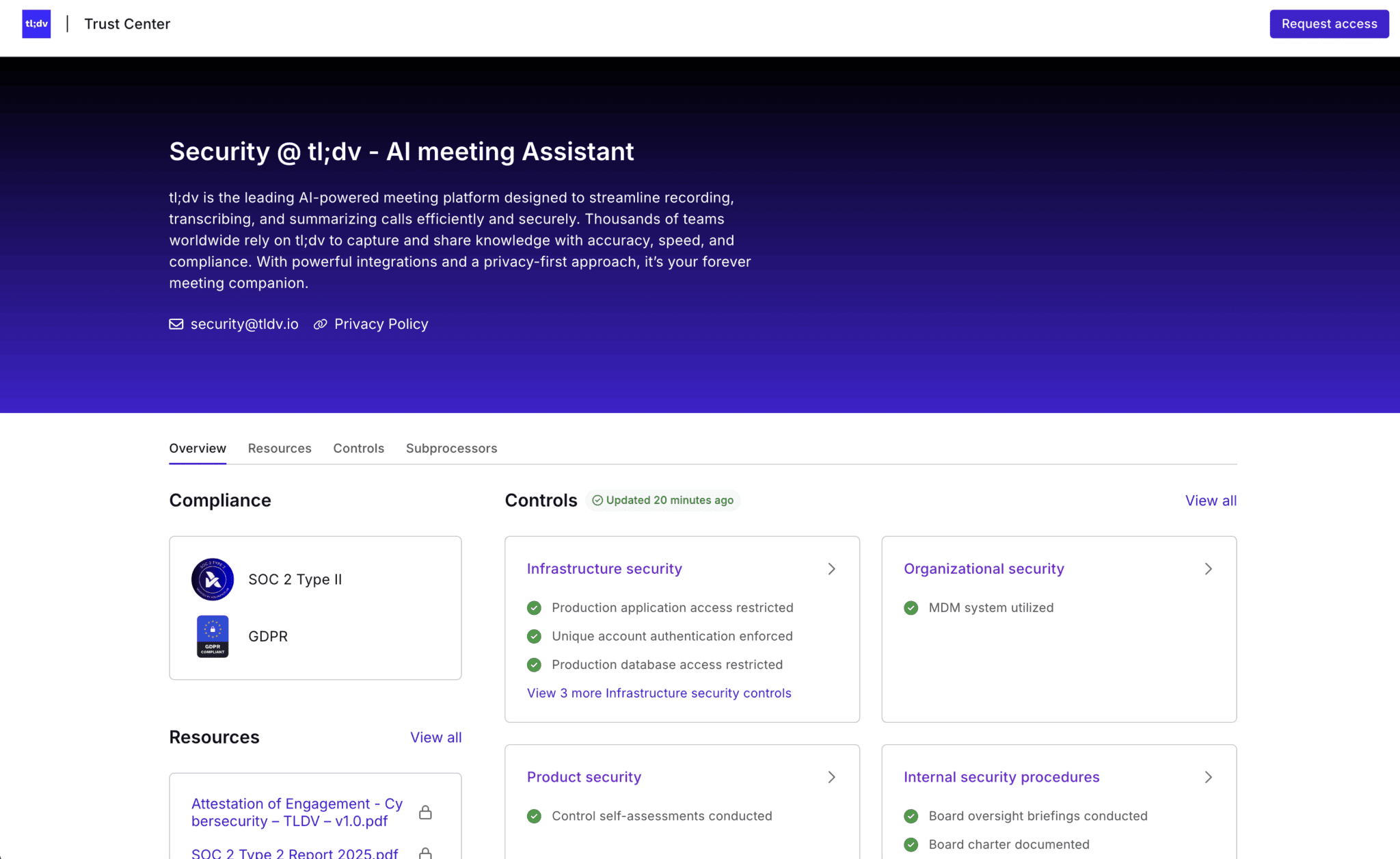

AI処理の境界は、tl;dvトラストセンターに明示的に記載されています。

公開資料によれば、顧客会議データは文字起こし、要約、インサイトなどの機能提供のみを目的として処理され、より広範なAIモデルの訓練には使用されません。この区別により、会議直後のデータ処理範囲を明確に定義できるため、チームは二次利用リスクを評価しやすくなります。 トラストセンターには、SOC 2 Type II 認証やペネトレーションテスト報告書といった独立した検証資料に加え、インフラストラクチャと組織的統制の詳細も含まれており、日常業務におけるアクセスと処理の管理方法を示しています。

この情報がどこに存在するかは、内容そのものと同じくらい重要です。tl;dv システムレベルの約束と日常的な動作をtl;dv 。その「Trust Centre」ではセキュリティ、データ取り扱い、処理慣行を高いレベルで文書化し、「Help Centre」では記録の仕組み、アクセス管理方法、保持設定の実践的な適用方法を説明しています。これにより、チームは調達時にプラットフォームを評価しやすくなり、導入後の動作を理解しやすくなります。

これらの対策はいずれもリスクを完全に排除するものではない。曖昧さを減らす。偶発的な暴露を制限する。非公式な回避策に頼ることなく、情報に基づいた利用を支援する。

ベンダーがシステムの動作を文書化し、可視性を設計に組み込み、アクセスと保持に関する制御権をチームに委ねることで、プライバシーは事後的に追加されたものではなく、製品が機能する仕組みの一部となる。これが実践における責任ある対策の姿である。

信頼を賭けずにAIノートテイカーを選ぶ

AIノートテイカーは微妙な立場にある。事務作業の軽減、記憶力の向上、見逃し減少を約束する一方で、仕事の最も人間的な部分である会話にも関わる。職場で自分の発言をツールに聞かせ、記憶させ、要約させることに人々が躊躇するのは当然だ。

その躊躇は、会話が記録され処理されることで状況が一変するという本能的な理解を反映している。言葉はより長く残り、文脈は意図以上に広まる。気軽だったはずのやり取りが突然、永久的なものに感じられる。これまでとは異なる形で、コントロールが重要になり始めるのだ。

責任ある選択とは、これらのツールを否定することではない。デフォルトでの動作、説明の明確さ、理想化された会議ではなく現実の複雑な会議に適合するかどうかを注意深く見極めることだ。可視性は常に不可視性を凌駕する。エッジケースよりもデフォルト設定が重要だ。営業トークでの安心感よりも、明確なドキュメントが重要なのである。

また、試行と本格導入を区別することも有効だ。多くのチームはまず低リスク環境でこれらのツールを活用し、記録・アクセス・保存の実態を把握した上で、受け入れ可能な範囲を判断してから本格展開している。こうした段階的な進め方は、効率性と会話が記録される当事者の双方を尊重する姿勢と言える。

チームがより深く理解しようとする時、最も強力なシグナルはデモや巧みな営業担当者との会話ではない。ベンダーが残す文書記録こそが重要だ。信頼センター、セキュリティページ、ヘルプ記事は、誰も説得しようとしていない状況でプライバシーがどう扱われるかを示す。これらは、何が記録されるか、誰が閲覧できるか、どのくらいの期間保持されるか、AI処理がどこで止まるかを理解しやすくする。

ベンダーなど tl;dv といったベンダーは、この資料を公開しており、高レベルのコミットメントと日常的な使用における実用的な詳細との間に明確な線を引き、チームが主張を信頼するのではなく、自ら検証する余地を与えています。

AIノートテイカーの導入は、盲目的な信頼を強いるものであってはならない。適切な質問、明確な文書化、そして慎重に進める姿勢があれば、チームはこれらのツールを活用しつつ、会議を機能させる基盤となる信頼を損なうことなく運用できる。

AIとプライバシーに関するよくある質問

2026年時点で、GDPRの下でAIノートテイカーは合法か?

処理には明確な法的根拠が存在し、記録前に適切な開示が行われ、アクセス・保存・削除に関する管理措置が講じられている場合に限り、可能です。事後的に参加者に通知するだけでは不十分です。

AIノートテイカーは会議データを使ってモデルを訓練しているのか?

これはベンダーによって異なります。一部のツールは顧客データをモデルトレーニングに使用しないと明記していますが、他のツールはより広範な処理契約に依存している場合があります。マーケティング上の主張を鵜呑みにせず、常にドキュメントを注意深く確認してください。

人事、法務、財務の会議でAIノートテイカーを使用すべきか?

これらの状況では、会話に機密情報や影響力の大きい情報が含まれることが多いため、より高い機密性が求められます。多くのチームは、明確な文書化された必要性と強力なデータ管理が確立されていない限り、こうした場面での記録を制限または回避しています。

AIノートテイカーを選ぶ前に何をチェックすべきですか?

データの保存場所、保持期間、デフォルトでのアクセス権限、記録と文字起こしの完全削除の可否、AI処理の仕組み、およびベンダーが実使用状況を反映した透明性のあるセキュリティと信頼性に関する文書を提供しているかどうかを確認してください。